Einführung: Warum Frameworks im Jahr 2026 wichtig sind

Im Jahr 2023 bedeutete der Aufbau eines KI-Agenten, GPT-4 in eine While-Schleife mit Tool-Aufrufen einzuschließen. Bis 2026 wird dieser Ansatz in der Produktion zusammenbrechen. Echte Agenten benötigen Zustandsverwaltung, Fehlerbehebung, Human-in-the-Loop-Workflows, Multi-Agenten-Koordination, Beobachtbarkeit und Bereitstellungsinfrastruktur. Frameworks bewältigen jetzt die Komplexität, die die meisten Agentenexperimente im Zeitraum 2023–2024 zum Scheitern brachte.

Die Diskussion hat sich von der Frage „Sollten wir KI-Agenten einsetzen?“ verlagert. zu „Welches Framework übersteht die Produktionslast?“ Dieser Leitfaden behandelt die Frameworks, die das Tal des Todes überstanden haben – diejenigen mit aktiven Communities, Produktionsbereitstellungen und ehrlichen Einschränkungen.

Für wen ist dieser Leitfaden gedacht:

- Entwickler Evaluierung, auf welches Code-First-Framework man sich für ein 6- bis 12-monatiges Projekt festlegen sollte

- CTOs und technische Führungskräfte Treffen strategischer Plattformentscheidungen für ihre Teams

- Plattformteams Entscheidung zwischen selbst gehosteten Frameworks und verwalteten Unternehmenslösungen

- Jedermann der zugesehen hat, wie eine Demo perfekt funktionierte und dann in der Produktion stillschweigend scheiterte

Rahmenkategorien: Die Landschaft verstehen

KI-Agent-Tools lassen sich in vier verschiedene Kategorien einteilen. Die Auswahl der falschen Kategorie ist schmerzhafter als die Auswahl des falschen Werkzeugs innerhalb einer Kategorie.

No-Code/Low-Code-Builder

Plattformen wie YourGPT, Sprachfluss, und Botpress bieten visuelle Schnittstellen zum Entwerfen von Agenten-Workflows. Sie definieren Konversationspfade, verbinden Wissensquellen und führen die Bereitstellung durch, ohne Code schreiben zu müssen.

Wann zu verwenden: Standardanwendungsfälle (Kundensupport, Lead-Qualifizierung, FAQ-Automatisierung), Teams ohne dedizierte KI-Ingenieure, schnelles Prototyping vor der Verpflichtung zur kundenspezifischen Entwicklung.

Einschränkungen: Benutzerdefinierte Logik erfordert Problemumgehungen oder API-Erweiterungen. Das Debuggen ist schwieriger, wenn Sie den Code nicht überprüfen können. Die Bindung an einen Anbieter ist real – eine Abwanderung erfordert einen Neuaufbau.

Code-First-Frameworks

LangGraph, CrewAI, Microsoft Agent Framework, und OpenAI Agents SDK gibt Ihnen Kontrolle auf Codeebene. Sie definieren Agenten, Tools, Zustandsmaschinen und Orchestrierung in Python oder TypeScript.

Wann zu verwenden: Komplexe Arbeitsabläufe, die benutzerdefinierte Logik erfordern, einzigartige Integrationen, die nicht von No-Code-Plattformen abgedeckt werden, Anwendungen, bei denen Beobachtbarkeit und Debugging von entscheidender Bedeutung sind, Teams mit starker technischer Kapazität.

Vorteile: Vollständige Kontrolle, Versionskontrolle, Testbarkeit, Portabilität zwischen Cloud-Anbietern, Möglichkeit zur Fehlerbehebung bei Produktionsproblemen.

Unternehmensplattformen

Microsoft Copilot Studio und Google Vertex AI Agent Builder Bieten Sie eine verwaltete Infrastruktur mit Unternehmenskonformität, Sicherheitskontrollen und Integration in bestehende Unternehmenssysteme.

Wann zu verwenden: Organisationen mit Microsoft 365- oder Google Cloud-Verpflichtungen, regulierte Branchen, die Compliance-Zertifizierungen erfordern, groß angelegte Bereitstellungen, bei denen eine verwaltete Infrastruktur den Betriebsaufwand reduziert.

Spezialisierte Agenten

Codierungsagenten (GitHub Copilot, Cursor), Sprachagenten (dedizierte Sprachplattformen) und domänenspezifische Agenten, die für bestimmte Anwendungsfälle optimiert sind.

Wann zu verwenden: Wenn Ihr Anwendungsfall genau zur Spezialisierung passt. Generische Frameworks erhöhen die Komplexität dieser engen Anwendungsfälle.

Deep-Dive: Code-First-Frameworks

In diesem Abschnitt werden die Frameworks behandelt, die Entwickler für Produktionsagentensysteme bewerten. Jede Bewertung umfasst Architektur, Stärken, Produktionsüberlegungen, GitHub-Daten, reale Anwendungsfälle, Preise, Community-Größe und bekannte Einschränkungen.

LangGraph: Stateful Agents in Produktionsqualität

Architektur: LangGraph modelliert Agenten als Zustandsmaschinen, die auf gerichteten Graphen basieren. Jeder Knoten stellt einen Rechenschritt dar; Kanten definieren Übergänge basierend auf Bedingungen. Der Status wird explizit definiert und zwischen Knoten weitergegeben, wodurch das Verhalten des Agenten deterministisch und debuggbar wird.

Das Framework entstand 2024 aus LangChain, als das Team erkannte, dass Ketten (lineare Kompositionen) die Komplexität der Produktionsagenten nicht bewältigen konnten. LangGraph 2.0, veröffentlicht im Februar 2026, kodifiziert dreijährige Produktionsmuster in einem ausgereiften Framework.

Schlüsselkonzepte:

- StateGraph: Die Kernabstraktion. Definieren Sie ein Zustandsschema, fügen Sie Knoten (Funktionen) hinzu, fügen Sie Kanten (Übergänge) hinzu und kompilieren Sie es in eine ausführbare Datei.

- Kontrollpunkte: Behalten Sie den Zustand jederzeit bei. Setzen Sie die Ausführung an jedem Prüfpunkt fort – wichtig für Agenten mit langer Laufzeit.

- Erinnerung: Integrierte Unterstützung für Konversationsspeicher, Persistenz auf Thread-Ebene und sitzungsübergreifenden Status.

- Human-in-the-Loop: Unterbrechen Sie die Ausführung zur menschlichen Überprüfung, geben Sie Feedback ein und fahren Sie nach der Unterbrechung fort.

Produktionsstärken:

- Beobachtbarkeit: Jeder Zustandsübergang ist nachvollziehbar. Die LangSmith-Integration ermöglicht Produktionsüberwachung, Debugging und Auswertung.

- Testbarkeit: Diagramme können Knoten für Knoten einem Unit-Test unterzogen werden. Der Zustand ist explizit und macht Aussagen einfach.

- Fehlerbehebung: Checkpointing bedeutet, dass Sie nie Arbeit verlieren. Nach Fehlern vom letzten erfolgreichen Zustand fortfahren.

- Maßstab: Wird von Uber, LinkedIn und Klarna für Produktions-Workloads verwendet. 34,5 Millionen monatliche Downloads lassen auf eine echte Produktionsakzeptanz schließen.

GitHub-Daten (Mai 2026):

- Sterne: ~24.800

- Monatliche Downloads: 34,5 Millionen

- Offene Ausgaben: 264

- Geschlossene Ausgaben: 1.015

- Pull-Anfragen: 246 offen, 3.619 zusammengeführt

- Veröffentlichungen: 504 (aktuell: langgraph-cli==0.4.24)

- Mitwirkende: 200+

Echte Anwendungsfälle:

- Uber: Mehrstufige Fahrerunterstützungsautomatisierung mit Übergabe an menschliche Agenten

- LinkedIn: Workflows zur Inhaltsmoderation erfordern eine komplexe Statusverwaltung

- Klarna: Chatbot für Finanzdienstleistungen mit Compliance-Kontrollpunkten

Preise: Open Source (MIT-Lizenz). LangSmith (Observability-Plattform) bietet kostenlose Stufen für die Entwicklung und kostenpflichtige Stufen für die Produktion.

Bekannte Einschränkungen:

- Lernkurve: Erfordert das Verständnis graphbasierter Zustandsmaschinen. Entwickler, die an lineares Denken gewöhnt sind, brauchen 2–4 Wochen, um produktiv zu werden.

- Ausführlichkeit: Einfache Agenten erfordern mehr Grundkenntnisse als CrewAI. Der Kompromiss ist die explizite Kontrolle.

- LangChain-Abhängigkeit: Während LangGraph unabhängig arbeiten kann, gehen die meisten Dokumentationen vom LangChain-Ökosystem aus. Pure LangGraph erfordert mehr Setup.

Beste Passform: Komplexe, mehrstufige Arbeitsabläufe, Anwendungen, die menschliches Eingreifen erfordern, Teams, die der Beobachtbarkeit der Produktion Priorität einräumen, Projekte, bei denen das Agentenverhalten überprüfbar sein muss.

# LangGraph minimal example - stateful agent

from langgraph.graph import StateGraph, END

from typing import TypedDict

class AgentState(TypedDict):

messages: list

context: dict

next_action: str

def process_query(state: AgentState) -> AgentState:

# Your processing logic

return {"next_action": "respond"}

def respond(state: AgentState) -> AgentState:

# Generate response

return {"next_action": END}

workflow = StateGraph(AgentState)

workflow.add_node("process", process_query)

workflow.add_node("respond", respond)

workflow.add_edge("process", "respond")

workflow.set_entry_point("process")

app = workflow.compile()

AutoGen und Microsoft Agent Framework

Wichtig: AutoGen ist im Jahr 2026 in den Wartungsmodus übergegangen. Microsoft empfiehlt Microsoft Agent Framework (MAF) für neue Projekte. In diesem Abschnitt wird beides behandelt, da noch bestehende AutoGen-Bereitstellungen vorhanden sind.

AutoGen (Legacy)

Architektur: Konversationsmuster mit mehreren Agenten. Agenten werden mit Rollen definiert (AssistantAgent, UserProxyAgent usw.) und kommunizieren über einen Konversationsmanager. Das Framework war Vorreiter bei der Multi-Agenten-Orchestrierung, bei der Agenten zusammenarbeiten, um Aufgaben zu lösen.

Legacy-Stärken:

- Die Zusammenarbeit mehrerer Agenten ist erstklassig

- Umfangreiche Gesprächsmuster (sequenziell, Gruppenchat, hierarchisch)

- Codeausführung in Sandbox-Umgebungen

Einschränkungen:

- Zustandsverwaltung weniger explizit als LangGraph

- Weniger Produktionsfallstudien

- Jetzt im Wartungsmodus – keine neuen Funktionen

Microsoft Agent Framework (MAF)

Architektur: Einheitliches Framework, das AutoGen v0.4 und Semantic Kernel vereint und im April 2026 als GA veröffentlicht wurde. Entwickelt für Produktionsbereitstellungen in Unternehmen mit Azure-Integration.

Hauptmerkmale:

- Agenten-Orchestrierung: Definieren Sie Agenten, Fähigkeiten und Arbeitsabläufe

- Azure-Integration: Native Azure AI Services, Azure Functions, Azure Storage

- Unternehmenskonformität: Integrierte Unterstützung für Unternehmenssicherheitsanforderungen

- Semantische Kernel-Integration: Nutzen Sie vorhandene SK-Kenntnisse und Plugins

Beste Passform: Organisationen mit Microsoft 365/Azure-Verpflichtungen, Unternehmensbereitstellungen, die Compliance-Zertifizierungen erfordern, Teams, die bereits Semantic Kernel verwenden.

Migrationshinweis: AutoGen-Benutzer sollten die Migration zu MAF mithilfe des Migrationsleitfadens von Microsoft planen. Die Frameworks haben gemeinsame Konzepte, verfügen jedoch über unterschiedliche APIs.

CrewAI: Rollenbasierte Multi-Agent-Teams

Architektur: CrewAI modelliert Agenten als Teammitglieder mit spezifischen Rollen (Forscher, Autor, Analyst). Agenten sind in „Crews“ organisiert, die gemeinsam an Aufgaben arbeiten. Das Framework betont menschlich-intuitive Abstraktionen gegenüber der Manipulation von Graphen auf niedriger Ebene.

CrewAI wurde vollständig von Grund auf neu entwickelt (keine LangChain-Abhängigkeit) und bietet durch „Crews“- und „Flows“-Paradigmen sowohl Einfachheit für Anfänger als auch Tiefe für fortgeschrittene Benutzer.

Schlüsselkonzepte:

- Agenten: Definieren Sie Rolle, Ziel, Hintergrundgeschichte und Tools. Jeder Agent agiert autonom innerhalb seines definierten Geltungsbereichs.

- Aufgaben: Spezifische Ziele, die Agenten mit erwarteten Ergebnissen zugewiesen werden.

- Besatzungen: Gruppen von Agenten, die zusammenarbeiten. Definieren Sie den Prozess (sequentiell, hierarchisch) für die Aufgabenverteilung.

- Flüsse: Ereignisgesteuerte Orchestrierung für granulare Kontrolle in Unternehmensbereitstellungen.

Produktionsstärken:

- Rasante Entwicklung: Funktionierende Multiagentensysteme in Stunden, nicht in Wochen

- Intuitives Modell: Rollenbasiertes Design entspricht der Art und Weise, wie Teams über Arbeit denken

- CrewAI Enterprise (AMP): Trigger für Gmail, Slack, Salesforce; Bereitstellungsmanagement; RBAC

- Vom Prototyp bis zur Produktion in einer Woche: Realistischer Zeitplan für erfahrene Teams

GitHub-Daten:

- Über 100.000 zertifizierte Entwickler über learn.crewai.com

- Aktiver Community-Discord und Dokumentation

- Zu den Unternehmenskunden zählen Fortune-500-Unternehmen

Produktionsüberlegungen:

- Einfachheit vs. Kontrolle: Einfacher zu starten als LangGraph, aber komplexe Zustandsmaschinen erfordern Workarounds.

- Weniger Observability-Tools: Weniger Möglichkeiten zur Produktionsüberwachung im Vergleich zum LangChain-Ökosystem.

- Rasante Entwicklung: Häufig hinzugefügte neue Funktionen können beim Produktions-Pinning instabil sein.

Bekannte Einschränkungen:

- Weniger expliziter Zustand: Die Zustandsverwaltung ist impliziter als LangGraph. Es ist schwieriger, bestimmte Übergänge zu debuggen.

- Weniger Randfälle dokumentiert: Die Community ist kleiner als LangChain, daher gibt es für obskure Probleme weniger Stack Overflow-Antworten.

Beste Passform: Teams, die ein schnelles Prototyping wünschen, Anwendungsfälle, bei denen rollenbasierte Agententeams das Problem abdecken, Projekte, bei denen die Entwicklererfahrung Vorrang vor maximaler Kontrolle hat, und Organisationen, die schnelle Erfolge benötigen, bevor sie sich zu Framework-Investitionen verpflichten.

# CrewAI minimal example - role-based team

from crewai import Agent, Task, Crew

researcher = Agent(

role="Research Analyst",

goal="Find accurate information",

backstory="Expert at finding and verifying facts",

tools=[search_tool]

)

writer = Agent(

role="Content Writer",

goal="Create engaging content",

backstory="Skilled at translating complex topics",

tools=[write_tool]

)

research_task = Task(

description="Research the topic",

agent=researcher

)

write_task = Task(

description="Write an article",

agent=writer

)

crew = Crew(

agents=[researcher, writer],

tasks=[research_task, write_task],

process="sequential"

)

result = crew.kickoff()

OpenAI Agents SDK (ehemals Swarm)

Architektur: OpenAI Swarm startete im Jahr 2024 als leichte pädagogische Referenzimplementierung für Multi-Agent-Übergaben. Im Jahr 2025 entwickelte es sich zum OpenAI Agents SDK– ein Produktionsframework zum Erstellen von Agenten auf der OpenAI-Plattform.

Hauptmerkmale:

- Einfachheit: Minimale Abstraktionen, leicht verständlicher Code

- Native OpenAI-Integration: Optimiert für GPT-Modelle

- Agentenübergaben: Saubere Muster für die Übertragung zwischen spezialisierten Agenten

Produktionsüberlegungen:

- Leichtgewicht durch Design: Absichtlich minimal – weniger Batterien im Lieferumfang enthalten als bei LangGraph oder CrewAI

- OpenAI-zentriert: Entwickelt um OpenAI-Modelle. Der Einsatz anderer Anbieter erfordert Anpassungen.

- Schnelle Entwicklung: Der Übergang vom Swarm zum Agents SDK bedeutet, dass sich Dokumentation und Muster immer noch stabilisieren.

Beste Passform: Teams, die sich dem OpenAI-Ökosystem verschrieben haben, einfache Multi-Agent-Muster, die eine schnelle Implementierung erfordern, Bildungszwecke und Prototyping, Projekte, bei denen minimaler Code eine Rolle spielt.

LlamaIndex und Haystack

Während es sich in erster Linie um RAG-Frameworks (Retrieval-Augmented Generation) handelt, verfügen beide über weiterentwickelte Agentenfunktionen:

LlamaIndex-Agenten

Stärke: Erstklassige Datenaufnahme und -abfrage. Wenn Ihre Agenten eine anspruchsvolle Dokumentenverarbeitung, die Erstellung von Wissensgraphen oder eine multimodale Datenverarbeitung benötigen, bietet LlamaIndex die Grundlage.

Agentenfunktionen: Zu den Agententypen gehören ReAct-, Structured- und Conversational-Agenten. LlamaIndex lässt sich in LangChain integrieren und kann LangGraph zur Orchestrierung verwenden.

Beste Passform: Anwendungen, bei denen RAG im Mittelpunkt steht, Teams, die LlamaIndex bereits für die Dokumentenverarbeitung verwenden, Projekte, die anspruchsvolle Datenkonnektoren benötigen.

Heuhaufen

Architektur: Pipeline-basiertes Framework zum Erstellen von KI-Anwendungen. Modulare Architektur mit Komponenten für den Abruf, die Generierung und die Agenten-Orchestrierung.

Stärke: Flexible Rohrleitungszusammensetzung. Apache 2.0-Lizenz. Stark in der Produktionssuche und RAG-Anwendungen.

Beste Passform: Teams, die Pipeline-Flexibilität wünschen, suchlastige Anwendungen, Python-First-Teams, die sich nicht dem LangChain-Ökosystem verschrieben haben.

Vergleichsmatrix: Code-First-Frameworks

| Rahmen | Am besten für | Lernkurve | Produktionsbereit | Gemeinschaft | Preise |

|---|---|---|---|---|---|

| LangGraph | Komplexe Stateful-Workflows, Human-in-the-Loop | 2-4 Wochen | Ausgezeichnet (Uber, LinkedIn, Klarna) | Groß (34,5 Mio. Downloads/Monat) | MIT (Kostenlos) |

| CrewAI | Rapid Prototyping, rollenbasierte Teams | 1-2 Wochen | Gut (Enterprise AMP verfügbar) | Wachsend (über 100.000 zertifiziert) | MIT (Enterprise bezahlt) |

| Microsoft Agent Framework | Microsoft/Azure-Ökosystem | 2-3 Wochen | Ausgezeichnet (Enterprise GA) | Groß (Microsoft-Unterstützung) | Kostenlos (es fallen Azure-Kosten an) |

| OpenAI Agents SDK | OpenAI-zentrierte, einfache Muster | 1 Woche | Sich weiterentwickeln | Mittel | Kostenlos (OpenAI-API-Kosten) |

| LlamaIndex-Agenten | RAG-lastige Anwendungen | 2-3 Wochen | Gut | Groß | MIT (Kostenlos) |

| Heuhaufen | Pipelinebasierte Suche/RAG | 2 Wochen | Gut | Mittel | Apache 2.0 (kostenlos) |

Hinweis: „Lernkurven“-Schätzungen setzen Vertrautheit mit Python- und LLM-Konzepten voraus. Die tatsächliche Zeit Ihres Teams hängt von der Erfahrung ab.

Unternehmensplattformen: Microsoft und Google

Für Unternehmen, denen eine verwaltete Infrastruktur Vorrang vor der Kontrolle auf Codeebene einräumt, bieten Unternehmensplattformen schlüsselfertige Lösungen mit integrierter Compliance und Sicherheit.

Microsoft Copilot Studio

Übersicht: Low-Code/No-Code-Plattform zum Erstellen von Agenten, integriert in das Microsoft 365-Ökosystem. Teil der Microsoft Power Platform.

Hauptmerkmale:

- Visueller Agent-Designer mit Drag-and-Drop-Workflows

- Native Integration mit Microsoft 365, Dynamics 365, Azure

- Unternehmenskonformität (SOC, DSGVO, HIPAA)

- Copilot-Erweiterbarkeit – Erweitern Sie Microsoft 365 Copilot mit benutzerdefinierten Funktionen

- Power Automate-Integration zur Workflow-Automatisierung

Preise: Verbrauchsbasiert mit Microsoft 365-Abonnements. Zusätzliche Kapazitätspakete verfügbar.

Beste Passform: Organisationen, die bereits Microsoft 365 nutzen, Teams ohne dedizierte KI-Ingenieure, regulierte Branchen, die Compliance-Zertifizierungen erfordern, interne Unternehmensanwendungen.

Google Vertex AI Agent Builder

Übersicht: Verwaltete Plattform zum Aufbau von Konversationsagenten in Google Cloud, ehemals Dialogflow CX, mit erweiterten KI-Funktionen.

Hauptmerkmale:

- Visueller Flussdesigner für Konversationspfade

- Integration mit Google Cloud-Diensten (BigQuery, Cloud Storage)

- Integration der Unternehmenssuche für den Wissensabruf

- Sprach- und Textkanäle

- Google's Gemini models available

Preise: Pay-per-Request mit Google Cloud. Preisstufen für Dialogflow CX verfügbar.

Beste Passform: Organisationen mit Google Cloud-Investitionen, Contact-Center-Anwendungen, Voice-First-Anwendungsfällen und Teams, die BigQuery zur Wissensgewinnung nutzen.

Vergleich der Unternehmensplattformen

| Plattform | Ökosystem | Stärke | Compliance | Am besten für |

|---|---|---|---|---|

| Microsoft Copilot Studio | Microsoft 365, Azure | Office-Integration, Workflow-Automatisierung | SOC, DSGVO, HIPAA | Interne Apps, M365-Shops |

| Google Vertex AI Agent Builder | Google Cloud | Contact Center, Sprache, Unternehmenssuche | SOC, DSGVO, HIPAA | Kundensupport, Voice-First |

Entscheidungsfaktor: Wählen Sie basierend auf Ihrem bestehenden Cloud-Engagement. Die Migration zwischen Unternehmensplattformen ist kostspielig. Beides ist nicht ideal, wenn Sie eine Kontrolle auf Codeebene benötigen.

Entscheidungsmatrix: Auswahl eines Frameworks

Die Auswahl des Frameworks hängt von fünf Hauptfaktoren ab: Teamfähigkeiten, Komplexität des Anwendungsfalls, Skalierungsanforderungen, Integrationsanforderungen und Budgetzeitplan.

Nach Teamfähigkeit

| Teamprofil | Empfohlen | Vermeiden |

|---|---|---|

| Starke Python-Ingenieure, ML-Erfahrung | LangGraph | No-Code-Plattformen |

| Kleines Team, braucht schnelle Siege | CrewAI | LangGraph (Overkill für einfache Bedürfnisse) |

| Microsoft-zentrierte Organisation | Microsoft Agent Framework / Copilot Studio | Tools für das Google-Ökosystem |

| Kein dediziertes KI-Team | YourGPT, Voiceflow, Copilot Studio | Code-First-Frameworks |

| Forschungslastig, experimentierfreudig | LangGraph + LlamaIndex | Anbietergebundene Plattformen |

Nach Anwendungsfall

| Anwendungsfall | Primäre Empfehlung | Alternative |

|---|---|---|

| Automatisierung des Kundensupports | YourGPT / Botpress (kein Code) | CrewAI für benutzerdefinierte Logik |

| Komplexe mehrstufige Arbeitsabläufe | LangGraph | Microsoft Agent Framework |

| Recherche und Content-Generierung | CrewAI | LangGraph |

| Unternehmensinterne Tools | Copilot Studio | LangGraph + internes Hosting |

| RAG-lastige Anwendungen | LlamaIndex + LangGraph | Heuhaufen |

| Sprachagenten / Contact Center | Google Vertex AI Agent Builder | YourGPT-Stimme |

| Compliance bei Finanzdienstleistungen | LangGraph (Überprüfbarkeit) | Unternehmensplattform |

Nach Umfang und Budget

| Maßstab | Budgetpriorität | Empfehlung |

|---|---|---|

| Startup / MVP | Minimieren Sie die Engineering-Zeit | CrewAI oder No-Code (YourGPT) |

| Wachstumsphase | Balancekontrolle und Geschwindigkeit | LangGraph oder CrewAI |

| Unternehmen | Compliance und Zuverlässigkeit | LangGraph mit Observability ODER Unternehmensplattform |

| Großserienproduktion | Leistung und Zuverlässigkeit | LangGraph mit Checkpointing und Überwachung |

Warnsignale: Wann sollte man es sich noch einmal überlegen?

Nicht jedes Projekt benötigt ein Agent-Framework. Ziehen Sie Alternativen in Betracht, wenn:

- Einfacher FAQ-Chatbot: Verwenden Sie eine einfache Chatbot-Plattform. Frameworks erhöhen die Komplexität, die Sie nicht nutzen werden.

- Einzelschrittaufgaben: Ein einfacher Funktionsaufruf mit Fehlerbehandlung ist schneller und zuverlässiger.

- Keine staatliche Verwaltung erforderlich: Staatenlose Agenten können einfachere Werkzeuge verwenden.

- Dem Team mangelt es an KI-Engineering-Erfahrung: Beginnen Sie mit No-Code und wechseln Sie zu Code-First, wenn die Komplexität dies erfordert.

- Compliance erfordert Prüfpfad: Stellen Sie sicher, dass Ihr Framework Protokollierung und Statuspersistenz unterstützt. LangGraph zeichnet sich hier aus.

Implementierungsmuster

Produktionsagenten benötigen Muster, die über die Framework-Grundlagen hinausgehen. Diese Muster gelten für alle Frameworks.

Fehlerbehandlung und Fallbacks

Jeder Agentenanruf kann fehlschlagen. Produktionssysteme gehen ordnungsgemäß mit Ausfällen um:

- Wiederholen Sie den Versuch mit exponentiellem Backoff: Ratenbegrenzung für LLM-APIs. Die Wiederholungslogik verhindert kaskadierende Fehler.

- Fallback-Modelle: Wenn GPT-4 nicht verfügbar ist, greifen Sie auf GPT-3.5 oder Claude zurück. Definieren Sie Fallback-Ketten.

- Anmutige Degradierung: Wenn Tools ausfallen, sollte der Agent den Benutzer informieren und nicht hängen bleiben.

- Timeout-Behandlung: Jeder externe Anruf benötigt ein Timeout. Produktionssysteme warten nicht auf unbestimmte Zeit.

# LangGraph error handling pattern

from langgraph.graph import StateGraph

from langgraph.checkpoint.memory import MemorySaver

# Define retry logic

def safe_llm_call(prompt, max_retries=3, fallback_model=None):

for attempt in range(max_retries):

try:

return llm.invoke(prompt)

except RateLimitError:

time.sleep(2 ** attempt)

except Exception as e:

if attempt == max_retries - 1:

if fallback_model:

return fallback_model.invoke(prompt)

raise

return None

# Use checkpoints for state persistence

checkpointer = MemorySaver()

app = workflow.compile(checkpointer=checkpointer)

Human-in-the-Loop-Integration

Agenten, die Maßnahmen ergreifen (E-Mails senden, Datensätze ändern, Entscheidungen treffen), benötigen die Zustimmung eines Menschen:

- Checkpoint vor Aktion: Status beibehalten, Mensch benachrichtigen, auf Genehmigung warten.

- Überprüfungsoberfläche: Erstellen oder verwenden Sie eine Überprüfungs-Benutzeroberfläche. LangGraph Studio bietet dies.

- Timeout bei Genehmigung: Wenn der Mensch nicht reagiert, definieren Sie das Standardverhalten.

- Audit-Protokollierung: Jede Genehmigung/Ablehnung sollte mit Kontext protokolliert werden.

Überwachung und Beobachtbarkeit

Produktionsagenten sind verteilte Systeme. Beobachtbarkeit ist nicht optional:

- Verfolgen Sie jeden Schritt: Wissen, welcher Knoten welche Ausgabe erzeugt hat. LangSmith, LangFuse oder benutzerdefinierte Protokollierung.

- Verfolgen Sie die Token-Nutzung: Die LLM-Kosten skalieren mit der Nutzung. Überwachen Sie die Kosten pro Agent und Gespräch.

- Latenz messen: Jeder Knoten erhöht die Latenz. Verfolgen Sie die Reaktionszeiten von p50, p95, p99.

- Warnung vor Anomalien: Plötzliche Kostenspitzen, Latenzerhöhungen oder Fehlerraten erfordern eine Untersuchung.

- Auswertung in der Produktion: Überprüfen Sie regelmäßig die Agentenausgaben zur Qualitätsbewertung.

Prüfung und Bewertung

Agentenverhalten ist probabilistisch. Das Testen erfordert unterschiedliche Ansätze:

- Unit-Testknoten: Testen Sie einzelne Funktionen mit bekannten Eingaben und erwarteten Ausgaben.

- Integrationstestabläufe: Führen Sie End-to-End-Szenarien mit erwarteten Ergebnissen durch.

- Auswertungsdatensätze: Erstellen Sie repräsentative Eingaben mit erwarteten Ausgaben. Genauigkeit messen.

- A/B-Tests: Stellen Sie neue Agent-Versionen für Teilmengen des Datenverkehrs bereit. Vergleichen Sie die Ergebnisse.

- Regressionstests: Führen Sie beim Ändern von Eingabeaufforderungen die Evaluierungssuite aus, um Qualitätsregressionen zu erkennen.

Trends für 2026

Die Agent-Framework-Landschaft konvergiert. Trends zu verstehen hilft bei strategischen Entscheidungen:

Multiagentensysteme werden zum Standard

Single-Agent-Architekturen bewältigen eine begrenzte Komplexität. Die Koordination mehrerer Agenten (Supervisor-Muster, Peer-to-Peer, hierarchisch) ist jetzt Standard für Produktions-Workloads. Sowohl LangGraph als auch CrewAI bieten erstklassigen Multi-Agenten-Support. Erwarten Sie, dass sich die Frameworks an gemeinsamen Mustern annähern.

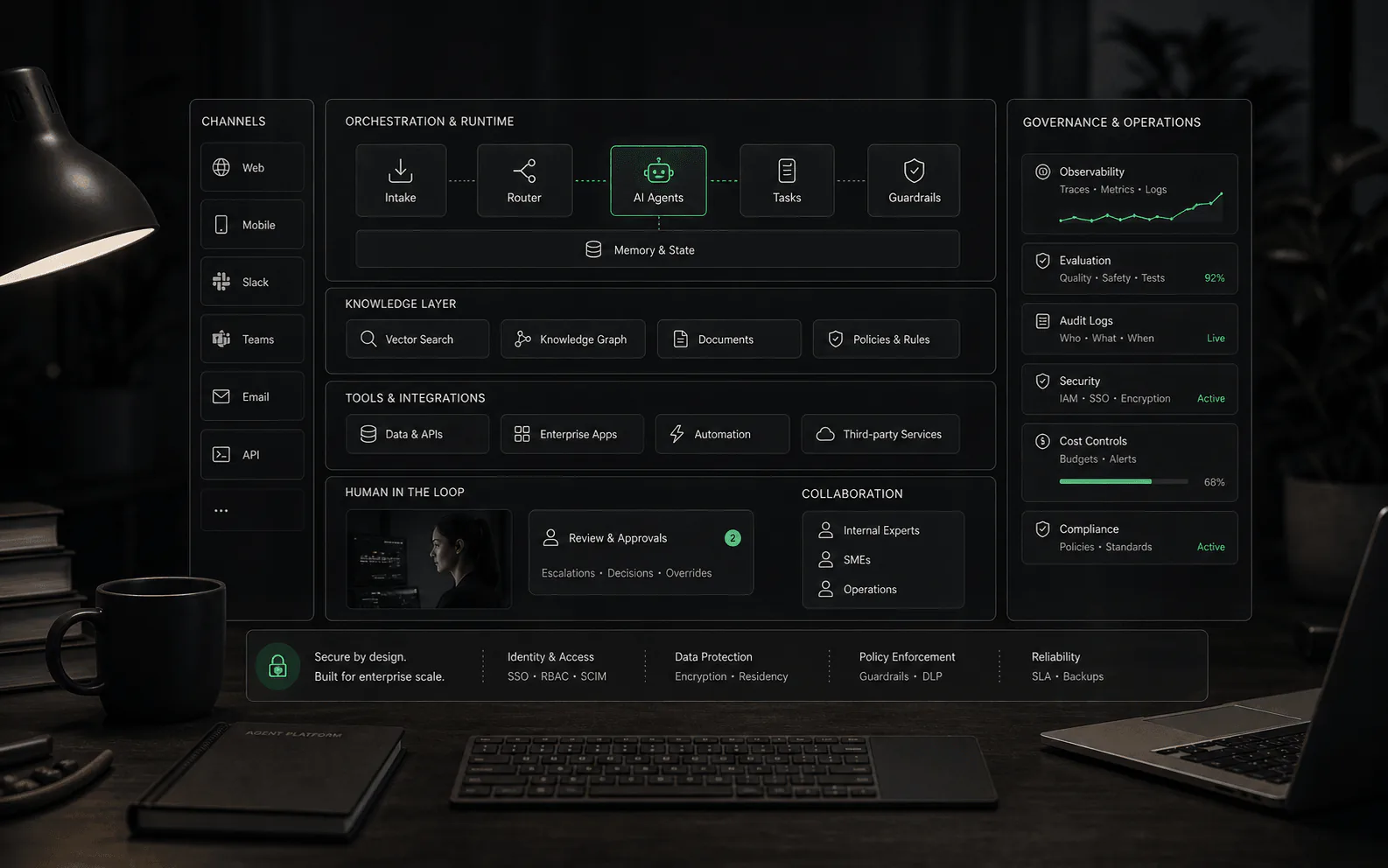

Agent-Orchestrierungsplattformen

Mit der zunehmenden Verbreitung von Agenten benötigen Unternehmen Orchestrierungsebenen, die den Lebenszyklus, das Routing und die Überwachung der Agenten verwalten. Erwarten Sie ein Wachstum bei „Agentenplattform“-Angeboten, die über einzelnen Frameworks liegen. Microsoft Agent Framework und Unternehmensplattformen weisen auf diese Zukunft hin.

Rahmenkonvergenz

LangGraph, CrewAI und andere Frameworks implementieren ähnliche Muster (Checkpointing, Speicher, Human-in-the-Loop). Kernkompetenzen werden zum entscheidenden Faktor. Die Differenzierung verlagert sich auf Entwicklererfahrung, Ökosystem und Produktionstools.

Modellunabhängig wird zum Standardwert

Frameworks, die sich an einzelne Modellanbieter binden, verlieren. LangGraph funktioniert mit jedem LLM. CrewAI unterstützt mehrere Anbieter. Erwarten Sie, dass diese Flexibilität auch bei der schnellen Weiterentwicklung der Modelle von entscheidender Bedeutung bleibt.

Was Sie sehen sollten

- LangGraph 2.0-Ökosystem: LangChain investiert stark. Erwarten Sie kontinuierliche Innovation.

- Einführung von CrewAI Enterprise: Wenn Enterprise AMP an Bedeutung gewinnt, wird CrewAI für groß angelegte Bereitstellungen geeignet.

- Modellanbieter, die Frameworks erstellen: Das Agents SDK von OpenAI, die Framework-Bemühungen von Anthropic. Anbieter-Frameworks können Sie einsperren.

- Standardisierungsbemühungen: Wenn die Muster ausgereift sind, können Sie mit einer Standardisierung der Agentenschnittstellen und der Orchestrierung rechnen.

Quellen und Referenzen

Überprüfen Sie die Rahmenansprüche und erkunden Sie weiter:

FAQ

Häufige Fragen

Was ist der Unterschied zwischen LangGraph und CrewAI?

LangGraph verwendet eine graphbasierte Architektur mit expliziter Statusverwaltung, ideal für komplexe Arbeitsabläufe, die eine feinkörnige Steuerung erfordern. CrewAI verwendet ein rollenbasiertes Agentenmodell, bei dem Agenten bestimmte Rollen zugewiesen werden und als Team zusammenarbeiten, was den Einstieg einfacher, aber weniger flexibel für unkonventionelle Arbeitsabläufe macht.

Wird AutoGen im Jahr 2026 noch beibehalten?

AutoGen ging 2026 in den Wartungsmodus. Microsoft empfiehlt nun für neue Projekte das Microsoft Agent Framework (MAF), das AutoGen v0.4 mit Semantic Kernel zusammenführt. Bestehende AutoGen-Benutzer sollten die Migration zu MAF planen.

Welches Framework eignet sich am besten für Produktions-KI-Agenten?

LangGraph und CrewAI sind die produktionsreifsten Code-First-Frameworks im Jahr 2026. LangGraph zeichnet sich durch komplexe Stateful-Workflows aus (verwendet von Uber, LinkedIn, Klarna). CrewAI eignet sich besser für Rapid Prototyping und wenn rollenbasierte Agententeams zu Ihrem Anwendungsfall passen. Unternehmensteams sollten außerdem Microsoft Agent Framework und Google Agent Builder für verwaltete Plattformen evaluieren.

Sollte ich eine Code-First- oder No-Code-KI-Agent-Plattform verwenden?

Code-First-Frameworks (LangGraph, CrewAI) bieten maximale Kontrolle und sind unverzichtbar, wenn Sie benutzerdefinierte Logik, einzigartige Integrationen oder umfassende Beobachtbarkeit benötigen. No-Code-Plattformen (YourGPT, Voiceflow) lassen sich für Standardanwendungsfälle wie Kundensupport schneller bereitstellen, aber Flexibilität geht gegen Geschwindigkeit. Viele Teams beginnen ohne Code und wechseln zu Code-First, wenn die Komplexität zunimmt.

Wie ist die Lernkurve für KI-Agent-Frameworks?

CrewAI hat die flachste Lernkurve – Entwickler können innerhalb von Stunden funktionierende Multi-Agenten-Systeme erstellen. LangGraph erfordert das Verständnis graphbasierter Zustandsautomaten, belohnt aber mit produktionstauglicher Steuerung. Microsoft Agent Framework weist eine moderate Komplexität mit hervorragender Dokumentation auf. Planen Sie 2–4 Wochen für LangGraph-Kenntnisse und 1–2 Wochen für CrewAI ein.

Käuferwerkzeuge

Vergleichen Sie Frameworks unter Berücksichtigung Ihres Workflows.

Nutzen Sie die Methodik, um die Teamfähigkeit, die Komplexität des Anwendungsfalls, die Integrationsanforderungen und die Produktionsbereitschaft zu bewerten, bevor Sie sich auf ein Framework festlegen.