Was der Begriff in der Praxis bedeutet

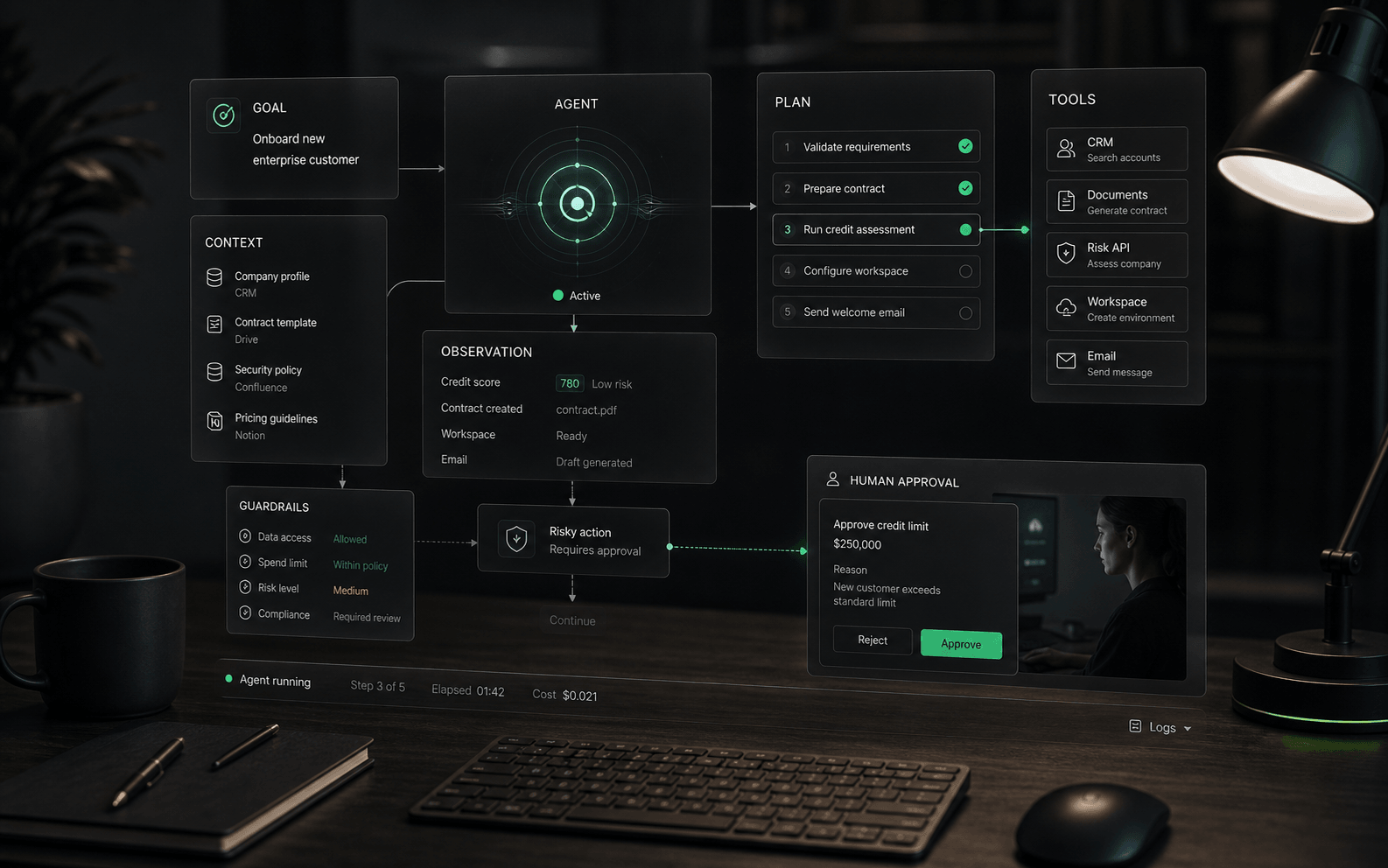

Für Geschäftskäufer ist ein KI-Agent nicht nur ein Chatfenster mit einem neueren Label. Es handelt sich um ein System, das Absichten verstehen, relevanten Geschäftskontext abrufen, über den nächsten zulässigen Schritt entscheiden und entweder reagieren, weiterleiten, entwerfen, aktualisieren, auslösen oder eskalieren kann. Die sinnvolle Definition hängt von der Workflow-Grenze ab: was der Agent selbst tun darf, was eine Genehmigung erfordert und was an einen Menschen übertragen werden muss.

Der Unterschied zu einem Chatbot

- Ein einfacher Chatbot folgt normalerweise einem Konversationsmuster: Beantworten Sie eine Frage, sammeln Sie einen Lead oder verweisen Sie jemanden auf eine Seite.

- Ein KI-Agent kann Geschäftswissen, Kundenkontext, Berechtigungen und verbundene Tools nutzen, um eine Aufgabe voranzutreiben.

- Der Unterschied liegt nicht im Wort Agent. Der Unterschied besteht darin, ob das System über den Kontext nachdenken, begrenzte Maßnahmen ergreifen, den Zustand beibehalten und mit nützlichem Übergabekontext eskalieren kann.

- Ein Produkt kann sich selbst als Agent bezeichnen und sich trotzdem wie ein einfacher Chatbot verhalten, wenn es kein zuverlässiges Wissen nutzen, genehmigte Workflows auslösen oder Überprüfungskontrollen nicht verfügbar machen kann.

So funktioniert ein KI-Agent

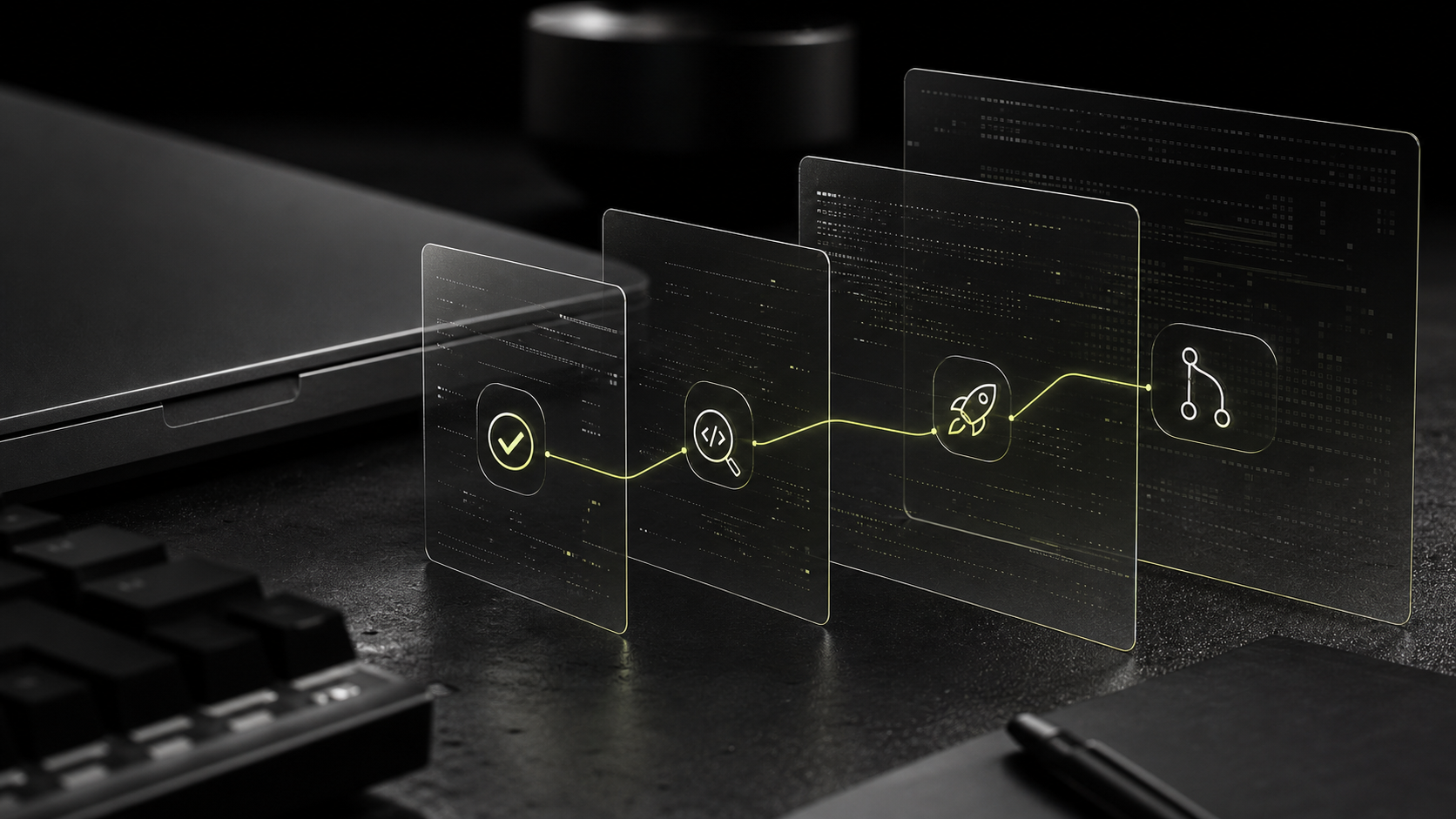

- Interpretieren: Das System wandelt eine Anfrage in eine Absicht, Aufgabe oder ein Ziel um. In einem Geschäftsablauf könnte das bedeuten, dass festgestellt werden muss, ob ein Kunde eine Fehlerbehebung, Hilfe bei der Bestellung, eine Rechnungsüberprüfung oder eine Eskalation benötigt.

- Boden: Der Agent ruft Kontext aus genehmigten Quellen ab oder empfängt ihn, z. B. Hilfeinhalte, Richtlinien, Kontodaten, Bestelldatensätze, frühere Tickets oder interne Prozessnotizen.

- Planen: Der Agent entscheidet über den nächsten zulässigen Schritt. Ein einfacher Fall erfordert möglicherweise eine Antwort; Bei einem komplexen Fall kann es erforderlich sein, Details zu sammeln, eine Akte zu prüfen, eine Antwort zu verfassen und sie an einen Menschen weiterzuleiten.

- Handeln: Der Agent kann abhängig von seinen Berechtigungen antworten, klassifizieren, zusammenfassen, markieren, weiterleiten, entwerfen, einen Datensatz aktualisieren, ein Tool aufrufen oder eine Genehmigung anfordern.

- Beobachten: Das System zeichnet auf, was passiert ist, sucht nach Fehlern oder geringem Vertrauen und stellt den Menschen genügend Informationen zur Verfügung, um den Arbeitsablauf zu prüfen, zu verbessern oder zu übernehmen.

Taxonomie der Agententypen

Nicht alle KI-Agenten sind gleich aufgebaut. Das Verständnis der Taxonomie hilft Käufern, den richtigen Typ für den richtigen Job zu finden.

- Gesprächsagenten Fokus auf Dialog: Beantwortung von Fragen, Klärung von Anfragen und Führung von Benutzern durch einen Entscheidungsbaum. Sie zeichnen sich durch Unterstützung, Qualifizierung und Triage an vorderster Front aus. Die wichtigste Bewertungsfrage ist, ob der Agent den Kontext über die Runden hinweg beibehält, mit Unklarheiten elegant umgeht und eskaliert, wenn das Gespräch seine Wissensgrenze überschreitet.

- Workflow-Agenten Konzentrieren Sie sich auf die Aufgabenausführung: einem definierten Prozess folgen, Bedingungen überprüfen, Systeme aktualisieren und mehrstufige Arbeiten abschließen. Sie zeichnen sich durch Vorgänge wie Auftragsabwicklung, Rückgabeautorisierung, Kontoänderungen und Datensynchronisierung aus. Die zentrale Bewertungsfrage ist, ob der Agent den Arbeitsablauf zuverlässig befolgt, Randfälle behandelt, jeden Schritt protokolliert und ordnungsgemäß ausfällt, wenn etwas schief geht.

- Multiagentensysteme Kombinieren Sie mehrere Agenten, die sich auf Funktion, Datenzugriff oder Fähigkeiten spezialisieren können. Ein Agent kümmert sich möglicherweise um die Kundenidentifizierung, ein anderer um den Abruf von Richtlinien, eine andere Aktionsausführung und eine andere Qualitätsprüfung. Die zentrale Bewertungsfrage ist, wie Agenten koordinieren, ob Übergaben den Kontext bewahren, wie sich Fehler ausbreiten und wer das Gesamtsystem überwacht.

Viele Plattformen verwischen diese Grenzen. Ein Konversationsagent kann Arbeitsabläufe auslösen. Ein Arbeitsablaufagent kann Konversationsschritte umfassen. Entscheidend ist, die Hauptaufgabe zu verstehen und dann zu bewerten, ob die Architektur der Plattform diese Aufgabe mit geeigneten Kontrollen unterstützt.

Autonomie ist ein Spektrum

Die wichtigste Kauffrage ist nicht, ob der Makler autonom ist. Hier beginnt und endet die Autonomie. Ein schreibgeschützter Agent, der anhand öffentlicher Unterlagen antwortet, birgt ein anderes Risiko als ein Agent, der den Kontostatus ändert, Rückerstattungen ausstellt, ein CRM aktualisiert oder Nachrichten im Namen eines Menschen sendet. Käufer sollten Lieferanten bitten, die Autonomie nach Workflow-Schritten abzubilden: Welche Schritte erfolgen automatisch, welche erfordern eine Genehmigung, welche lösen eine Eskalation aus und welche werden vollständig blockiert.

Multiagenten-Orchestrierung

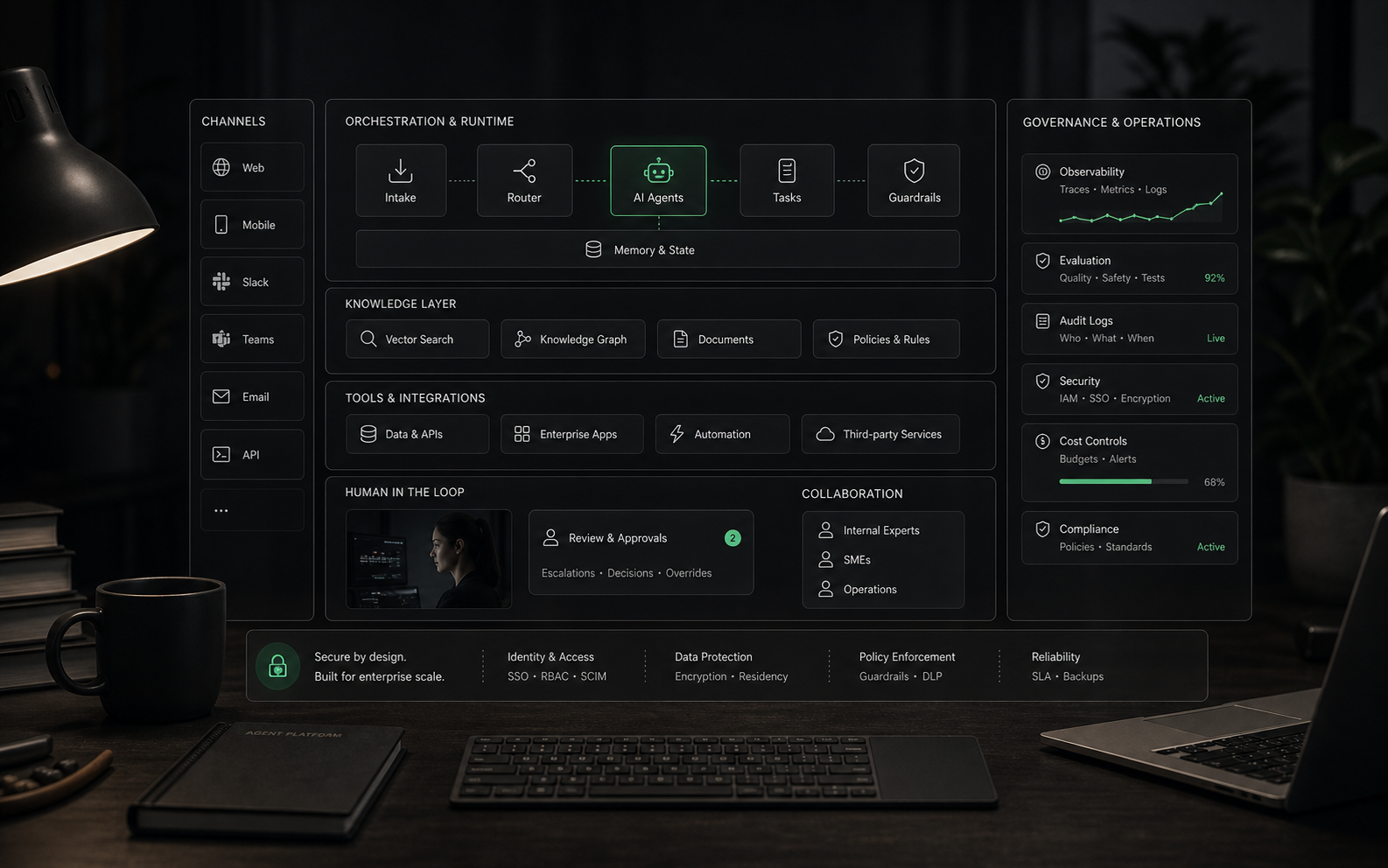

Wenn ein Arbeitsablauf das überschreitet, was ein einzelner Agent zuverlässig bewältigen kann, verwenden Plattformen möglicherweise mehrere Agenten, die sich koordinieren. Das Verständnis von Orchestrierungsmustern ist für die Bewertung komplexer Automatisierungsansprüche von entscheidender Bedeutung.

Koordinationsmodelle: Agenten können sich über einen zentralen Orchestrator koordinieren, der Aufgaben weiterleitet und Ergebnisse aggregiert, oder über Peer-to-Peer-Übergaben, bei denen jeder Agent den Kontext an den nächsten weitergibt. Die zentrale Orchestrierung bietet mehr Transparenz und Kontrolle; Peer-Übergaben können schneller, aber schwieriger zu debuggen sein. Fragen Sie die Anbieter, welches Modell sie verwenden und wie mit Fehlern umgegangen wird.

Übergabequalität: Wenn ein Agent an einen anderen übergibt, sollte der empfangende Agent über genügend Kontext verfügen, um ohne wiederholte Fragen fortzufahren. Dies erfordert einen gemeinsamen Speicher, einen strukturierten Konversationsstatus oder eine explizite Kontextübergabe. Eine schwache Übergabe fühlt sich an, als würde man von vorne beginnen; Eine starke Übergabe ist für den Endbenutzer unsichtbar.

Geteilter Zustand: Multi-Agenten-Systeme benötigen eine Möglichkeit, Informationen auszutauschen: Kundenkontext, Gesprächsverlauf, getroffene Entscheidungen, ergriffene Maßnahmen und aktueller Workflow-Status. Dieser gemeinsame Status sollte für menschliche Prüfer abfragbar, überprüfbar und sichtbar sein. Ohne sie arbeitet jeder Agent isoliert und der gesamte Arbeitsablauf wird fragil.

Konfliktlösung: Wenn Agenten anderer Meinung sind oder widersprüchliche Ergebnisse liefern, benötigt die Plattform einen Lösungsmechanismus. Dies kann ein Aufsichtsagent, ein regelbasierter Schiedsrichter, ein menschlicher Eskalationspfad oder eine konfidenzgewichtete Auswahl sein. Fragen Sie Anbieter, was passiert, wenn zwei Agenten unterschiedliche Antworten oder Empfehlungen geben.

Fehlerausbreitung: Wenn ein Agent in einer Kette ausfällt, müssen die nachgeschalteten Agenten davon erfahren. Die Fehlerbehandlung umfasst Wiederholungslogik, Fallback-Pfade, ordnungsgemäße Verschlechterung und menschliche Benachrichtigung. Ein robustes Multiagentensystem isoliert Ausfälle und verhindert den Zusammenbruch einer Kaskade.

Wo KI-Agenten Werte schaffen

KI-Agenten sind am nützlichsten, wenn die Arbeit wiederholbar, aber nicht perfekt skriptgesteuert ist. Im Kundensupport kann das bedeuten, ein Problem zu diagnostizieren, die richtige Richtlinie zu finden, den Verlauf zusammenzufassen und an die richtige Warteschlange weiterzuleiten. Im E-Commerce kann es sich dabei um die Beantwortung von Bestellfragen, die Prüfung von Rücksendeproblemen oder das Sammeln der Details handeln, die ein Mitarbeiter benötigt, um eine Rückerstattung zu genehmigen. Im Vertrieb und Betrieb kann es bedeuten, Anfragen zu qualifizieren, Entwürfe vorzubereiten, Aufzeichnungen zu aktualisieren oder einen Workflow zu starten, nachdem die erforderlichen Prüfungen bestanden wurden.

Vertikale Branchenbeispiele

Die Anforderungen an KI-Agenten variieren je nach Branche erheblich. Was für ein E-Commerce-Geschäft funktioniert, kann im Gesundheitswesen oder bei Finanzdienstleistungen scheitern. Käufer sollten Plattformen anhand der Einschränkungen ihrer spezifischen Branche bewerten.

Gesundheitswesen: Agenten, die Patientenanfragen bearbeiten, müssen HIPAA und ähnliche Vorschriften beachten. Zu den wichtigsten Überlegungen gehören: Datenresidenz und Zugriffskontrollen, Prüfprotokollierung für PHI-Exposition, Einwilligungsverwaltung, Integration mit elektronischen Gesundheitsakten und klare Eskalationspfade für die klinische Beurteilung. Ein Agent, der Termine vereinbart oder Erinnerungen verschickt, kann akzeptabel sein; Ein Agent, der Symptome interpretiert oder eine Behandlung empfiehlt, betritt reguliertes Gebiet. Bitten Sie Anbieter um dokumentierte HIPAA-Konformität, Vereinbarungen mit Geschäftspartnern und spezifische Leitlinien für klinische Inhalte.

Fintech und Finanzdienstleistungen: Agenten, die Finanzanfragen bearbeiten, unterliegen einer behördlichen Prüfung in Bezug auf Beratung, Transaktionsautorisierung, Betrugserkennung und Prüfprotokolle. Zu den wichtigsten Überlegungen gehören: rollenbasierte Zugriffskontrollen für sensible Daten, Transaktionslimits und Genehmigungsworkflows, Compliance-Protokollierung zur behördlichen Überprüfung, Integration mit Kernbank- und Zahlungssystemen sowie eine klare Trennung zwischen Informationsantworten und Finanzberatung. Ein Makler, der eine Gebührenordnung erläutert, unterscheidet sich von einem Makler, der Anlageprodukte empfiehlt. Fragen Sie Anbieter nach ihren Compliance-Zertifizierungen, Audit-Fähigkeiten und wie sie mit den Grenzen regulierter Beratung umgehen.

B2B-SaaS: Agenten im B2B-Kontext benötigen häufig eine umfassende Integration mit Produktfunktionen, Kundendaten und internen Arbeitsabläufen. Zu den wichtigsten Überlegungen gehören: mandantenfähige Datenisolierung, rollenbewusste Antworten basierend auf Kundenstufe und Berechtigungen, Integrationstiefe mit CRM-, Abrechnungs- und Supportsystemen, Fähigkeit zur Handhabung komplexer technischer Arbeitsabläufe und Eskalationspfade, die den Kundenkontext bewahren. B2B-Käufer sollten Agenten anhand realer Kundenszenarien testen, nicht anhand allgemeiner Support-Skripte.

Einzelhandel und E-Commerce: Agenten sind mit einem hohen Aufkommen, saisonalen Spitzen und Kundenerwartungen hinsichtlich einer schnellen Lösung konfrontiert. Zu den wichtigsten Überlegungen gehören: Integration mit Auftragsverwaltungs-, Bestands- und Versandsystemen, Abwicklung von Rücksendungen, Rückerstattungen und Umtausch innerhalb der Richtliniengrenzen, Personalisierung basierend auf der Kaufhistorie ohne Überschreitung der Privatsphäre und klare Übergabe an menschliche Agenten bei komplexen Problemen wie beschädigten Waren oder Betrugsansprüchen. Der Agent sollte Routinefragen in großem Umfang bearbeiten und gleichzeitig die Margen und den Ruf der Marke schützen.

Werkzeugaufruftiefe

Moderne KI-Agenten generieren nicht nur Text – sie können Funktionen aufrufen, APIs aufrufen und Aktionen in verbundenen Systemen auslösen. Das Verständnis der Tool-Aufrufmuster ist für die Bewertung der Plattformfähigkeit und -sicherheit von entscheidender Bedeutung.

Funktionsaufrufmuster: Auf einer grundlegenden Ebene rufen Agenten Tools auf, um Informationen abzurufen: einen Bestellstatus nachschlagen, eine Wissensdatenbank durchsuchen, Kontodetails abrufen. Auf mittleren Ebenen können Agenten Datensätze aktualisieren, Tickets erstellen, Benachrichtigungen senden oder Workflows auslösen. Auf fortgeschrittenen Ebenen können Agenten mehrere Tool-Aufrufe verketten, Entscheidungen auf der Grundlage von Zwischenergebnissen treffen und mehrstufige Transaktionen ausführen. Fragen Sie die Anbieter, welche Ebenen des Tool-Aufrufs unterstützt werden und welche Einschränkungen gelten.

API-Integration: Agenten müssen eine Verbindung zu Geschäftssystemen herstellen: Helpdesks, CRMs, ERPs, Zahlungsabwickler, Versandanbieter, interne APIs. Bei der Integrationsfrage geht es nicht nur darum, ob die Plattform über Konnektoren verfügt, sondern auch darum, wie diese Konnektoren konfiguriert, authentifiziert, überwacht und aktualisiert werden. Point-and-Click-Integrationen sind einfacher bereitzustellen, weisen jedoch möglicherweise einen Mangel an Flexibilität auf. Benutzerdefinierte Integrationen bieten Kontrolle, erfordern jedoch Entwicklungsressourcen.

Berechtigungsgrenzen: Jeder Tool-Aufruf sollte innerhalb definierter Berechtigungen ausgeführt werden. Der Agent sollte keinen flächendeckenden Zugriff auf alle Kundendaten oder alle Systemfunktionen haben. Berechtigungen sollten nach Rolle, Kunde, Datentyp und Aktion festgelegt werden. Fragen Sie Anbieter, wie Berechtigungen konfiguriert sind, wie sie zur Laufzeit durchgesetzt werden und was einen Agenten daran hindert, einen nicht autorisierten Endpunkt anzurufen – selbst wenn der Agent dies begründet.

Fehlerbehandlung: Toolaufrufe schlagen fehl. APIs geben Fehler zurück, Ratengrenzen werden erreicht, Systeme fallen aus, Daten fehlen. Ein robuster Agent geht mit diesen Fehlern elegant um: Erneut versuchen mit Backoff, auf alternative Tools zurückgreifen, an Menschen eskalieren oder den Benutzer klar informieren. Bitten Sie die Anbieter, Fehlerszenarien zu demonstrieren und zu zeigen, wie der Agent reagiert.

Beobachtbarkeit: Jeder Tool-Aufruf sollte protokolliert werden: was aufgerufen wurde, mit welchen Parametern, was zurückgegeben wurde und wie der Agent dieses Ergebnis verwendet hat. Diese Beobachtbarkeit ist für Debugging, Auditing, Compliance und Optimierung von entscheidender Bedeutung. Fragen Sie Anbieter, wie Werkzeugaufrufprotokolle gespeichert werden, wie lange sie aufbewahrt werden, wer darauf zugreifen kann und wie sie zur Überprüfung vorgelegt werden.

Was Käufer bewerten sollten

- Wissensvermittlung: Welche Quellen nutzt der Agent, wie aktuell sind diese und kann daraus hervorgehen, warum eine Antwort gewählt wurde?

- Aktionsberechtigungen: Was kann der Agent ohne Genehmigung lesen, schreiben, aktualisieren, auslösen oder übermitteln?

- Workflow-Grenzwerte: Welche Aufgaben liegen explizit außerhalb des Umfangs und wie verhält sich der Agent, wenn die Konfidenz niedrig ist?

- Menschliche Übergabe: Kann eine Person mit intaktem Gesprächsverlauf, Kundenkontext und den Argumentationsversuchen des Agenten übernehmen?

- Überprüfbarkeit: Kann das Team Antworten, Maßnahmen, Eskalationen und Fehler im Nachhinein überprüfen?

- Laufende Verbesserung: Zeigt die Plattform unbeantwortete Absichten, veraltete Inhalte, schlechte Übergaben und wiederholte Fehlermuster?

Demo-Fragen, die Tiefe offenbaren

- Zeigen Sie den Agenten, der eine echte Kundenfrage bearbeitet, die einen Richtlinienkontext und keine allgemeine FAQ-Antwort erfordert.

- Zeigen Sie, was passiert, wenn das Quellmaterial widersprüchlich ist oder fehlt.

- Zeigen Sie, welche Aktionen einer Genehmigung bedürfen und welche Aktionen der Agent selbst durchführen kann.

- Zeigen Sie das Übergabeprotokoll an, das ein Mensch nach der Eskalation erhält.

- Zeigen Sie, wie das Team schlechte Antworten überprüft und die Wissensdatenbank oder Workflow-Regeln verbessert.

Evaluierungstests vor dem Start

- Historischer Falltest: Führen Sie reale vergangene Gespräche durch den Agenten und vergleichen Sie die vorgeschlagene Antwort, Weiterleitung und Übergabe mit dem, was ein starker menschlicher Bediener getan hätte.

- Test auf fehlenden Kontext: Entfernen Sie die erforderliche Quelle oder machen Sie die Kundenanfrage mehrdeutig und stellen Sie dann sicher, dass der Agent um Klarstellung bittet oder eskaliert, anstatt eine sichere Antwort zu erfinden.

- Berechtigungstest: Bitten Sie den Agenten, eine Aktion auszuführen, die er nicht ausführen darf, z. B. eine Rückerstattung ausstellen, Kontodaten ändern oder eingeschränkte Informationen preisgeben.

- Systemfehlertest: Trennen Sie ein Tool, von dem der Agent abhängig ist, oder stufen Sie es herab, und überprüfen Sie, ob Benutzererfahrung, Protokolle und Eskalationspfad klar bleiben.

- Regressionstest: Führen Sie nach dem Ändern von Eingabeaufforderungen, Workflow-Regeln oder Wissensquellen einen festen Bewertungssatz erneut aus, um sicherzustellen, dass älteres Verhalten nicht stillschweigend unterbrochen wird.

Modellüberlegungen

Das zugrunde liegende KI-Modell prägt das Verhalten, die Kosten, die Latenz und die Leistungsfähigkeit des Agenten. Käufer sollten verstehen, wie sich die Modellauswahl auf ihre Bereitstellung auswirkt und welche Kompromisse jede Option mit sich bringt.

Modellauswahl: Einige Plattformen bieten ein einziges Modell an; andere lassen einem die Wahl. Größere Modelle (GPT-4, Claude 3 Opus) bieten eine bessere Begründung, Befolgung von Anweisungen und Nuancen, kosten aber mehr und reagieren langsamer. Kleinere Modelle (GPT-4o-mini, Claude Haiku) sind schneller und billiger, haben jedoch möglicherweise Probleme mit komplexen Überlegungen oder Randfällen. Spezialisierte Modelle können auf bestimmte Bereiche oder Aufgaben zugeschnitten werden. Fragen Sie die Anbieter, welche Modelle verfügbar sind, wie die Auswahl funktioniert und ob Sie Modelle für verschiedene Anwendungsfälle kombinieren können.

Verhaltensunterschiede: Die Modelle unterscheiden sich darin, wie sie Anweisungen befolgen, mit Mehrdeutigkeiten umgehen, unsichere Anfragen ablehnen und Ausgaben strukturieren. Die gleiche Eingabeaufforderung kann bei verschiedenen Modellen zu unterschiedlichen Ergebnissen führen. Testen Sie bei der Evaluierung von Plattformen mit den Modellen, die Sie in der Produktion verwenden möchten. Eine Demo, die auf einem Modell funktioniert, verhält sich möglicherweise auf einem anderen anders.

Kostenstruktur: KI-Agenten verbrauchen Token für jede Eingabe, Ausgabe und jeden Toolaufruf. Multi-Turn-Gespräche, RAG-Abruf und Tool-Anrufe können die Kosten schnell vervielfachen. Bitten Sie Anbieter um klare Preise für: Eingabe-Tokens, Ausgabe-Tokens, Tool-Aufrufe, Abrufvorgänge und etwaige feste Plattformgebühren. Verstehen Sie, wie die Kosten mit der Nutzung skalieren und welche Kontrollen es gibt, um unkontrollierte Ausgaben zu begrenzen.

Latenz: Die Reaktionszeit des Modells wirkt sich direkt auf die Benutzererfahrung aus. Komplexe Argumentation, große Kontextfenster und mehrere Toolaufrufe erhöhen die Latenz. Fragen Sie Anbieter nach typischen Antwortzeiten unter realistischer Auslastung, wie die Plattform mit Zeitüberschreitungen umgeht und ob Caching oder Streaming die wahrgenommene Leistung verbessert.

Modellaktualisierungen: KI-Modelle werden regelmäßig aktualisiert. Neue Versionen verhalten sich möglicherweise anders als alte. Fragen Sie Anbieter, wie sie mit der Modellversionierung umgehen, ob Sie sie an bestimmte Modellversionen anheften können und wie sie wichtige Änderungen kommunizieren. Eine plötzliche Modelländerung kann das Agentenverhalten in der Produktion stören.

Feinabstimmung und kundenspezifische Modelle: Einige Plattformen bieten eine Feinabstimmung oder ein individuelles Modelltraining für Ihre Daten an. Dies kann die Leistung für bestimmte Domänen oder Arbeitsabläufe verbessern, erhöht jedoch die Komplexität, die Kosten und den Wartungsaufwand. Fein abgestimmte Modelle erfordern fortlaufende Aktualisierungen, während sich Ihre Wissensdatenbank weiterentwickelt. Fragen Sie Anbieter, welche Feinabstimmungsoptionen es gibt, welche Daten benötigt werden und wie Updates verwaltet werden.

Kennzahlen, die wichtig sind

Nützliche KI-Agentenmetriken messen die abgeschlossene Arbeit, nicht nur das Gesprächsvolumen. Verfolgen Sie die Aufgabenerledigungsrate, die korrekte Eskalationsrate, die Antwortgenauigkeit bei überprüften Proben, die Rate menschlicher Überschreibungen, die Fehlerrate bei Tool-Anrufen, die Zeit bis zur Lösung, die Kosten pro abgeschlossenem Workflow, wiederholte Fehlerthemen und die Kundenzufriedenheit nach durch Agenten unterstützten Interaktionen. Seien Sie vorsichtig mit der Durchbiegung als eigenständiger Metrik. Ein vermiedenes menschliches Gespräch ist kein Gewinn, wenn die Antwort falsch, unvollständig oder frustrierend war.

Konkrete Beispiele und Nicht-Beispiele

- Beispiel: Ein Supportmitarbeiter identifiziert eine Frage zur Abrechnung, ruft die aktuelle Richtlinie ab, überprüft die Kontostufe, verfasst eine Antwort und eskaliert diese zur Genehmigung, da der Kunde eine Gebühr bestreitet.

- Beispiel: Ein E-Commerce-Agent sammelt Bestellnummer, Versandstatus, Rückgabegrund und Produktzustand, bevor er den Fall an das richtige Team weiterleitet, wobei der erforderliche Kontext bereits angehängt ist.

- Nicht-Beispiel: Ein Pop-up, das drei Skriptfragen aus einer statischen FAQ beantwortet, aber keinen Kundenkontext, Tools, Eskalationsregeln oder eine Nachbesprechung nach dem Gespräch verwenden kann.

- Kein Beispiel: eine Workflow-Automatisierungsregel, die Tickets nur auf der Grundlage von Schlüsselwörtern weiterleitet. Es mag eine nützliche Automatisierung sein, aber es ist kein KI-Agent, es sei denn, es interpretiert den Kontext und operiert innerhalb definierter Argumentations- und Berechtigungsgrenzen.

Häufige Warnsignale

Seien Sie vorsichtig, wenn eine Agent-Demo auf ausgefeilten Beispieldaten basiert, Grenzfälle vermeidet oder die Verwendung von Quellen und Aktionsberechtigungen nicht erklären kann. Weitere Warnzeichen sind vage Angaben zur Autonomie, kein klarer Eskalationspfad, kein Prüfpfad und die Preisgestaltung, die sich erheblich ändert, sobald das tatsächliche Gesprächsvolumen, Sitzplätze, Kanäle oder Workflow-Aktionen berücksichtigt werden.

Verwandte Konzepte

KI-Agenten stehen zwischen mehreren benachbarten Ideen: Chatbots, Copiloten, Workflow-Automatisierung, RAG, Tool-Calling und Human-in-the-Loop-Überprüfung. Der sicherste Bewertungsansatz besteht darin, zuerst den Job zu definieren und dann zu entscheiden, welche Kombination aus Gespräch, Abruf, Tools, Genehmigungen, Analysen und menschlicher Eskalation erforderlich ist. Dadurch bleibt der Kaufprozess auf der betrieblichen Realität und nicht auf der Terminologie des Anbieters verankert.

Startbereitschaft

Ein Produktions-KI-Agent sollte mit einem Testsatz, einem Rollback-Plan, benannten Eigentümern, Überprüfungsschwellenwerten und einem bekannten Fallback-Pfad starten. Käufer sollten sich fragen, wer die Gespräche in der ersten Woche beobachtet, wie Mängel selektiert werden, wie schnell schlechte Antworten korrigiert werden können und welche Kennzahlen darüber entscheiden, ob der Agent erweitert oder pausiert. Ohne diesen Betriebsplan kann selbst eine vielversprechende Demo im realen Kundenverkehr brüchig werden.

Welche starken Inhalte deutlich machen sollen

Eine seriöse KI-Agent-Seite sollte dem Leser ein brauchbares Betriebsmodell bieten: Definieren Sie den Job, definieren Sie die Daten, definieren Sie die Tools, definieren Sie Berechtigungen, definieren Sie die menschliche Grenze, definieren Sie Tests und definieren Sie die Überprüfungsschleife. Wenn ein Anbieter diese Schichten nicht erklären kann, evaluiert der Käufer kein Agentensystem; Sie evaluieren eine Demo.

Zu überprüfende Quellen

Verwenden Sie diese Referenzen, um den Begriff zu verstehen und die Angaben der Anbieter zu Drucktests zu machen. Produktspezifische Details müssen noch anhand aktueller Lieferantenmaterialien überprüft werden.

FAQ

Häufige Fragen

Ist ein KI-Agent dasselbe wie ein Chatbot?

Nicht immer. Ein Chatbot bleibt normalerweise im Gespräch. Ein KI-Agent kann außerdem Geschäftswissen heranziehen, vernetzte Tools verwenden, genehmigte Maßnahmen ergreifen und je nach Kontext eskalieren.

Was macht den Einsatz eines KI-Agenten in Geschäftsabläufen sicherer?

Definierte Berechtigungen, zuverlässige Wissensquellen, menschliche Übergabe, Aktionsprotokolle, Tests und klare Grenzen dessen, was der Agent ohne Genehmigung tun kann.

Kann ein KI-Agent ein Support-Team ersetzen?

So sollte man es nicht bewerten. Eine bessere Frage ist, welche wiederholbaren Arbeiten der Agent bewältigen kann, wo der Mensch die Kontrolle behalten sollte und ob das System die Antwortqualität verbessert, ohne versteckte Risiken zu schaffen.

Was ist der Unterschied zwischen einem KI-Agenten und einem KI-Assistenten?

Ein KI-Assistent hilft einer Person normalerweise bei der Erledigung der Arbeit, indem er antwortet, Entwürfe verfasst, zusammenfasst oder nächste Schritte vorschlägt. Ein KI-Agent kann noch weiter gehen, indem er einem Arbeitsablauf folgt, Tools verwendet, den Kontext beibehält und zulässige Aktionen innerhalb definierter Grenzen durchführt. Der Unterschied ist nicht immer klar, daher sollten Käufer fragen, was das System lesen, schreiben, auslösen, genehmigen und eskalieren kann, anstatt sich auf die Bezeichnung zu verlassen.

Was ist ein Beispiel für einen KI-Agenten im Kundensupport?

Ein praktischer Support-Mitarbeiter kann das Problem eines Kunden identifizieren, die entsprechende Richtlinie abrufen, den Bestell- oder Kontokontext überprüfen, eine Antwort entwerfen, das Gespräch markieren und eskalieren, wenn der Fall eine menschliche Beurteilung erfordert. Der wichtige Teil ist nicht, dass der Agent eine Nachricht schreibt; Es geht darum, einen begrenzten Support-Workflow voranzutreiben und gleichzeitig genügend Kontext für die Überprüfung beizubehalten.

Welche verschiedenen Arten von KI-Agenten gibt es?

Die Haupttypen sind Konversationsagenten (dialogorientiert für Unterstützung, Triage und Anleitung), Workflowagenten (aufgabenausführungsorientiert für Vorgänge wie Auftragsabwicklung und Kontoänderungen) und Multiagentensysteme (mehrere koordinierte Agenten für komplexe Arbeitsabläufe). Viele Plattformen kombinieren diese Typen. Entscheidend ist die Anpassung der Agentenarchitektur an die Jobanforderungen.

Wie arbeiten mehrere KI-Agenten zusammen?

Multiagentensysteme koordinieren durch zentrale Orchestrierung oder Peer-to-Peer-Übergaben. Sie teilen den Kontext über einen gemeinsamen Zustand, geben strukturierte Informationen zwischen Agenten weiter und benötigen eine Konfliktlösung, wenn die Ergebnisse nicht übereinstimmen. Zu den wichtigsten Bewertungsfragen gehören: Wie Übergaben den Kontext bewahren, wie sich Fehler ausbreiten, wer das Gesamtsystem überwacht und wie Konflikte gelöst werden.

Was sollte ich zu Tool-Aufrufen und Integrationen fragen?

Fragen Sie, welche Funktionsaufrufebenen unterstützt werden (schreibgeschützt, schreibend, transaktional), wie API-Integrationen konfiguriert und authentifiziert werden, welche Berechtigungsgrenzen für jedes Tool gelten, wie mit Fehlern und Ratenbegrenzungen umgegangen wird und wie jeder Toolaufruf protokolliert und geprüft wird. Das Aufrufen von Tools ohne entsprechende Berechtigungen und Überwachung führt zu Betriebs- und Sicherheitsrisiken.

Wie wirken sich Branchenanforderungen auf die Auswahl von KI-Agenten aus?

Das Gesundheitswesen erfordert HIPAA-Konformität, PHI-Kontrollen und klare klinische Grenzen. Fintech erfordert Prüfpfade, die Einhaltung gesetzlicher Vorschriften und Beratungsgrenzen. B2B-SaaS erfordert mandantenfähige Isolation, tiefe Integrationen und rollenbewusste Reaktionen. Der Einzelhandel erfordert die Abwicklung großer Mengen, die Integration in Bestellsysteme und die Markenkonsistenz. Bewerten Sie Plattformen anhand Ihrer spezifischen vertikalen Einschränkungen, nicht anhand allgemeiner Benchmarks.

Wie wirkt sich die Modellauswahl auf die Leistung von KI-Agenten aus?

Größere Modelle bieten eine bessere Argumentation, kosten aber mehr und reagieren langsamer. Kleinere Modelle sind schneller und kostengünstiger, haben jedoch möglicherweise Probleme mit der Komplexität. Das Modellverhalten variiert: Dieselbe Eingabeaufforderung führt modellübergreifend zu unterschiedlichen Ergebnissen. Die Kosten summieren sich durch Eingabe-Tokens, Ausgabe-Tokens und Tool-Aufrufe. Die Latenz wirkt sich auf die Benutzererfahrung aus. Fragen Sie Anbieter nach Modelloptionen, Preistransparenz, Latenz unter Last und wie Modellaktualisierungen gehandhabt werden.

Wie autonom sollte ein KI-Agent sein?

Die Autonomie sollte dem Risiko des Arbeitsablaufs entsprechen. Für Aufgaben mit geringem Risiko wie das Zusammenfassen einer Konversation oder das Vorschlagen eines Hilfeartikels sind möglicherweise weniger strenge Kontrollen erforderlich. Für kundenrelevante Aktionen wie Rückerstattungen, Kontoänderungen, Abrechnungsentscheidungen oder öffentliche Antworten sollten stärkere Berechtigungen, Genehmigungstore, Prüfprotokolle und Fallback-Regeln gelten.

Was sollten Käufer in einer KI-Agent-Demo fragen?

Bitten Sie den Anbieter, echte historische Beispiele und nicht nur ausgefeilte Beispielaufforderungen auszuführen. Die Demo sollte den Quellabruf, Tool-Berechtigungen, was passiert, wenn Kontext fehlt, wie der Agent eskaliert, was Menschen während der Übergabe sehen, wie Aktionen protokolliert werden und wie schlechte Antworten nach dem Start korrigiert werden, zeigen.

Was sind die größten Risiken von KI-Agenten?

Die größten Risiken sind in der Regel betrieblicher Natur: veraltetes Wissen, zu weitreichende Tool-Berechtigungen, schwache Eskalation, versteckte Kosten durch lange, mehrstufige Arbeitsabläufe, schlechte Tests, unklare Verantwortlichkeiten und Kennzahlen, die Abweichung statt korrekter Ergebnisse belohnen. Käufer sollten das Betriebsmodell rund um den Agenten ebenso sorgfältig bewerten wie die Modellergebnisse.

Wie messen Sie, ob ein KI-Agent funktioniert?

Zu den nützlichen Maßnahmen gehören die Abschlussrate von Aufgaben, die Rate der korrekten Eskalation, die Genauigkeit überprüfter Antworten, die Fehlerrate bei Tool-Anrufen, die Rate menschlicher Übersteuerungen, die Zeit bis zur Lösung, wiederholte Fehlerthemen und die Kundenzufriedenheit nach Gesprächen mit Agentenunterstützung. Die Gesprächslautstärke allein reicht nicht aus, da ein Agent mit hohem Gesprächsaufkommen immer noch zu schlechten Ergebnissen führen kann.