Ce que signifie le terme en pratique

Pour les acheteurs professionnels, un agent IA n’est pas seulement une fenêtre de discussion avec une étiquette plus récente. Il s'agit d'un système capable de comprendre l'intention, de récupérer le contexte commercial pertinent, de décider de la prochaine étape autorisée et de répondre, acheminer, rédiger, mettre à jour, déclencher ou escalader. La définition utile dépend des limites du flux de travail : ce que l'agent peut faire par lui-même, ce qui nécessite une approbation et ce qui doit être transféré à un humain.

En quoi diffère-t-il d'un chatbot

- Un chatbot de base suit généralement un modèle de conversation : répondre à une question, collecter une piste ou diriger quelqu'un vers une page.

- Un agent IA peut utiliser ses connaissances métier, le contexte client, les autorisations et les outils connectés pour faire progresser une tâche.

- La distinction ne réside pas dans le mot agent. La distinction est de savoir si le système peut raisonner sur le contexte, prendre des mesures limitées, préserver l'état et escalader avec un contexte de transfert utile.

- Un produit peut s'appeler un agent tout en se comportant comme un simple chatbot s'il ne peut pas utiliser des connaissances fiables, déclencher des flux de travail approuvés ou exposer des contrôles de révision.

Comment fonctionne un agent IA

- Interpréter : le système transforme une demande en intention, en tâche ou en objectif. Dans un flux de travail d'entreprise, cela peut impliquer d'identifier si un client a besoin d'un dépannage, d'une aide pour commander, d'une révision de la facturation ou d'une escalade.

- Ground : l'agent récupère ou reçoit du contexte à partir de sources approuvées telles que le contenu d'aide, les politiques, les données de compte, les enregistrements de commandes, les tickets précédents ou les notes de processus internes.

- Plan : l'agent décide de la prochaine étape autorisée. Un cas simple peut nécessiter une seule réponse ; un cas complexe peut nécessiter la collecte de détails, la vérification d'un dossier, la rédaction d'une réponse et l'acheminement vers un humain.

- Agir : l'agent peut répondre, classer, résumer, taguer, acheminer, rédiger, mettre à jour un enregistrement, appeler un outil ou demander une approbation en fonction de ses autorisations.

- Observer : le système enregistre ce qui s'est passé, surveille les échecs ou le manque de confiance et fournit aux humains suffisamment d'informations pour auditer, améliorer ou reprendre le flux de travail.

Taxonomie des types d'agents

Tous les agents IA ne sont pas construits de la même manière. Comprendre la taxonomie aide les acheteurs à faire correspondre le bon type au bon travail.

- Agents conversationnels se concentrer sur le dialogue : répondre aux questions, clarifier les demandes et guider les utilisateurs à travers un arbre de décision. Ils excellent dans le soutien de première ligne, la qualification et le triage. La question clé de l'évaluation est de savoir si l'agent maintient le contexte à chaque tour, gère l'ambiguïté avec élégance et s'intensifie lorsque la conversation dépasse ses limites de connaissances.

- Agents de flux de travail se concentrer sur l'exécution des tâches : suivre un processus défini, vérifier les conditions, mettre à jour les systèmes et effectuer un travail en plusieurs étapes. Ils excellent dans des opérations telles que le traitement des commandes, l'autorisation de retour, les modifications de compte et la synchronisation des données. La question clé de l'évaluation est de savoir si l'agent suit le flux de travail de manière fiable, gère les cas extrêmes, enregistre chaque étape et échoue correctement en cas de problème.

- Systèmes multi-agents combinez plusieurs agents qui peuvent se spécialiser par fonction, accès aux données ou compétence. Un agent peut gérer l'identification du client, un autre la récupération des politiques, un autre l'exécution des actions et un autre examen de la qualité. La question clé de l'évaluation est de savoir comment les agents se coordonnent, si les transferts préservent le contexte, comment les échecs se propagent et qui surveille l'ensemble du système.

De nombreuses plateformes brouillent ces frontières. Un agent conversationnel peut déclencher des workflows. Un agent de workflow peut inclure des étapes conversationnelles. Ce qui compte, c'est de comprendre la tâche principale, puis d'évaluer si l'architecture de la plateforme prend en charge cette tâche avec des contrôles appropriés.

L'autonomie est un spectre

La question d’achat la plus importante n’est pas de savoir si l’agent est autonome. C’est là que commence et s’arrête l’autonomie. Un agent en lecture seule qui répond à partir d'une documentation publique comporte un risque différent de celui d'un agent qui modifie le statut du compte, émet des remboursements, met à jour un CRM ou envoie des messages au nom d'un humain. Les acheteurs doivent demander aux fournisseurs de cartographier l'autonomie par étape du flux de travail : quelles étapes sont automatiques, lesquelles nécessitent une approbation, lesquelles déclenchent une escalade et lesquelles sont entièrement bloquées.

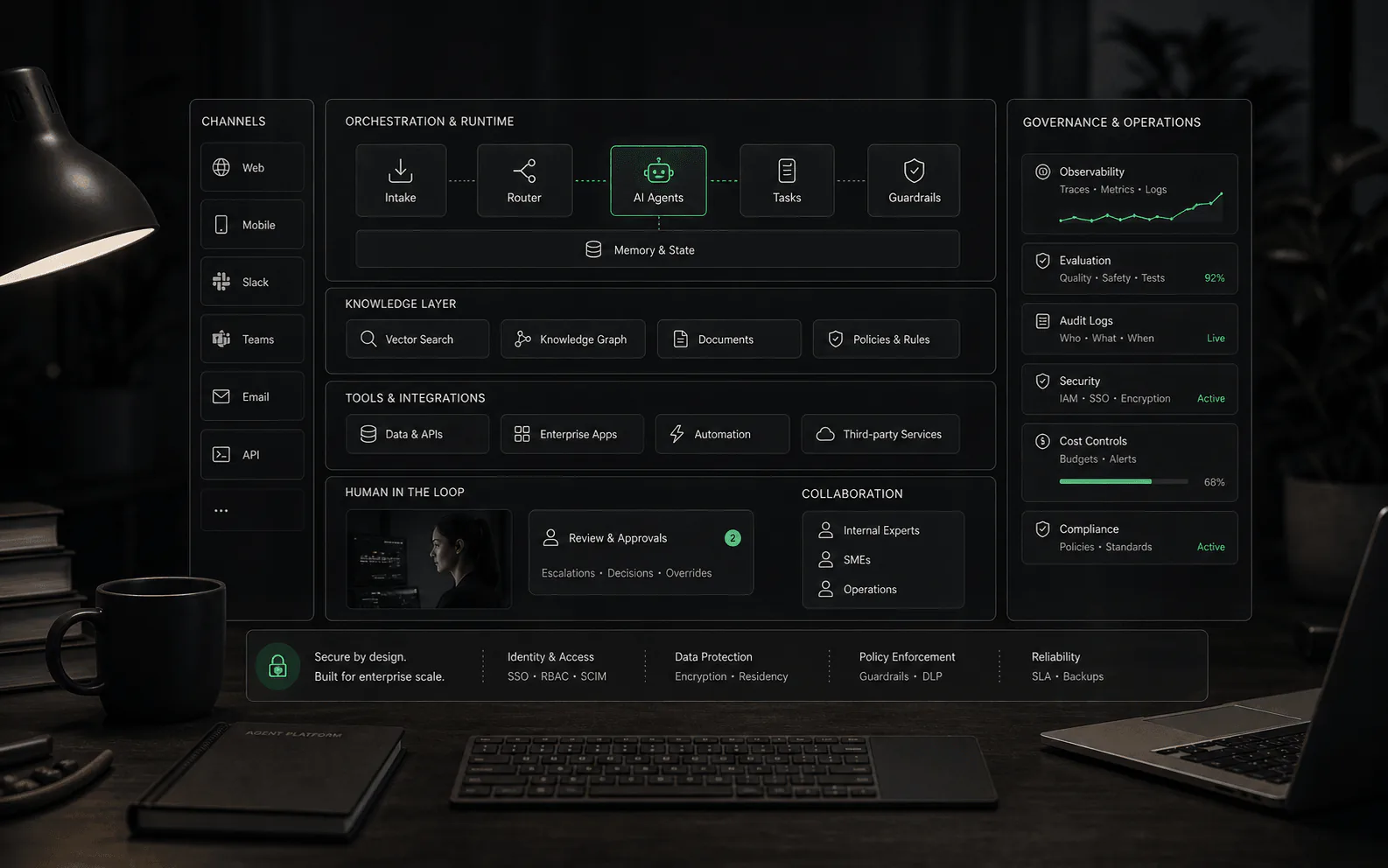

Orchestration multi-agents

Lorsqu'un flux de travail dépasse ce qu'un seul agent peut gérer de manière fiable, les plateformes peuvent utiliser plusieurs agents qui se coordonnent. Comprendre les modèles d'orchestration est essentiel pour évaluer les revendications d'automatisation complexes.

Modèles de coordination : Les agents peuvent se coordonner via un orchestrateur central qui achemine les tâches et regroupe les résultats, ou via des transferts peer-to-peer où chaque agent transmet le contexte au suivant. L'orchestration centrale offre plus de visibilité et de contrôle ; les transferts entre homologues peuvent être plus rapides mais plus difficiles à déboguer. Demandez aux fournisseurs quel modèle ils utilisent et comment les pannes sont gérées.

Qualité du transfert : Lorsqu'un agent passe la main à un autre, l'agent destinataire doit disposer de suffisamment de contexte pour continuer sans répéter les questions. Cela nécessite une mémoire partagée, un état de conversation structuré ou un passage de contexte explicite. Un transfert faible donne l’impression de recommencer ; un transfert fort est invisible pour l'utilisateur final.

État partagé : Les systèmes multi-agents ont besoin d'un moyen de partager des informations : le contexte du client, l'historique des conversations, les décisions prises, les actions entreprises et l'état actuel du flux de travail. Cet état partagé doit être interrogeable, auditable et visible par les réviseurs humains. Sans cela, chaque agent opère de manière isolée et le flux de travail global devient fragile.

Résolution des conflits : Lorsque les agents ne sont pas d’accord ou produisent des résultats contradictoires, la plateforme a besoin d’un mécanisme de résolution. Il peut s'agir d'un agent de supervision, d'un arbitre fondé sur des règles, d'une procédure d'escalade humaine ou d'une sélection pondérée en fonction de la confiance. Demandez aux fournisseurs ce qui se passe lorsque deux agents donnent des réponses ou des recommandations différentes.

Propagation des pannes : Si un agent d’une chaîne échoue, les agents en aval doivent le savoir. La gestion des échecs inclut la logique de nouvelle tentative, les chemins de secours, la dégradation progressive et la notification humaine. Un système multi-agent robuste isole les pannes et empêche l’effondrement en cascade.

Où les agents IA créent de la valeur

Les agents d’IA sont plus utiles lorsque le travail est reproductible mais pas parfaitement scripté. Dans le support client, cela peut signifier diagnostiquer un problème, trouver la bonne politique, résumer l'historique et acheminer vers la bonne file d'attente. Dans le commerce électronique, cela peut impliquer de répondre à des questions sur les commandes, de trier les problèmes de retour ou de rassembler les détails nécessaires pour qu'un humain approuve un remboursement. Dans les ventes et les opérations, cela peut signifier qualifier les demandes, préparer des ébauches, mettre à jour les enregistrements ou lancer un flux de travail une fois les contrôles requis réussis.

Exemples verticaux d’industrie

Les exigences en matière d’agents d’IA varient considérablement selon le secteur. Ce qui fonctionne pour une vitrine de commerce électronique peut échouer dans les soins de santé ou les services financiers. Les acheteurs doivent évaluer les plateformes par rapport aux contraintes de leur secteur vertical spécifique.

Soins de santé : Les agents qui traitent les demandes des patients doivent se conformer à la HIPAA et aux réglementations similaires. Les principales considérations comprennent : la résidence des données et les contrôles d'accès, la journalisation d'audit pour l'exposition aux PHI, la gestion du consentement, l'intégration avec les dossiers de santé électroniques et des voies de remontée claires pour le jugement clinique. Un agent qui planifie des rendez-vous ou envoie des rappels peut être acceptable ; un agent qui interprète les symptômes ou recommande un traitement entre en territoire réglementé. Demandez aux fournisseurs la conformité HIPAA documentée, les accords de partenariat commercial et les garde-fous spécifiques autour du contenu clinique.

Fintech et services financiers : Les agents qui traitent les demandes financières sont soumis à un contrôle réglementaire en matière de conseils, d'autorisation de transaction, de détection de fraude et de pistes d'audit. Les principales considérations comprennent : les contrôles d'accès basés sur les rôles pour les données sensibles, les limites de transactions et les flux de travail d'approbation, la journalisation de conformité pour l'examen réglementaire, l'intégration avec les principaux systèmes bancaires et de paiement, et une séparation claire entre les réponses informationnelles et les conseils financiers. Un agent qui explique une grille de frais est différent d'un agent qui recommande des produits d'investissement. Interrogez les fournisseurs sur leurs certifications de conformité, leurs capacités d'audit et la manière dont ils gèrent les limites des conseils réglementés.

SaaS B2B : Les agents dans des contextes B2B ont souvent besoin d'une intégration approfondie avec les fonctionnalités du produit, les données client et les flux de travail internes. Les principales considérations incluent : l'isolation des données multi-locataires, les réponses adaptées aux rôles basées sur le niveau et les autorisations du client, la profondeur de l'intégration avec les systèmes CRM, de facturation et de support, la capacité à gérer des flux de travail techniques complexes et les chemins de remontée d'informations qui préservent le contexte client. Les acheteurs B2B doivent tester les agents sur des scénarios clients réels, et non sur des scripts de support génériques.

Vente au détail et commerce électronique : Les agents sont confrontés à des volumes élevés, à des pics saisonniers et aux attentes des clients en matière de résolution rapide. Les principales considérations comprennent : l'intégration avec les systèmes de gestion des commandes, d'inventaire et d'expédition, la gestion des retours, des remboursements et des échanges dans les limites des politiques, la personnalisation basée sur l'historique des achats sans atteinte à la confidentialité et le transfert clair aux agents humains pour les problèmes complexes tels que les marchandises endommagées ou les réclamations pour fraude. L'agent doit traiter les questions courantes à grande échelle tout en protégeant les marges et la réputation de la marque.

Profondeur d'appel d'outil

Les agents d'IA modernes ne se contentent pas de générer du texte : ils peuvent appeler des fonctions, invoquer des API et déclencher des actions dans les systèmes connectés. Comprendre les modèles d’appel des outils est essentiel pour évaluer les capacités et la sécurité de la plateforme.

Modèles d'appel de fonction : À la base, les agents appellent des outils pour récupérer des informations : recherche du statut d'une commande, recherche dans une base de connaissances, récupération des détails d'un compte. Aux niveaux intermédiaires, les agents peuvent mettre à jour les enregistrements, créer des tickets, envoyer des notifications ou déclencher des workflows. Aux niveaux avancés, les agents peuvent enchaîner plusieurs appels d’outils, prendre des décisions basées sur des résultats intermédiaires et exécuter des transactions en plusieurs étapes. Demandez aux fournisseurs quels niveaux d'appel d'outils sont pris en charge et quelles limites s'appliquent.

Intégration API : Les agents doivent se connecter aux systèmes de l'entreprise : services d'assistance, CRM, ERP, processeurs de paiement, prestataires d'expédition, API internes. La question d’intégration n’est pas seulement de savoir si la plateforme dispose de connecteurs, mais aussi de savoir comment ces connecteurs sont configurés, authentifiés, surveillés et mis à jour. Les intégrations pointer-cliquer sont plus faciles à déployer mais peuvent manquer de flexibilité ; les intégrations personnalisées offrent un contrôle mais nécessitent des ressources de développement.

Limites des autorisations : Chaque appel d'outil doit fonctionner dans le cadre d'autorisations définies. L'agent ne doit pas avoir un accès global à toutes les données client ou à toutes les fonctions du système. Les autorisations doivent être définies par rôle, par client, par type de données et par action. Demandez aux fournisseurs comment les autorisations sont configurées, comment elles sont appliquées au moment de l'exécution et ce qui empêche un agent d'appeler un point de terminaison non autorisé, même si l'agent le justifie.

Gestion des erreurs : Les appels d’outils échouent. Les API renvoient des erreurs, les limites de débit sont atteintes, les systèmes tombent en panne, les données sont manquantes. Un agent robuste gère ces échecs avec élégance : réessais avec interruption, recours à des outils alternatifs, transmission aux humains ou information claire de l'utilisateur. Demandez aux fournisseurs de démontrer des scénarios de défaillance et de montrer comment l'agent réagit.

Observabilité : Chaque appel d'outil doit être enregistré : ce qui a été appelé, avec quels paramètres, ce qui a été renvoyé et comment l'agent a utilisé ce résultat. Cette observabilité est essentielle pour le débogage, l’audit, la conformité et l’optimisation. Demandez aux fournisseurs comment les journaux d'appels d'outils sont stockés, combien de temps ils sont conservés, qui peut y accéder et comment ils sont présentés pour examen.

Ce que les acheteurs devraient évaluer

- Base de connaissances : quelles sources l'agent utilise-t-il, dans quelle mesure sont-elles récentes et peuvent-elles montrer pourquoi une réponse a été choisie ?

- Autorisations d'action : que peut lire, écrire, mettre à jour, déclencher ou soumettre sans approbation ?

- Limites du workflow : quelles tâches sont explicitement hors de portée et comment l'agent se comporte-t-il lorsque la confiance est faible ?

- Transfert humain : une personne peut-elle prendre le relais en conservant intacts l'historique des conversations, le contexte du client et les tentatives de raisonnement de l'agent ?

- Auditabilité : l'équipe peut-elle examiner les réponses, les actions, les escalades et les échecs après coup ?

- Amélioration continue : la plate-forme affiche-t-elle des intentions sans réponse, du contenu obsolète, de mauvais transferts et des modèles d'échecs répétés ?

Des questions de démonstration qui révèlent de la profondeur

- Montrez à l'agent qui traite une vraie question client qui nécessite un contexte politique, et non une réponse générique à la FAQ.

- Montrez ce qui se passe lorsque le matériel source est en conflit ou est manquant.

- Indiquez quelles actions nécessitent une approbation et quelles actions l'agent peut effectuer lui-même.

- Afficher la transcription de transfert qu'un humain reçoit après une escalade.

- Montrez comment l'équipe examine les mauvaises réponses et améliore la base de connaissances ou les règles de flux de travail.

Tests d'évaluation avant lancement

- Test de cas historique : exécutez des conversations passées réelles via l'agent et comparez la réponse, le routage et le transfert proposés avec ce qu'un opérateur humain fort aurait fait.

- Test de contexte manquant : supprimez la source requise ou rendez la demande du client ambiguë, puis vérifiez que l'agent demande des éclaircissements ou escalade au lieu d'inventer une réponse confiante.

- Test d'autorisation : demandez à l'agent d'effectuer une action qu'il ne devrait pas être autorisé à effectuer, comme émettre un remboursement, modifier les détails du compte ou révéler des informations restreintes.

- Test de défaillance du système : déconnectez ou dégradez un outil dont dépend l'agent et vérifiez que l'expérience utilisateur, les journaux et le chemin d'escalade restent clairs.

- Test de régression : après avoir modifié les invites, les règles de flux de travail ou les sources de connaissances, réexécutez un ensemble d'évaluation fixe pour vous assurer que l'ancien comportement ne s'est pas interrompu discrètement.

Considérations sur le modèle

Le modèle d’IA sous-jacent façonne le comportement, le coût, la latence et les capacités des agents. Les acheteurs doivent comprendre l’impact du choix du modèle sur leur déploiement et les compromis qu’implique chaque option.

Sélection du modèle : Certaines plateformes proposent un modèle unique ; d'autres vous laissent choisir. Les modèles plus grands (GPT-4, Claude 3 Opus) offrent un meilleur raisonnement, un meilleur suivi des instructions et des nuances, mais coûtent plus cher et répondent plus lentement. Les modèles plus petits (GPT-4o-mini, Claude Haiku) sont plus rapides et moins chers mais peuvent avoir des difficultés avec un raisonnement complexe ou des cas extrêmes. Les modèles spécialisés peuvent être affinés pour des domaines ou des tâches spécifiques. Demandez aux fournisseurs quels modèles sont disponibles, comment fonctionne la sélection et si vous pouvez mélanger des modèles pour différents cas d'utilisation.

Différences de comportement : Les modèles varient dans la façon dont ils suivent les instructions, gèrent les ambiguïtés, refusent les demandes dangereuses et structurent les sorties. La même invite sur différents modèles peut produire des résultats différents. Lors de l'évaluation des plates-formes, testez avec les modèles que vous prévoyez d'utiliser en production. Une démo qui fonctionne sur un modèle peut se comporter différemment sur un autre.

Structure des coûts : Les agents IA consomment des jetons pour chaque entrée, sortie et appel d'outil. Les conversations à plusieurs tours, la récupération RAG et l'appel d'outils peuvent rapidement multiplier les coûts. Demandez aux fournisseurs des tarifs clairs sur : les jetons d'entrée, les jetons de sortie, les appels d'outils, les opérations de récupération et tous les frais fixes de plate-forme. Comprenez comment les coûts évoluent en fonction de l'utilisation et quels contrôles existent pour limiter les dépenses incontrôlées.

Latence : Le temps de réponse du modèle a un impact direct sur l'expérience utilisateur. Un raisonnement complexe, de grandes fenêtres contextuelles et plusieurs appels d'outils ajoutent tous de la latence. Demandez aux fournisseurs quels sont les temps de réponse typiques sous une charge réaliste, comment la plate-forme gère les délais d'attente et si la mise en cache ou le streaming améliorent les performances perçues.

Mises à jour du modèle : Les modèles d'IA sont mis à jour régulièrement. Les nouvelles versions peuvent se comporter différemment des anciennes. Demandez aux fournisseurs comment ils gèrent la gestion des versions du modèle, si vous pouvez épingler des versions de modèle spécifiques et comment ils communiquent les modifications importantes. Un changement soudain de modèle peut perturber le comportement des agents en production.

Mise au point et modèles personnalisés : Certaines plateformes proposent un réglage fin ou une formation de modèles personnalisés sur vos données. Cela peut améliorer les performances de domaines ou de flux de travail spécifiques, mais ajoute de la complexité, des coûts et de la maintenance. Les modèles affinés nécessitent des mises à jour continues à mesure que votre base de connaissances évolue. Demandez aux fournisseurs quelles options de réglage précis existent, quelles données sont requises et comment les mises à jour sont gérées.

Des indicateurs qui comptent

Les mesures utiles des agents IA mesurent le travail effectué, et pas seulement le volume des conversations. Suivez le taux d'achèvement des tâches, le taux de remontée correcte, l'exactitude des réponses sur les échantillons examinés, le taux de remplacement humain, le taux d'échec des appels d'outils, le temps de résolution, le coût par flux de travail terminé, les sujets d'échecs répétés et la satisfaction des clients après les interactions assistées par un agent. Soyez prudent avec la déviation en tant que métrique autonome ; une conversation humaine évitée n’est pas une victoire si la réponse était fausse, incomplète ou frustrante.

Concrete examples and non-examples

- Exemple : un agent d'assistance identifie une question de facturation, récupère la politique actuelle, vérifie le niveau du compte, rédige une réponse et la transmet pour approbation car le client conteste des frais.

- Exemple : un agent de commerce électronique rassemble le numéro de commande, le statut d'expédition, le motif du retour et l'état du produit avant d'acheminer le dossier vers la bonne équipe avec le contexte requis déjà joint.

- Non-exemple : une fenêtre contextuelle qui répond à trois questions scriptées à partir d'une FAQ statique mais ne peut pas utiliser le contexte client, les outils, les règles d'escalade ou l'examen post-conversation.

- Non-exemple : une règle d'automatisation de flux de travail qui achemine les tickets en fonction uniquement de mots-clés. Cela peut être une automatisation utile, mais ce n'est pas un agent d'IA à moins qu'il n'interprète le contexte et n'agisse dans le cadre de limites de raisonnement et d'autorisation définies.

Drapeaux rouges courants

Soyez prudent lorsqu'une démonstration d'agent dépend d'échantillons de données raffinés, évite les cas extrêmes ou ne peut pas expliquer l'utilisation de la source et les autorisations d'action. D'autres signes avant-coureurs incluent de vagues affirmations sur l'autonomie, l'absence de chemin de remontée clair, l'absence de piste d'audit et une tarification qui change sensiblement une fois le volume de conversation réel, les sièges, les canaux ou les actions de flux de travail inclus.

Notions associées

Les agents d'IA se situent entre plusieurs idées adjacentes : chatbots, copilotes, automatisation des flux de travail, RAG, appel d'outils et évaluation humaine dans la boucle. L'approche d'évaluation la plus sûre consiste à définir d'abord le poste, puis à décider quelle combinaison de conversation, de récupération, d'outils, d'approbations, d'analyses et d'escalade humaine est requise. Cela maintient le processus d'achat ancré dans la réalité opérationnelle plutôt que dans la terminologie du fournisseur.

Préparation au lancement

Un agent d'IA de production doit être lancé avec un ensemble de tests, un plan de restauration, des propriétaires nommés, des seuils de révision et un chemin de secours connu. Les acheteurs doivent se demander qui regarde la première semaine de conversations, comment les défauts sont triés, à quelle vitesse les mauvaises réponses peuvent être corrigées et quelles mesures déterminent si l'agent se développe ou s'arrête. Sans ce plan opérationnel, même une démo prometteuse peut devenir fragile face au trafic client réel.

Quel contenu fort doit être clair

Une page d'agent d'IA sérieuse devrait laisser au lecteur un modèle opérationnel utilisable : définir le travail, définir les données, définir les outils, définir les autorisations, définir la limite humaine, définir les tests et définir la boucle de révision. Si un fournisseur ne peut pas expliquer ces niveaux, l'acheteur n'évalue pas un système d'agent ; ils évaluent une démo.

Sources à vérifier

Utilisez ces références pour comprendre le terme et tester la pression des revendications des fournisseurs. Les détails spécifiques au produit doivent encore être vérifiés par rapport aux documents actuels du fournisseur.

FAQ

Questions courantes

Un agent IA est-il la même chose qu’un chatbot ?

Pas toujours. Un chatbot reste généralement dans une conversation. Un agent IA peut également consulter ses connaissances métier, utiliser des outils connectés, prendre des mesures approuvées et faire évoluer le contexte.

Qu’est-ce qui rend l’utilisation d’un agent IA plus sûre dans les flux de travail d’entreprise ?

Autorisations définies, sources de connaissances fiables, transfert humain, journaux d'actions, tests et limites claires sur ce que l'agent peut faire sans approbation.

Un agent IA peut-il remplacer une équipe d’assistance ?

Il ne faut pas l'évaluer de cette façon. Une meilleure question est de savoir quel travail reproductible l'agent peut effectuer, où les humains doivent garder le contrôle et si le système améliore la qualité des réponses sans créer de risque caché.

Quelle est la différence entre un agent IA et un assistant IA ?

Un assistant IA aide généralement une personne à terminer son travail en répondant, en rédigeant, en résumant ou en suggérant les prochaines étapes. Un agent IA peut aller plus loin en suivant un flux de travail, en utilisant des outils, en préservant le contexte et en exécutant les actions autorisées dans des limites définies. La différence n'est pas toujours nette, les acheteurs devraient donc se demander ce que le système peut lire, écrire, déclencher, approuver et transmettre plutôt que de se fier à l'étiquette.

Quel est un exemple d'agent IA dans le support client ?

Un agent d'assistance pratique peut identifier le problème d'un client, récupérer la politique pertinente, vérifier le contexte de la commande ou du compte, rédiger une réponse, marquer la conversation et faire remonter le cas lorsque le cas nécessite un jugement humain. L’important n’est pas que l’agent rédige un message ; c'est qu'il fait avancer un flux de travail de support limité tout en préservant suffisamment de contexte pour l'examen.

Quels sont les différents types d’agents IA ?

Les principaux types sont les agents conversationnels (axés sur le dialogue pour l'assistance, le tri et l'orientation), les agents de workflow (axés sur l'exécution des tâches pour des opérations telles que le traitement des commandes et les modifications de compte) et les systèmes multi-agents (plusieurs agents coordonnés pour des flux de travail complexes). De nombreuses plateformes combinent ces types. Ce qui compte, c'est d'adapter l'architecture de l'agent aux exigences du poste.

Comment plusieurs agents IA travaillent-ils ensemble ?

Les systèmes multi-agents se coordonnent via une orchestration centrale ou des transferts peer-to-peer. Ils partagent le contexte via un état commun, transmettent des informations structurées entre les agents et ont besoin d'une résolution de conflit lorsque les résultats sont en désaccord. Les principales questions d'évaluation comprennent : comment les transferts préservent le contexte, comment les échecs se propagent, qui surveille l'ensemble du système et comment les conflits sont résolus.

Que dois-je demander à propos des appels d’outils et des intégrations ?

Demandez quels niveaux d'appel de fonction sont pris en charge (lecture seule, écriture, transactionnel), comment les intégrations d'API sont configurées et authentifiées, quelles limites d'autorisation existent pour chaque outil, comment les erreurs et les limites de débit sont gérées et comment chaque appel d'outil est enregistré et audité. Les appels d’outils sans autorisations ni surveillance appropriées créent des risques opérationnels et de sécurité.

Comment les exigences de l’industrie affectent-elles le choix des agents IA ?

Les soins de santé exigent la conformité HIPAA, des contrôles PHI et des limites cliniques claires. La Fintech nécessite des pistes d’audit, une conformité réglementaire et des limites en matière de conseils. Le SaaS B2B nécessite une isolation multi-locataires, des intégrations approfondies et des réponses adaptées aux rôles. La vente au détail nécessite une gestion de gros volumes, une intégration avec les systèmes de commande et une cohérence de marque. Évaluez les plates-formes en fonction de vos contraintes verticales spécifiques, et non de références génériques.

Quel est l’impact du choix du modèle sur les performances des agents IA ?

Les modèles plus grands offrent un meilleur raisonnement mais coûtent plus cher et répondent plus lentement. Les modèles plus petits sont plus rapides et moins chers, mais peuvent être confrontés à des problèmes de complexité. Le comportement du modèle varie : la même invite produit des résultats différents selon les modèles. Le coût s'accumule grâce aux jetons d'entrée, aux jetons de sortie et aux appels d'outils. La latence affecte l'expérience utilisateur. Renseignez-vous auprès des fournisseurs sur les options de modèle, la transparence des prix, la latence sous charge et la manière dont les mises à jour des modèles sont gérées.

Dans quelle mesure un agent IA doit-il être autonome ?

L'autonomie doit correspondre au risque du flux de travail. Les tâches à faible risque, telles que résumer une conversation ou suggérer un article d'aide, peuvent nécessiter des contrôles plus légers. Les actions ayant un impact sur les clients, telles que les remboursements, les modifications de compte, les décisions de facturation ou les réponses publiques, doivent avoir des autorisations, des contrôles d'approbation, des journaux d'audit et des règles de secours plus stricts.

Que devraient demander les acheteurs lors d’une démo d’agent IA ?

Demandez au fournisseur d'exécuter des exemples historiques réels, et pas seulement des exemples d'invites raffinés. La démo doit montrer la récupération des sources, les autorisations de l'outil, ce qui se passe lorsque le contexte est manquant, comment l'agent s'intensifie, ce que les humains voient lors du transfert, comment les actions sont enregistrées et comment les mauvaises réponses sont corrigées après le lancement.

Quels sont les plus grands risques des agents IA ?

Les risques les plus importants sont généralement opérationnels : connaissances obsolètes, autorisations d'outils trop étendues, faible escalade, coûts cachés dus à de longs flux de travail en plusieurs étapes, tests médiocres, propriété peu claire et mesures qui récompensent la déviation au lieu de résultats corrects. Les acheteurs doivent évaluer le modèle opérationnel autour de l’agent avec autant d’attention que le résultat du modèle.

Comment mesurer si un agent IA fonctionne ?

Les mesures utiles incluent le taux d'achèvement des tâches, le taux de remontée correcte, l'exactitude des réponses examinées, le taux d'échec des appels d'outils, le taux de remplacement humain, le temps de résolution, les sujets d'échec répétés et la satisfaction des clients après des conversations assistées par un agent. Le volume des conversations à lui seul ne suffit pas, car un agent à volume élevé peut toujours créer de mauvais résultats.