Qué significa el término en la práctica

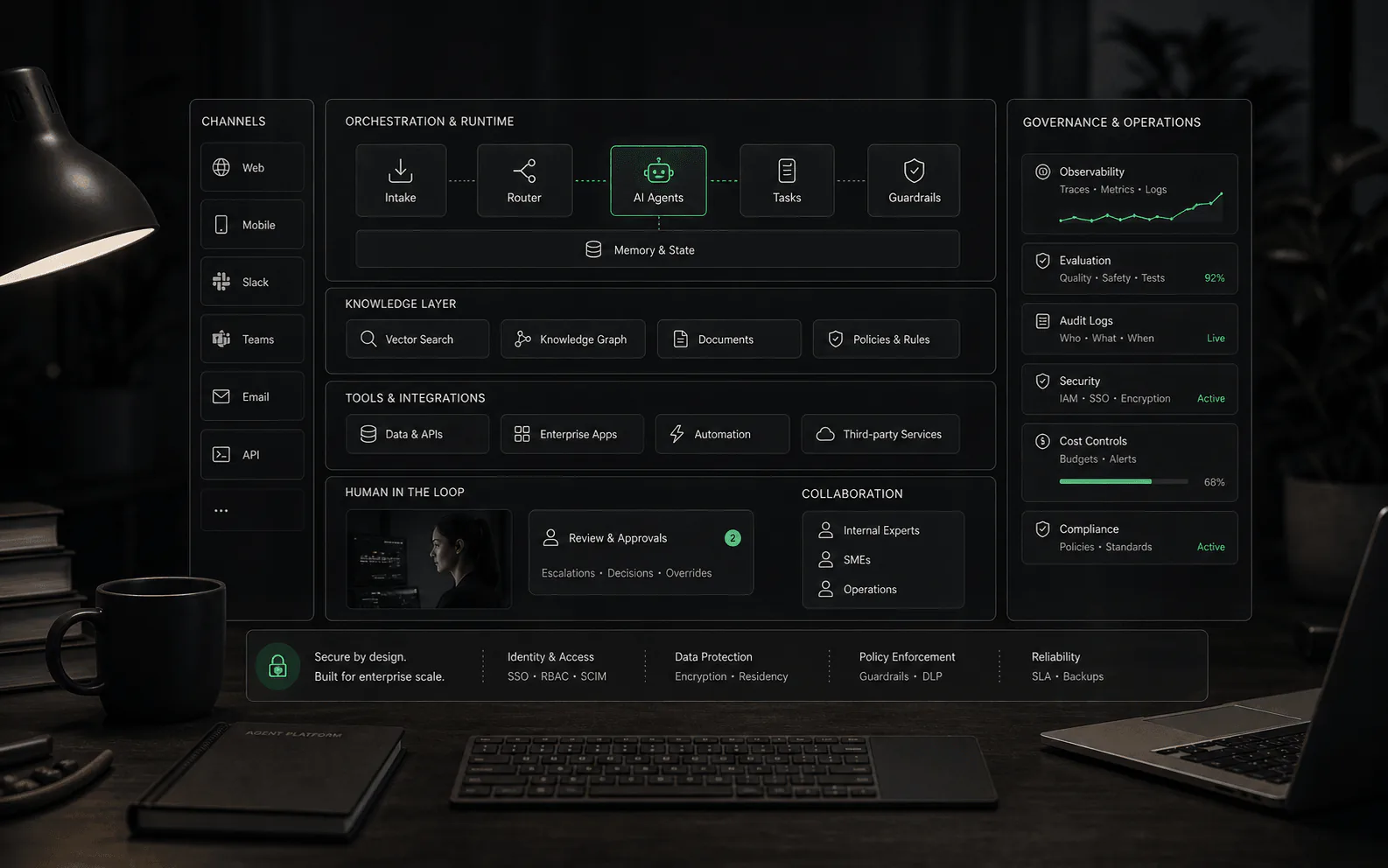

Para los compradores de empresas, un agente de IA no es sólo una ventana de chat con una etiqueta más nueva. Es un sistema que puede comprender la intención, recuperar el contexto empresarial relevante, decidir el siguiente paso permitido y responder, enrutar, redactar, actualizar, activar o escalar. La definición útil depende de los límites del flujo de trabajo: qué puede hacer el agente por sí mismo, qué requiere aprobación y qué debe pasar a un humano.

En qué se diferencia de un chatbot

- Un chatbot básico suele seguir un patrón de conversación: responder una pregunta, recopilar una pista o indicarle a alguien una página.

- Un agente de IA puede utilizar conocimiento empresarial, contexto del cliente, permisos y herramientas conectadas para avanzar en una tarea.

- La distinción no es la palabra agente. La distinción es si el sistema puede razonar sobre el contexto, tomar acciones limitadas, preservar el estado y escalar con un contexto de transferencia útil.

- Un producto puede llamarse a sí mismo agente y aun así comportarse como un simple chatbot si no puede utilizar conocimientos confiables, activar flujos de trabajo aprobados o exponer controles de revisión.

Cómo funciona un agente de IA

- Interpretar: el sistema convierte una solicitud en una intención, tarea u objetivo. En un flujo de trabajo empresarial, eso podría significar identificar si un cliente necesita solución de problemas, ayuda para realizar pedidos, revisión de facturación o escalamiento.

- Terreno: el agente recupera o recibe contexto de fuentes aprobadas, como contenido de ayuda, políticas, datos de cuentas, registros de pedidos, tickets anteriores o notas de procesos internos.

- Plan: el agente decide el siguiente paso permitido. Un caso sencillo puede necesitar una respuesta; un caso complejo puede requerir recopilar detalles, verificar un registro, redactar una respuesta y enviarlo a un humano.

- Actuar: el agente puede responder, clasificar, resumir, etiquetar, enrutar, redactar, actualizar un registro, llamar a una herramienta o solicitar aprobación dependiendo de sus permisos.

- Observe: el sistema registra lo que sucedió, observa fallas o poca confianza y brinda a los humanos suficiente información para auditar, mejorar o hacerse cargo del flujo de trabajo.

Taxonomía de tipos de agentes

No todos los agentes de IA están diseñados de la misma manera. Comprender la taxonomía ayuda a los compradores a relacionar el tipo correcto con el trabajo adecuado.

- Agentes conversacionales centrarse en el diálogo: responder preguntas, aclarar solicitudes y guiar a los usuarios a través de un árbol de decisiones. Se destacan en soporte de primera línea, calificación y clasificación. La pregunta clave de la evaluación es si el agente mantiene el contexto en todos los turnos, maneja la ambigüedad con gracia y escala cuando la conversación excede su límite de conocimiento.

- Agentes de flujo de trabajo centrarse en la ejecución de la tarea: seguir un proceso definido, verificar las condiciones, actualizar los sistemas y completar el trabajo de varios pasos. Se destacan en operaciones como procesamiento de pedidos, autorización de devolución, cambios de cuenta y sincronización de datos. La pregunta clave de la evaluación es si el agente sigue el flujo de trabajo de manera confiable, maneja los casos extremos, registra cada paso y falla correctamente cuando algo sale mal.

- Sistemas multiagente combinar múltiples agentes que pueden especializarse por función, acceso a datos o habilidad. Un agente podría encargarse de la identificación del cliente, otro de la recuperación de políticas, otro de la ejecución de acciones y otra revisión de calidad. La pregunta clave de la evaluación es cómo se coordinan los agentes, si las transferencias preservan el contexto, cómo se propagan las fallas y quién monitorea el sistema en general.

Muchas plataformas desdibujan estos límites. Un agente conversacional puede desencadenar flujos de trabajo. Un agente de flujo de trabajo puede incluir pasos conversacionales. Lo que importa es comprender el trabajo principal y luego evaluar si la arquitectura de la plataforma respalda ese trabajo con los controles adecuados.

La autonomía es un espectro.

La cuestión de compra más importante no es si el agente es autónomo. Es donde comienza y termina la autonomía. Un agente de solo lectura que responde a partir de documentación pública conlleva un riesgo diferente al de un agente que cambia el estado de la cuenta, emite reembolsos, actualiza un CRM o envía mensajes en nombre de un humano. Los compradores deben pedir a los proveedores que mapeen la autonomía por paso del flujo de trabajo: qué pasos son automáticos, cuáles requieren aprobación, cuáles desencadenan una escalada y cuáles están bloqueados por completo.

Orquestación multiagente

Cuando un flujo de trabajo excede lo que un solo agente puede manejar de manera confiable, las plataformas pueden usar múltiples agentes que se coordinen. Comprender los patrones de orquestación es esencial para evaluar reclamaciones de automatización complejas.

Modelos de coordinación: Los agentes pueden coordinarse a través de un orquestador central que enruta tareas y agrega resultados, o mediante transferencias entre pares donde cada agente pasa el contexto al siguiente. La orquestación central ofrece más visibilidad y control; las transferencias entre pares pueden ser más rápidas pero más difíciles de depurar. Pregunte a los proveedores qué modelo utilizan y cómo se manejan las fallas.

Calidad de transferencia: Cuando un agente pasa la transferencia a otro, el agente receptor debe tener suficiente contexto para continuar sin repetir preguntas. Esto requiere memoria compartida, estado de conversación estructurado o transferencia de contexto explícito. Un traspaso débil se siente como empezar de nuevo; una transferencia fuerte es invisible para el usuario final.

Estado compartido: Los sistemas multiagente necesitan una forma de compartir información: contexto del cliente, historial de conversaciones, decisiones tomadas, acciones tomadas y estado actual del flujo de trabajo. Este estado compartido debe ser consultable, auditable y visible para los revisores humanos. Sin él, cada agente opera de forma aislada y el flujo de trabajo general se vuelve frágil.

Resolución de conflictos: Cuando los agentes no están de acuerdo o producen resultados contradictorios, la plataforma necesita un mecanismo de resolución. Podría ser un agente supervisor, un árbitro basado en reglas, una ruta de escalada humana o una selección ponderada por la confianza. Pregunte a los proveedores qué sucede cuando dos agentes dan respuestas o recomendaciones diferentes.

Propagación de fallas: Si un agente de una cadena falla, los agentes posteriores deben saberlo. El manejo de fallas incluye lógica de reintento, rutas alternativas, degradación elegante y notificación humana. Un robusto sistema multiagente aísla las fallas y previene el colapso en cascada.

Donde los agentes de IA crean valor

Los agentes de IA son más útiles cuando el trabajo es repetible pero no está perfectamente escrito. En atención al cliente, eso puede significar diagnosticar un problema, encontrar la política adecuada, resumir el historial y dirigirlo a la cola correcta. En el comercio electrónico, puede significar responder preguntas sobre pedidos, clasificar problemas de devolución o recopilar los detalles necesarios para que un humano apruebe un reembolso. En ventas y operaciones, puede significar calificar solicitudes, preparar borradores, actualizar registros o iniciar un flujo de trabajo después de pasar las verificaciones requeridas.

Ejemplos verticales de la industria

Los requisitos de los agentes de IA varían significativamente según la industria. Lo que funciona para una tienda de comercio electrónico puede fallar en los servicios financieros o de atención médica. Los compradores deben evaluar las plataformas frente a las limitaciones de su vertical específico.

Atención sanitaria: Los agentes que manejan consultas de pacientes deben navegar por HIPAA y regulaciones similares. Las consideraciones clave incluyen: residencia de datos y controles de acceso, registro de auditoría para la exposición de la PHI, gestión del consentimiento, integración con registros médicos electrónicos y rutas claras de escalada para el juicio clínico. Un agente que programe citas o envíe recordatorios puede ser aceptable; un agente que interpreta síntomas o recomienda tratamiento cruza al territorio regulado. Pregunte a los proveedores sobre el cumplimiento documentado de HIPAA, los acuerdos de socios comerciales y las barreras de seguridad específicas en torno al contenido clínico.

Fintech y servicios financieros: Los agentes que manejan consultas financieras enfrentan un escrutinio regulatorio en torno al asesoramiento, la autorización de transacciones, la detección de fraude y las pistas de auditoría. Las consideraciones clave incluyen: controles de acceso basados en roles para datos confidenciales, límites de transacciones y flujos de trabajo de aprobación, registro de cumplimiento para revisión regulatoria, integración con sistemas bancarios y de pago centrales, y una separación clara entre respuestas informativas y asesoramiento financiero. Un agente que explica una lista de tarifas es diferente de un agente que recomienda productos de inversión. Pregunte a los proveedores sobre sus certificaciones de cumplimiento, capacidades de auditoría y cómo manejan los límites de asesoramiento regulados.

SaaS B2B: Los agentes en contextos B2B a menudo necesitan una integración profunda con la funcionalidad del producto, los datos de los clientes y los flujos de trabajo internos. Las consideraciones clave incluyen: aislamiento de datos multiinquilino, respuestas con reconocimiento de roles basadas en el nivel y los permisos del cliente, profundidad de integración con CRM, sistemas de facturación y soporte, capacidad para manejar flujos de trabajo técnicos complejos y rutas de escalamiento que preserven el contexto del cliente. Los compradores B2B deben probar a los agentes en escenarios de clientes reales, no en scripts de soporte genéricos.

Comercio minorista y comercio electrónico: Los agentes enfrentan un gran volumen, picos estacionales y expectativas de los clientes de una resolución rápida. Las consideraciones clave incluyen: integración con sistemas de gestión de pedidos, inventario y envío, manejo de devoluciones, reembolsos y cambios dentro de los límites de la política, personalización basada en el historial de compras sin extralimitación de la privacidad y transferencia clara a agentes humanos para problemas complejos como productos dañados o reclamos de fraude. El agente debe manejar preguntas rutinarias a gran escala y al mismo tiempo proteger los márgenes y la reputación de la marca.

Profundidad de llamada de herramienta

Los agentes de IA modernos no solo generan texto: pueden llamar funciones, invocar API y desencadenar acciones en sistemas conectados. Comprender los patrones de llamada de herramientas es esencial para evaluar la capacidad y la seguridad de la plataforma.

Patrones de llamada de funciones: En un nivel básico, los agentes recurren a herramientas para recuperar información: buscar el estado de un pedido, buscar en una base de conocimientos, obtener detalles de la cuenta. En niveles intermedios, los agentes pueden actualizar registros, crear tickets, enviar notificaciones o activar flujos de trabajo. En niveles avanzados, los agentes pueden encadenar múltiples llamadas a herramientas, tomar decisiones basadas en resultados intermedios y ejecutar transacciones de varios pasos. Pregunte a los proveedores qué niveles de llamadas de herramientas son compatibles y qué límites se aplican.

Integración API: Los agentes necesitan conectarse a los sistemas empresariales: servicios de asistencia técnica, CRM, ERP, procesadores de pagos, proveedores de envío, API internas. La cuestión de la integración no es sólo si la plataforma tiene conectores, sino cómo se configuran, autentican, monitorean y actualizan esos conectores. Las integraciones de apuntar y hacer clic son más fáciles de implementar, pero pueden carecer de flexibilidad; Las integraciones personalizadas ofrecen control pero requieren recursos de desarrollo.

Límites de permiso: Cada llamada a una herramienta debe funcionar dentro de los permisos definidos. El agente no debe tener acceso general a todos los datos del cliente ni a todas las funciones del sistema. Los permisos deben tener un alcance por función, por cliente, por tipo de datos y por acción. Pregunte a los proveedores cómo se configuran los permisos, cómo se aplican en tiempo de ejecución y qué impide que un agente llame a un punto final no autorizado, incluso si el agente considera que debería hacerlo.

Manejo de errores: Las llamadas a herramientas fallan. Las API devuelven errores, se alcanzan los límites de velocidad, los sistemas fallan y faltan datos. Un agente robusto maneja estas fallas con elegancia: reintentando con retroceso, recurriendo a herramientas alternativas, escalando a humanos o informando claramente al usuario. Pida a los proveedores que demuestren escenarios de falla y muestren cómo responde el agente.

Observabilidad: Se debe registrar cada llamada a la herramienta: cómo se llamó, con qué parámetros, qué se devolvió y cómo el agente utilizó ese resultado. Esta observabilidad es esencial para la depuración, auditoría, cumplimiento y optimización. Pregunte a los proveedores cómo se almacenan los registros de llamadas de herramientas, durante cuánto tiempo se conservan, quién puede acceder a ellos y cómo se presentan para su revisión.

Lo que los compradores deberían evaluar

- Base del conocimiento: ¿Qué fuentes utiliza el agente, qué tan recientes son y pueden mostrar por qué se eligió una respuesta?

- Permisos de acción: ¿Qué puede leer, escribir, actualizar, activar o enviar el agente sin aprobación?

- Límites del flujo de trabajo: ¿qué tareas están explícitamente fuera de alcance y cómo se comporta el agente cuando la confianza es baja?

- Traspaso humano: ¿Puede una persona tomar el control con el historial de conversaciones, el contexto del cliente y el intento de razonamiento del agente intactos?

- Auditabilidad: ¿Puede el equipo revisar las respuestas, acciones, escalamientos y fallas después del hecho?

- Mejora continua: ¿Muestra la plataforma intenciones sin respuesta, contenido obsoleto, transferencias deficientes y patrones de falla repetidos?

Preguntas de demostración que revelan profundidad

- Muestre al agente respondiendo una pregunta real de un cliente que requiere un contexto de política, no una respuesta genérica de preguntas frecuentes.

- Muestre lo que sucede cuando el material original entra en conflicto o falta.

- Muestre qué acciones requieren aprobación y qué acciones puede completar el agente por sí mismo.

- Muestre la transcripción de transferencia que recibe un humano después de la escalada.

- Muestre cómo el equipo revisa las malas respuestas y mejora la base de conocimientos o las reglas del flujo de trabajo.

Pruebas de evaluación antes del lanzamiento.

- Prueba de caso histórico: ejecute conversaciones pasadas reales a través del agente y compare la respuesta, el enrutamiento y la transferencia propuestos con lo que habría hecho un operador humano fuerte.

- Prueba de contexto faltante: elimine la fuente requerida o haga que la solicitud del cliente sea ambigua, luego verifique que el agente solicite una aclaración o escale en lugar de inventar una respuesta segura.

- Prueba de permiso: solicite al agente que realice una acción que no debería permitirle completar, como emitir un reembolso, cambiar los detalles de la cuenta o revelar información restringida.

- Prueba de falla del sistema: desconecte o degrade una herramienta de la que depende el agente y verifique que la experiencia del usuario, los registros y la ruta de escalada permanezcan claros.

- Prueba de regresión: después de cambiar las indicaciones, las reglas del flujo de trabajo o las fuentes de conocimiento, vuelva a ejecutar un conjunto de evaluación fijo para asegurarse de que el comportamiento anterior no se rompa silenciosamente.

Consideraciones del modelo

El modelo de IA subyacente da forma al comportamiento, el costo, la latencia y la capacidad de los agentes. Los compradores deben comprender cómo la elección del modelo afecta su implementación y qué compensaciones implica cada opción.

Selección de modelo: Algunas plataformas ofrecen un único modelo; otros te dejan elegir. Los modelos más grandes (GPT-4, Claude 3 Opus) ofrecen mejor razonamiento, seguimiento de instrucciones y matices, pero cuestan más y responden más lentamente. Los modelos más pequeños (GPT-4o-mini, Claude Haiku) son más rápidos y más baratos, pero pueden tener dificultades con razonamientos complejos o casos extremos. Los modelos especializados se pueden ajustar para dominios o tareas específicas. Pregunte a los proveedores qué modelos están disponibles, cómo funciona la selección y si puede combinar modelos para diferentes casos de uso.

Diferencias de comportamiento: Los modelos varían en cómo siguen instrucciones, manejan la ambigüedad, rechazan solicitudes inseguras y estructuran los resultados. El mismo mensaje en diferentes modelos puede producir resultados diferentes. Al evaluar plataformas, pruebe con los modelos que planea utilizar en producción. Una demostración que funciona en un modelo puede comportarse de manera diferente en otro.

Estructura de costos: Los agentes de IA consumen tokens por cada entrada, salida y llamada a herramientas. Las conversaciones de varios turnos, la recuperación de RAG y la llamada de herramientas pueden multiplicar los costos rápidamente. Solicite a los proveedores precios claros sobre: tokens de entrada, tokens de salida, llamadas de herramientas, operaciones de recuperación y cualquier tarifa fija de plataforma. Comprenda cómo los costos aumentan con el uso y qué controles existen para limitar el gasto descontrolado.

Latencia: El tiempo de respuesta del modelo afecta directamente la experiencia del usuario. El razonamiento complejo, las grandes ventanas de contexto y las múltiples llamadas a herramientas añaden latencia. Pregunte a los proveedores sobre los tiempos de respuesta típicos bajo una carga realista, cómo maneja la plataforma los tiempos de espera y si el almacenamiento en caché o la transmisión por secuencias mejoran el rendimiento percibido.

Actualizaciones de modelos: Los modelos de IA se actualizan periódicamente. Las nuevas versiones pueden comportarse de manera diferente a las antiguas. Pregunte a los proveedores cómo manejan el control de versiones del modelo, si puede fijar versiones de modelo específicas y cómo comunican los cambios importantes. Un cambio repentino de modelo puede alterar el comportamiento de los agentes en producción.

Modelos personalizados y de puesta a punto: Algunas plataformas ofrecen ajustes o entrenamiento de modelos personalizados en sus datos. Esto puede mejorar el rendimiento de dominios o flujos de trabajo específicos, pero agrega complejidad, costo y mantenimiento. Los modelos perfeccionados requieren actualizaciones continuas a medida que evoluciona su base de conocimientos. Pregunte a los proveedores qué opciones de ajuste existen, qué datos se requieren y cómo se administran las actualizaciones.

Métricas que importan

Las métricas útiles de los agentes de IA miden el trabajo completado, no solo el volumen de conversaciones. Realice un seguimiento de la tasa de finalización de tareas, la tasa de escalamiento correcto, la precisión de las respuestas en las muestras revisadas, la tasa de anulación humana, la tasa de fallas de llamadas de herramientas, el tiempo de resolución, el costo por flujo de trabajo completado, los temas de fallas repetidas y la satisfacción del cliente después de las interacciones asistidas por agentes. Tenga cuidado con la desviación como métrica independiente; una conversación humana evitada no es una victoria si la respuesta fue incorrecta, incompleta o frustrante.

Ejemplos concretos y no ejemplos

- Ejemplo: un agente de soporte identifica una pregunta sobre facturación, recupera la política actual, verifica el nivel de la cuenta, redacta una respuesta y la escala para su aprobación porque el cliente está disputando un cargo.

- Ejemplo: un agente de comercio electrónico recopila el número de pedido, el estado del envío, el motivo de la devolución y el estado del producto antes de dirigir el caso al equipo correcto con el contexto requerido ya adjunto.

- No ejemplo: una ventana emergente que responde a tres preguntas escritas de una pregunta frecuente estática pero que no puede utilizar el contexto del cliente, las herramientas, las reglas de escalamiento o la revisión posterior a la conversación.

- No ejemplo: una regla de automatización del flujo de trabajo que enruta tickets basándose únicamente en palabras clave. Puede ser una automatización útil, pero no es un agente de IA a menos que interprete el contexto y opere dentro de límites definidos de razonamiento y permiso.

Banderas rojas comunes

Tenga cuidado cuando la demostración de un agente dependa de datos de muestra pulidos, evite casos extremos o no pueda explicar el uso de la fuente y los permisos de acción. Otras señales de advertencia incluyen afirmaciones vagas sobre la autonomía, falta de una ruta clara de escalada, falta de seguimiento de auditoría y precios que cambian materialmente una vez que se incluyen el volumen de conversación, los asientos, los canales o las acciones de flujo de trabajo reales.

Conceptos relacionados

Los agentes de IA se ubican entre varias ideas adyacentes: chatbots, copilotos, automatización del flujo de trabajo, RAG, llamadas de herramientas y revisión humana en el circuito. El enfoque de evaluación más seguro es definir primero el trabajo y luego decidir qué combinación de conversación, recuperación, herramientas, aprobaciones, análisis y escalamiento humano se requiere. Esto mantiene el proceso de compra basado en la realidad operativa en lugar de en la terminología del proveedor.

Preparación para el lanzamiento

Un agente de IA de producción debe iniciarse con un conjunto de pruebas, un plan de reversión, propietarios designados, umbrales de revisión y una ruta de respaldo conocida. Los compradores deben preguntar quién observa la primera semana de conversaciones, cómo se clasifican los defectos, qué tan rápido se pueden corregir las malas respuestas y qué métricas deciden si el agente se expande o se detiene. Sin ese plan operativo, incluso una demostración prometedora puede volverse frágil en el tráfico real de clientes.

¿Qué contenido sólido debería dejar claro?

Una página seria de un agente de IA debería dejar al lector con un modelo operativo utilizable: definir el trabajo, definir los datos, definir las herramientas, definir los permisos, definir los límites humanos, definir las pruebas y definir el ciclo de revisión. Si un vendedor no puede explicar esos niveles, el comprador no está evaluando un sistema de agentes; Están evaluando una demostración.

Fuentes para verificar

Utilice estas referencias para comprender el término y las afirmaciones de los proveedores de pruebas de presión. Los detalles específicos del producto aún deben verificarse con los materiales actuales del proveedor.

Preguntas frecuentes

Preguntas comunes

¿Es lo mismo un agente de IA que un chatbot?

No siempre. Un chatbot suele permanecer dentro de una conversación. Un agente de IA también puede consultar conocimientos empresariales, utilizar herramientas conectadas, realizar acciones aprobadas y escalar con el contexto.

¿Qué hace que un agente de IA sea más seguro de usar en los flujos de trabajo empresariales?

Permisos definidos, fuentes de conocimiento confiables, transferencia humana, registros de acciones, pruebas y límites claros sobre lo que el agente puede hacer sin aprobación.

¿Puede un agente de IA reemplazar a un equipo de soporte?

No se debe evaluar de esa manera. Una mejor pregunta es qué trabajo repetible puede realizar el agente, dónde los humanos deben mantener el control y si el sistema mejora la calidad de la respuesta sin crear riesgos ocultos.

¿Cuál es la diferencia entre un agente de IA y un asistente de IA?

Un asistente de IA generalmente ayuda a una persona a completar el trabajo respondiendo, redactando, resumiendo o sugiriendo los siguientes pasos. Un agente de IA puede ir más allá si sigue un flujo de trabajo, utiliza herramientas, preserva el contexto y realiza acciones permitidas dentro de límites definidos. La diferencia no siempre es clara, por lo que los compradores deberían preguntarse qué puede leer, escribir, activar, aprobar y escalar el sistema en lugar de depender de la etiqueta.

¿Cuál es un ejemplo de un agente de IA en atención al cliente?

Un agente de soporte práctico podría identificar el problema de un cliente, recuperar la política relevante, verificar el contexto del pedido o de la cuenta, redactar una respuesta, etiquetar la conversación y escalar cuando el caso requiera un juicio humano. Lo importante no es que el agente escriba un mensaje; es que hace avanzar un flujo de trabajo de soporte limitado y al mismo tiempo preserva suficiente contexto para su revisión.

¿Cuáles son los diferentes tipos de agentes de IA?

Los tipos principales son agentes conversacionales (centrados en el diálogo para soporte, clasificación y orientación), agentes de flujo de trabajo (centrados en la ejecución de tareas para operaciones como procesamiento de pedidos y cambios de cuentas) y sistemas multiagente (múltiples agentes coordinados para flujos de trabajo complejos). Muchas plataformas combinan estos tipos. Lo que importa es hacer coincidir la arquitectura del agente con los requisitos del trabajo.

¿Cómo trabajan juntos varios agentes de IA?

Los sistemas multiagente se coordinan a través de una orquestación central o transferencias de igual a igual. Comparten contexto a través de un estado común, pasan información estructurada entre agentes y necesitan resolución de conflictos cuando los resultados no coinciden. Las preguntas clave de la evaluación incluyen: cómo las transferencias preservan el contexto, cómo se propagan las fallas, quién monitorea el sistema en general y cómo se resuelven los conflictos.

¿Qué debo preguntar sobre las integraciones y llamadas de herramientas?

Pregunte qué niveles de llamada de función se admiten (solo lectura, escritura, transaccional), cómo se configuran y autentican las integraciones de API, qué límites de permisos existen para cada herramienta, cómo se manejan los errores y los límites de velocidad, y cómo se registra y audita cada llamada de herramienta. La llamada a herramientas sin los permisos y el monitoreo adecuados crea riesgos operativos y de seguridad.

¿Cómo afectan los requisitos de la industria a la elección de los agentes de IA?

La atención médica requiere cumplimiento de HIPAA, controles de PHI y límites clínicos claros. Fintech requiere pistas de auditoría, cumplimiento normativo y límites de asesoramiento. B2B SaaS requiere aislamiento de múltiples inquilinos, integraciones profundas y respuestas con reconocimiento de roles. El comercio minorista requiere manipulación de grandes volúmenes, integración con sistemas de pedidos y coherencia de marca. Evalúe las plataformas según sus limitaciones verticales específicas, no con puntos de referencia genéricos.

¿Cómo afecta la elección del modelo al rendimiento de los agentes de IA?

Los modelos más grandes ofrecen un mejor razonamiento pero cuestan más y responden más lentamente. Los modelos más pequeños son más rápidos y más baratos, pero pueden tener dificultades con la complejidad. El comportamiento del modelo varía: el mismo mensaje produce resultados diferentes en todos los modelos. El costo se acumula a través de tokens de entrada, tokens de salida y llamadas a herramientas. La latencia afecta la experiencia del usuario. Pregunte a los proveedores sobre las opciones de modelos, la transparencia de precios, la latencia bajo carga y cómo se manejan las actualizaciones de modelos.

¿Qué tan autónomo debe ser un agente de IA?

La autonomía debe coincidir con el riesgo del flujo de trabajo. Las tareas de bajo riesgo, como resumir una conversación o sugerir un artículo de ayuda, pueden necesitar controles más ligeros. Las acciones que afectan al cliente, como reembolsos, cambios de cuenta, decisiones de facturación o respuestas públicas, deben tener permisos, puertas de aprobación, registros de auditoría y reglas alternativas más estrictas.

¿Qué deberían preguntar los compradores en una demostración de un agente de IA?

Pídale al proveedor que ejecute ejemplos históricos reales, no sólo indicaciones de muestra pulidas. La demostración debe mostrar la recuperación de fuentes, permisos de herramientas, qué sucede cuando falta contexto, cómo escala el agente, qué ven los humanos durante la transferencia, cómo se registran las acciones y cómo se corrigen las respuestas incorrectas después del lanzamiento.

¿Cuáles son los mayores riesgos de los agentes de IA?

Los mayores riesgos suelen ser operativos: conocimiento obsoleto, permisos de herramientas demasiado amplios, escalamiento débil, costos ocultos de largos flujos de trabajo de varios pasos, pruebas deficientes, propiedad poco clara y métricas que recompensan la desviación en lugar de los resultados correctos. Los compradores deben evaluar el modelo operativo del agente con tanto cuidado como el resultado del modelo.

¿Cómo se mide si un agente de IA está funcionando?

Las medidas útiles incluyen la tasa de finalización de tareas, la tasa de escalamiento correcto, la precisión de las respuestas revisadas, la tasa de fallas en las llamadas de herramientas, la tasa de anulación humana, el tiempo de resolución, los temas de fallas repetidas y la satisfacción del cliente después de las conversaciones asistidas por agentes. El volumen de conversación por sí solo no es suficiente porque un agente de alto volumen aún puede generar malos resultados.