Introduction : Pourquoi les frameworks sont importants en 2026

En 2023, créer un agent IA impliquait d’encapsuler GPT-4 dans une boucle while avec un appel d’outil. D’ici 2026, cette approche s’effondrera dans la production. Les vrais agents ont besoin de gestion d'état, de récupération d'erreurs, de flux de travail intégrés, de coordination multi-agents, d'observabilité et d'infrastructure de déploiement. Les frameworks gèrent désormais la complexité qui a tué la plupart des expériences d’agents en 2023-2024.

La conversation est passée de « devrions-nous utiliser des agents IA ? » à « quel framework survit à la charge de production ? » Ce guide couvre les frameworks qui ont traversé la vallée de la mort, ceux avec des communautés actives, des déploiements de production et des limitations honnêtes.

À qui s’adresse ce guide :

- Développeurs évaluer dans quel cadre de code s'engager pour un projet de 6 à 12 mois

- CTO et responsables de l'ingénierie prendre des décisions stratégiques en matière de plate-forme pour leurs équipes

- Équipes de plateforme choisir entre des frameworks auto-hébergés et des solutions d'entreprise gérées

- N'importe qui qui a regardé une démo fonctionner parfaitement puis a échoué silencieusement en production

Catégories du cadre : Comprendre le paysage

Les outils d'agent d'IA se répartissent en quatre catégories distinctes. Choisir la mauvaise catégorie est plus pénible que choisir le mauvais outil dans une catégorie.

Constructeurs sans code/low code

Des plateformes comme YourGPT, Flux vocal, et Botpress proposer des interfaces visuelles pour la conception des flux de travail des agents. Vous définissez des chemins de conversation, connectez des sources de connaissances et déployez sans écrire de code.

Quand utiliser : Cas d'utilisation standards (support client, qualification des leads, automatisation des FAQ), équipes sans ingénieurs IA dédiés, prototypage rapide avant de s'engager dans un développement personnalisé.

Limites : La logique personnalisée nécessite des solutions de contournement ou des extensions d'API. Le débogage est plus difficile lorsque vous ne pouvez pas inspecter le code. La dépendance vis-à-vis des fournisseurs est réelle : la migration nécessite une reconstruction.

Cadres axés sur le code

LangGraph, ÉquipageAI, Cadre d'agents Microsoft, et SDK des agents OpenAI vous donne un contrôle au niveau du code. Vous définissez des agents, des outils, des machines à états et une orchestration en Python ou TypeScript.

Quand utiliser : Des workflows complexes nécessitant une logique personnalisée, des intégrations uniques non couvertes par les plateformes no-code, des applications où l'observabilité et le débogage sont critiques, des équipes dotées d'une forte capacité d'ingénierie.

Avantages : Contrôle total, contrôle de version, testabilité, portabilité entre fournisseurs de cloud, capacité à déboguer les problèmes de production.

Plateformes d'entreprise

Microsoft Copilot Studio et Générateur d'agents Google Vertex AI offrent une infrastructure gérée avec une conformité d'entreprise, des contrôles de sécurité et une intégration avec les systèmes d'entreprise existants.

Quand utiliser : Organisations ayant des engagements Microsoft 365 ou Google Cloud, secteurs réglementés exigeant des certifications de conformité, déploiements à grande échelle où l'infrastructure gérée réduit la charge opérationnelle.

Agents spécialisés

Agents de codage (GitHub Copilot, Cursor), agents vocaux (plateformes vocales dédiées) et agents spécifiques à un domaine optimisés pour des cas d'utilisation particuliers.

Quand utiliser : Lorsque votre cas d'utilisation correspond exactement à la spécialisation. Les frameworks génériques ajoutent de la complexité à ces cas d’utilisation restreints.

Approfondissement : cadres axés sur le code

Cette section couvre les frameworks évalués par les développeurs pour les systèmes d'agents de production. Chaque évaluation comprend l'architecture, les points forts, les considérations de production, les données GitHub, les cas d'utilisation réels, les prix, la taille de la communauté et les limitations connues.

LangGraph : agents avec état de qualité production

Architecture : LangGraph modélise les agents comme des machines à états construites sur des graphes orientés. Chaque nœud représente une étape de calcul ; les bords définissent des transitions en fonction des conditions. L'état est explicitement défini et transmis entre les nœuds, ce qui rend le comportement de l'agent déterministe et déboguable.

Le cadre a émergé de LangChain en 2024 lorsque l'équipe a reconnu que les chaînes (compositions linéaires) ne pouvaient pas gérer la complexité des agents de production. LangGraph 2.0, publié en février 2026, codifie trois années de modèles de production dans un cadre mature.

Notions clés :

- Graphique d'état : L'abstraction fondamentale. Définissez le schéma d'état, ajoutez des nœuds (fonctions), ajoutez des bords (transitions), compilez dans un exécutable.

- Points de contrôle : État persistant à tout moment. Reprenez l'exécution à partir de n'importe quel point de contrôle, ce qui est essentiel pour les agents à exécution longue.

- Mémoire : Prise en charge intégrée de la mémoire de conversation, de la persistance au niveau des threads et de l'état intersessions.

- Humain dans la boucle : Suspendez l'exécution pour un examen humain, injectez des commentaires, continuez après une interruption.

Points forts de la production :

- Observabilité : Chaque transition d'état est traçable. L'intégration de LangSmith permet la surveillance, le débogage et l'évaluation de la production.

- Testabilité : Les graphiques peuvent être testés unitairement nœud par nœud. L’État est explicite et rend les affirmations simples.

- Récupération d'erreur : Les points de contrôle signifient que vous ne perdez jamais votre travail. Reprendre à partir du dernier état réussi après des échecs.

- Échelle : Utilisé par Uber, LinkedIn, Klarna pour les charges de travail de production. 34,5 millions de téléchargements mensuels suggèrent une véritable adoption en production.

Données GitHub (mai 2026) :

- Étoiles : ~24 800

- Téléchargements mensuels : 34,5 millions

- Problèmes ouverts : 264

- Problèmes clôturés : 1 015

- Pull request : 246 ouvertes, 3 619 fusionnées

- Sorties : 504 (dernière : langgraph-cli==0.4.24)

- Contributeurs : 200+

Cas d'utilisation réels :

- Uber : Automatisation de la prise en charge des passagers en plusieurs étapes avec transfert aux agents humains

- LinkedIn : Workflows de modération de contenu nécessitant une gestion d’état complexe

- Klarna : Chatbot de services financiers avec points de contrôle de conformité

Tarif : Open source (licence MIT). LangSmith (plateforme d'observabilité) propose un niveau gratuit pour le développement et des niveaux payants pour la production.

Limites connues :

- Courbe d'apprentissage : Nécessite une compréhension des machines à états basées sur des graphiques. Les développeurs habitués à la pensée linéaire ont besoin de 2 à 4 semaines pour devenir productifs.

- Verbosité : Les agents simples nécessitent plus de passe-partout que CrewAI. Le compromis est un contrôle explicite.

- Dépendance LangChain : Bien que LangGraph puisse fonctionner de manière indépendante, la plupart de la documentation suppose l'écosystème LangChain. Pure LangGraph nécessite plus de configuration.

Meilleur ajustement : Flux de travail complexes en plusieurs étapes, applications nécessitant une présence humaine, équipes donnant la priorité à l'observabilité de la production, projets où le comportement des agents doit être auditable.

# LangGraph minimal example - stateful agent

from langgraph.graph import StateGraph, END

from typing import TypedDict

class AgentState(TypedDict):

messages: list

context: dict

next_action: str

def process_query(state: AgentState) -> AgentState:

# Your processing logic

return {"next_action": "respond"}

def respond(state: AgentState) -> AgentState:

# Generate response

return {"next_action": END}

workflow = StateGraph(AgentState)

workflow.add_node("process", process_query)

workflow.add_node("respond", respond)

workflow.add_edge("process", "respond")

workflow.set_entry_point("process")

app = workflow.compile()

AutoGen et Microsoft Agent Framework

Important : AutoGen est entré en mode maintenance en 2026. Microsoft recommande Cadre d'agent Microsoft (MAF) pour de nouveaux projets. Cette section couvre les deux car les déploiements AutoGen existants existent toujours.

AutoGen (héritage)

Architecture : Modèle de conversation multi-agents. Les agents sont définis avec des rôles (AssistantAgent, UserProxyAgent, etc.) et communiquent via un gestionnaire de conversations. Le framework a été le pionnier de l'orchestration multi-agents dans laquelle les agents collaborent pour résoudre des tâches.

Points forts de l'héritage :

- La collaboration multi-agents est de premier ordre

- Modèles de conversation riches (séquentiels, discussions de groupe, hiérarchiques)

- Exécution de code dans des environnements sandbox

Limites :

- Gestion des états moins explicite que LangGraph

- Moins d’études de cas de production

- Maintenant en mode maintenance – aucune nouvelle fonctionnalité

Cadre d'agent Microsoft (MAF)

Architecture : Framework unifié fusionnant AutoGen v0.4 et Semantic Kernel, publié en tant que GA en avril 2026. Conçu pour les déploiements de production en entreprise avec intégration Azure.

Principales caractéristiques :

- Orchestration des agents : Définir les agents, les compétences et les flux de travail

- Intégration Azure : Services Azure AI natifs, fonctions Azure, stockage Azure

- Conformité d'entreprise : Prise en charge intégrée des exigences de sécurité de l'entreprise

- Intégration du noyau sémantique : Tirer parti des compétences et des plugins SK existants

Meilleur ajustement : Organisations ayant des engagements Microsoft 365/Azure, déploiements d'entreprise nécessitant des certifications de conformité, équipes utilisant déjà Semantic Kernel.

Remarque sur la migration : Les utilisateurs d'AutoGen doivent planifier la migration vers MAF à l'aide du guide de migration de Microsoft. Les frameworks partagent des concepts mais ont des API différentes.

CrewAI : équipes multi-agents basées sur les rôles

Architecture : CrewAI modélise les agents en tant que membres d'une équipe avec des rôles spécifiques (chercheur, rédacteur, analyste). Les agents sont organisés en « équipes » qui collaborent sur des tâches. Le cadre met l'accent sur les abstractions intuitives par l'homme plutôt que sur la manipulation de graphiques de bas niveau.

Construit entièrement à partir de zéro (pas de dépendance à LangChain), CrewAI offre à la fois simplicité pour les débutants et profondeur pour les utilisateurs avancés grâce aux paradigmes « Crews » et « Flows ».

Notions clés :

- Agents : Définissez le rôle, l’objectif, l’histoire et les outils. Chaque agent opère de manière autonome dans le cadre de son périmètre défini.

- Tâches : Objectifs spécifiques assignés aux agents avec les résultats attendus.

- Equipages : Groupes d'agents travaillant ensemble. Définir le processus (séquentiel, hiérarchique) pour la répartition des tâches.

- Flux : Orchestration basée sur les événements pour un contrôle granulaire dans les déploiements d'entreprise.

Points forts de la production :

- Développement rapide : Travailler avec des systèmes multi-agents en quelques heures, et non en quelques semaines

- Modèle intuitif : La conception basée sur les rôles correspond à la façon dont les équipes envisagent le travail

- CrewAI Entreprise (AMP) : Déclencheurs pour Gmail, Slack, Salesforce ; gestion du déploiement ; RBAC

- Du prototype à la production en une semaine : Calendrier réaliste pour les équipes expérimentées

Données GitHub :

- Plus de 100 000 développeurs certifiés via learn.crewai.com

- Communauté active Discord et documentation

- Les clients Entreprise incluent des sociétés Fortune 500

Considérations relatives à la production :

- Simplicité vs contrôle : Plus facile à démarrer que LangGraph, mais les machines à états complexes nécessitent des solutions de contournement.

- Moins d'outils d'observabilité : Moins d'options de surveillance de la production par rapport à l'écosystème LangChain.

- En évolution rapide : De nouvelles fonctionnalités ajoutées fréquemment peuvent être instables pour l’épinglage en production.

Limites connues :

- État moins explicite : La gestion de l'état est plus implicite que LangGraph. Plus difficile de déboguer des transitions spécifiques.

- Moins de cas extrêmes documentés : La communauté est plus petite que LangChain, donc les problèmes obscurs ont moins de réponses Stack Overflow.

Meilleur ajustement : Équipes souhaitant un prototypage rapide, cas d'utilisation dans lesquels des équipes d'agents basées sur les rôles correspondent au problème, projets privilégiant l'expérience des développeurs plutôt qu'un contrôle maximal, organisations ayant besoin de gains rapides avant de s'engager dans un investissement dans un framework.

# CrewAI minimal example - role-based team

from crewai import Agent, Task, Crew

researcher = Agent(

role="Research Analyst",

goal="Find accurate information",

backstory="Expert at finding and verifying facts",

tools=[search_tool]

)

writer = Agent(

role="Content Writer",

goal="Create engaging content",

backstory="Skilled at translating complex topics",

tools=[write_tool]

)

research_task = Task(

description="Research the topic",

agent=researcher

)

write_task = Task(

description="Write an article",

agent=writer

)

crew = Crew(

agents=[researcher, writer],

tasks=[research_task, write_task],

process="sequential"

)

result = crew.kickoff()

SDK OpenAI Agents (anciennement Swarm)

Architecture : OpenAI Swarm a débuté comme une implémentation pédagogique légère de référence pour les transferts multi-agents en 2024. En 2025, il est devenu le SDK des agents OpenAI—un cadre de production pour créer des agents sur la plateforme OpenAI.

Principales caractéristiques :

- Simplicité : Abstractions minimales, code facile à comprendre

- Intégration native OpenAI : Optimisé pour les modèles GPT

- Transferts d'agent : Modèles propres pour le transfert entre agents spécialisés

Considérations relatives à la production :

- Léger par conception : Intentionnellement minimal : moins de piles incluses que LangGraph ou CrewAI

- Centré sur OpenAI : Conçu autour des modèles OpenAI. Le recours à d’autres fournisseurs nécessite une adaptation.

- En évolution rapide : La transition de Swarm vers Agents SDK signifie que la documentation et les modèles sont toujours en train de se stabiliser.

Meilleur ajustement : Des équipes engagées dans l'écosystème OpenAI, des modèles multi-agents simples nécessitant une mise en œuvre rapide, des objectifs pédagogiques et de prototypage, des projets où un minimum de code est une fonctionnalité.

LlamaIndex et botte de foin

Bien qu'ils soient principalement des frameworks RAG (Retrieval-Augmented Generation), les deux ont des capacités d'agent évoluées :

Agents LlamaIndex

Force : Ingestion et récupération de données de premier ordre. Si vos agents ont besoin d'un traitement de documents sophistiqué, de la construction de graphiques de connaissances ou d'une gestion de données multimodales, LlamaIndex constitue la base.

Fonctionnalités des agents : Les types d'agent incluent les agents ReAct, structurés et conversationnels. LlamaIndex s'intègre à LangChain et peut utiliser LangGraph pour l'orchestration.

Meilleur ajustement : Applications où RAG est central, équipes utilisant déjà LlamaIndex pour le traitement de documents, projets nécessitant des connecteurs de données sophistiqués.

Botte de foin

Architecture : Cadre basé sur un pipeline pour créer des applications d'IA. Architecture modulaire avec des composants pour la récupération, la génération et l'orchestration des agents.

Force : Composition flexible du pipeline. Licence Apache 2.0. Fort dans la recherche de production et les applications RAG.

Meilleur ajustement : Équipes souhaitant une flexibilité de pipeline, des applications gourmandes en recherche, des équipes axées sur Python non engagées dans l'écosystème LangChain.

Matrice de comparaison : cadres axés sur le code

| Cadre | Idéal pour | Courbe d'apprentissage | Prêt pour la production | Communauté | Tarifs |

|---|---|---|---|---|---|

| LangGraph | Workflows dynamiques complexes, humain dans la boucle | 2-4 semaines | Excellent (Uber, LinkedIn, Klarna) | Grand (34,5 millions de téléchargements/mois) | MIT (Gratuit) |

| ÉquipageAI | Prototypage rapide, équipes basées sur les rôles | 1-2 semaines | Bon (Enterprise AMP disponible) | En croissance (certifié 100K+) | MIT (entreprise payée) |

| Cadre d'agents Microsoft | Écosystème Microsoft/Azure | 2-3 semaines | Excellent (Entreprise GA) | Grand (support Microsoft) | Gratuit (des frais Azure s'appliquent) |

| SDK des agents OpenAI | Modèles simples et centrés sur OpenAI | 1 semaine | Évolution | Moyen | Gratuit (coûts de l'API OpenAI) |

| Agents LlamaIndex | Applications lourdes en RAG | 2-3 semaines | Bon | Grand | MIT (Gratuit) |

| Botte de foin | Recherche basée sur un pipeline/RAG | 2 semaines | Bon | Moyen | Apache 2.0 (gratuit) |

Remarque : Les estimations de la « courbe d'apprentissage » supposent une familiarité avec les concepts Python et LLM. Le temps réel de votre équipe variera en fonction de l'expérience.

Plateformes d'entreprise : Microsoft et Google

Pour les organisations qui donnent la priorité à l’infrastructure gérée plutôt qu’au contrôle au niveau du code, les plates-formes d’entreprise offrent des solutions clé en main intégrant conformité et sécurité.

Microsoft Copilot Studio

Aperçu : Plateforme low-code/no-code pour la création d'agents intégrée à l'écosystème Microsoft 365. Fait partie de la plateforme Microsoft Power.

Principales caractéristiques :

- Concepteur d'agents visuels avec workflows glisser-déposer

- Intégration native avec Microsoft 365, Dynamics 365, Azure

- Conformité d'entreprise (SOC, RGPD, HIPAA)

- Extensibilité de Copilot : améliorez Microsoft 365 Copilot avec des fonctionnalités personnalisées

- Intégration de Power Automate pour l'automatisation des flux de travail

Tarif : Basé sur la consommation avec les abonnements Microsoft 365. Packs de capacité supplémentaires disponibles.

Meilleur ajustement : Organisations utilisant déjà Microsoft 365, équipes sans ingénieurs IA dédiés, secteurs réglementés exigeant des certifications de conformité, applications internes d'entreprise.

Générateur d'agents Google Vertex AI

Aperçu : Plateforme gérée pour créer des agents conversationnels sur Google Cloud, anciennement Dialogflow CX, avec des capacités d'IA améliorées.

Principales caractéristiques :

- Concepteur de flux visuel pour les chemins de conversation

- Intégration avec les services Google Cloud (BigQuery, Cloud Storage)

- Intégration de la recherche d'entreprise pour la récupération des connaissances

- Canaux vocaux et textuels

- Modèles Gemini de Google disponibles

Tarif : Paiement à la demande avec Google Cloud. Niveaux tarifaires Dialogflow CX disponibles.

Meilleur ajustement : Organisations ayant investi dans Google Cloud, applications de centre de contact, cas d'utilisation axés sur la voix, équipes tirant parti de BigQuery pour acquérir des connaissances.

Comparaison des plateformes d'entreprise

| Plateforme | Écosystème | Force | Conformité | Idéal pour |

|---|---|---|---|---|

| Microsoft Copilot Studio | Microsoft 365, Azure | Intégration bureautique, automatisation des flux de travail | SOC, RGPD, HIPAA | Applications internes, boutiques M365 |

| Générateur d'agents Google Vertex AI | Google Cloud | Centre de contact, voix, recherche d'entreprise | SOC, RGPD, HIPAA | Support client, la voix d'abord |

Facteur de décision : Choisissez en fonction de votre engagement cloud existant. La migration entre les plates-formes d'entreprise est coûteuse. Ni l’un ni l’autre n’est idéal si vous avez besoin d’un contrôle au niveau du code.

Matrice de décision : choisir un cadre

La sélection du framework dépend de cinq facteurs principaux : les compétences de l'équipe, la complexité du cas d'utilisation, les exigences d'échelle, les besoins d'intégration et le calendrier budgétaire.

Par capacité de l'équipe

| Profil de l'équipe | Recommandé | Éviter |

|---|---|---|

| Forts ingénieurs Python, expérience en ML | LangGraph | Plateformes sans code |

| Petite équipe, besoin de victoires rapides | ÉquipageAI | LangGraph (exagéré pour des besoins simples) |

| Organisation centrée sur Microsoft | Framework d'agent Microsoft / Copilot Studio | Outils de l'écosystème Google |

| Pas d'équipe IA dédiée | VotreGPT, Voiceflow, Copilot Studio | Cadres axés sur le code |

| Forte recherche, expérimentation | LangGraph + LlamaIndex | Plateformes verrouillées par le fournisseur |

Par cas d'utilisation

| Cas d'utilisation | Recommandation principale | Alternative |

|---|---|---|

| Automatisation du support client | VotreGPT / Botpress (sans code) | CrewAI pour une logique personnalisée |

| Flux de travail complexes en plusieurs étapes | LangGraph | Cadre d'agents Microsoft |

| Recherche et génération de contenu | ÉquipageAI | LangGraph |

| Outils internes à l'entreprise | Studio Copilote | LangGraph + hébergement interne |

| Applications lourdes en RAG | LlamaIndex + LangGraph | Botte de foin |

| Agents vocaux / centres de contact | Générateur d'agents Google Vertex AI | Votre voix GPT |

| Conformité des services financiers | LangGraph (auditabilité) | Plateforme d'entreprise |

Par échelle et budget

| Échelle | Priorité budgétaire | Recommandation |

|---|---|---|

| Startup / MVP | Réduire le temps d’ingénierie | CrewAI ou no-code (YourGPT) |

| Stade de croissance | Contrôle de l'équilibre et vitesse | LangGraph ou CrewAI |

| Entreprise | Conformité et fiabilité | LangGraph avec observabilité OU plateforme d'entreprise |

| Production en grand volume | Performances et fiabilité | LangGraph avec points de contrôle et surveillance |

Drapeaux rouges : quand reconsidérer votre décision

Tous les projets n'ont pas besoin d'un framework d'agent. Envisagez des alternatives si :

- Chatbot FAQ simple : Utilisez une plateforme de chatbot de base. Les frameworks ajoutent de la complexité que vous n’utiliserez pas.

- Tâches en une seule étape : Un simple appel de fonction avec gestion des erreurs est plus rapide et plus fiable.

- Aucune gestion d'état nécessaire : Les agents apatrides peuvent utiliser des outils plus légers.

- L'équipe manque d'expérience en ingénierie de l'IA : Commencez sans code, migrez vers le code d'abord lorsque la complexité l'exige.

- La conformité nécessite une piste d'audit : Assurez-vous que votre infrastructure prend en charge la journalisation et la persistance de l'état. LangGraph excelle ici.

Modèles de mise en œuvre

Les agents de production ont besoin de modèles allant au-delà des bases du cadre. Ces modèles s’appliquent à tous les frameworks.

Gestion des erreurs et solutions de repli

Chaque appel d'agent peut échouer. Les systèmes de production gèrent les pannes avec élégance :

- Réessayez avec une interruption exponentielle : Limite de débit des API LLM. La logique de nouvelle tentative évite les échecs en cascade.

- Modèles de repli : Si GPT-4 n'est pas disponible, revenez à GPT-3.5 ou Claude. Définissez des chaînes de secours.

- Dégradation gracieuse : Si les outils échouent, l'agent doit en informer l'utilisateur plutôt que de se bloquer.

- Gestion du délai d'attente : Chaque appel externe nécessite un délai d'attente. Les systèmes de production n’attendent pas indéfiniment.

# LangGraph error handling pattern

from langgraph.graph import StateGraph

from langgraph.checkpoint.memory import MemorySaver

# Define retry logic

def safe_llm_call(prompt, max_retries=3, fallback_model=None):

for attempt in range(max_retries):

try:

return llm.invoke(prompt)

except RateLimitError:

time.sleep(2 ** attempt)

except Exception as e:

if attempt == max_retries - 1:

if fallback_model:

return fallback_model.invoke(prompt)

raise

return None

# Use checkpoints for state persistence

checkpointer = MemorySaver()

app = workflow.compile(checkpointer=checkpointer)

Intégration humaine dans la boucle

Les agents qui effectuent des actions (envoyer des e-mails, modifier des enregistrements, prendre des décisions) ont besoin de l'approbation humaine :

- Point de contrôle avant action : Persistez dans l’état, informez l’humain, attendez l’approbation.

- Interface de révision : Créez ou utilisez une interface utilisateur de révision. LangGraph Studio fournit cela.

- Délai d'expiration lors de l'approbation : Si l'humain ne répond pas, définissez le comportement par défaut.

- Journalisation d'audit : Chaque approbation/rejet doit être enregistré avec son contexte.

Surveillance et observabilité

Les agents de production sont des systèmes distribués. L'observabilité n'est pas facultative :

- Tracez chaque étape : Sachez quel nœud a produit quelle sortie. LangSmith, LangFuse ou journalisation personnalisée.

- Suivre l'utilisation des jetons : Les coûts LLM évoluent avec l’utilisation. Surveillez les coûts par agent et par conversation.

- Mesurer la latence : Chaque nœud ajoute de la latence. Suivez les temps de réponse p50, p95, p99.

- Alerte sur anomalies : Les pics de coûts soudains, les augmentations de latence ou les taux d’erreur nécessitent une enquête.

- Évaluation en production : Échantillonnez périodiquement les résultats des agents pour en évaluer la qualité.

Tests et évaluation

Le comportement des agents est probabiliste. Les tests nécessitent différentes approches :

- Nœuds de tests unitaires : Testez des fonctions individuelles avec des entrées connues et des sorties attendues.

- Flux de tests d'intégration : Exécutez des scénarios de bout en bout avec les résultats attendus.

- Ensembles de données d'évaluation : Créez des entrées représentatives avec les résultats attendus. Mesurez la précision.

- Tests A/B : Déployez de nouvelles versions d'agent sur des sous-ensembles de trafic. Comparez les résultats.

- Tests de régression : Lors de la modification des invites, exécutez la suite d’évaluation pour détecter les régressions de qualité.

Tendances pour 2026

Le paysage des frameworks d’agents converge. Comprendre les tendances aide à prendre des décisions stratégiques :

Les systèmes multi-agents deviennent la norme

Les architectures à agent unique gèrent une complexité limitée. La coordination multi-agents (modèle superviseur, peer-to-peer, hiérarchique) est désormais standard pour les charges de travail de production. LangGraph et CrewAI offrent tous deux un support multi-agent de première classe. Attendez-vous à ce que les cadres convergent vers des modèles communs.

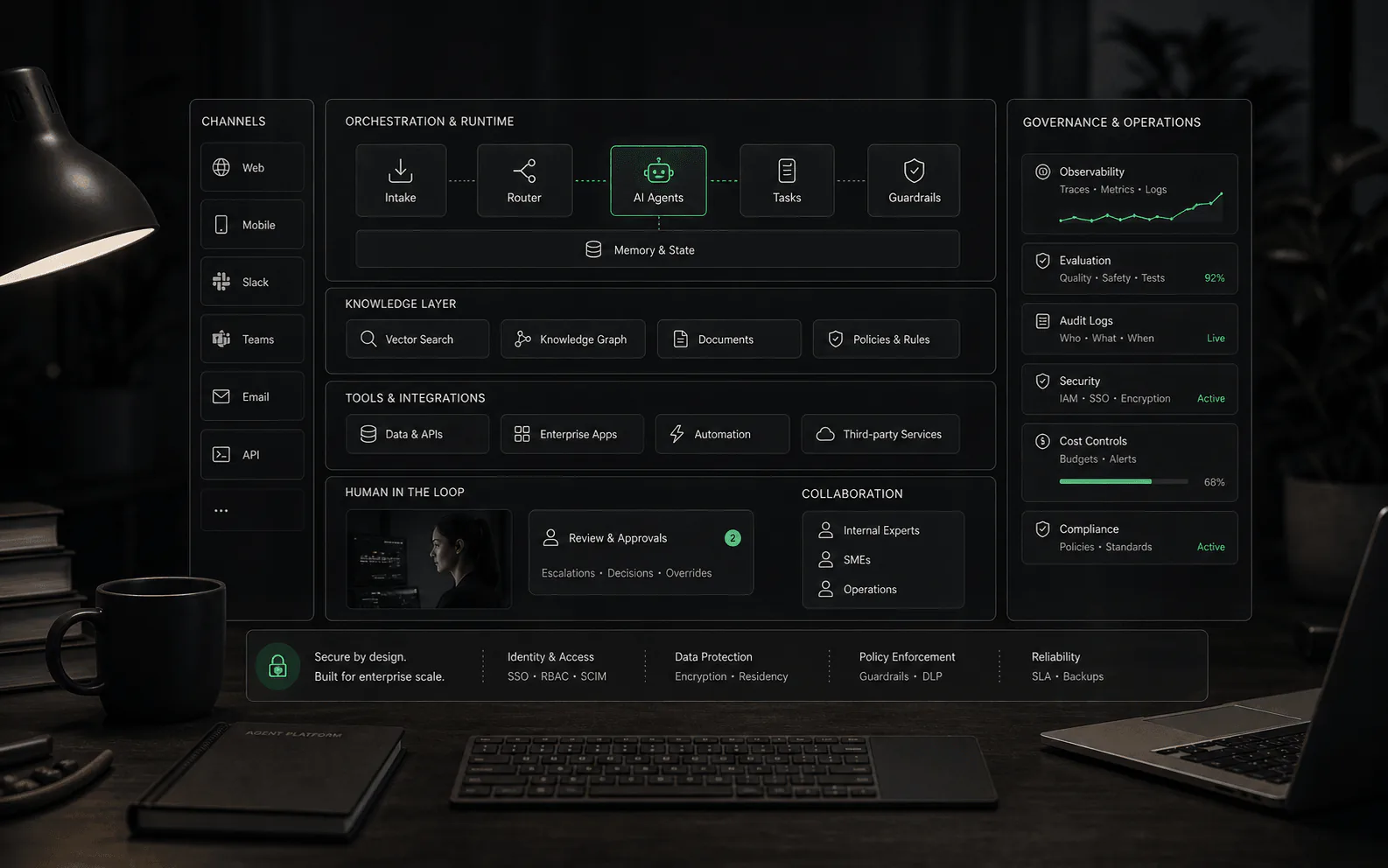

Plateformes d'orchestration d'agents

À mesure que les agents prolifèrent, les organisations ont besoin de couches d'orchestration qui gèrent les cycles de vie, le routage et la surveillance des agents. Attendez-vous à une croissance des offres de « plateformes d'agents » qui se situent au-dessus des cadres individuels. Microsoft Agent Framework et les plates-formes d'entreprise pointent vers cet avenir.

Convergence du cadre

LangGraph, CrewAI et d'autres frameworks implémentent des modèles similaires (points de contrôle, mémoire, humain dans la boucle). Les capacités de base deviennent des enjeux de table. La différenciation se déplace vers l'expérience des développeurs, l'écosystème et les outils de production.

Le modèle indépendant devient la valeur par défaut

Les frameworks qui s’enferment dans des fournisseurs à modèle unique sont perdants. LangGraph fonctionne avec n'importe quel LLM. CrewAI prend en charge plusieurs fournisseurs. Attendez-vous à ce que cette flexibilité reste essentielle à mesure que les modèles évoluent rapidement.

Que regarder

- Écosystème LangGraph 2.0 : LangChain investit massivement. Attendez-vous à une innovation continue.

- Adoption de CrewAI Entreprise : Si l’AMP d’entreprise gagne du terrain, CrewAI devient viable pour les déploiements à grande échelle.

- Les fournisseurs de modèles construisent des cadres : SDK Agents d'OpenAI, efforts de framework d'Anthropic. Les frameworks des fournisseurs peuvent vous enfermer.

- Efforts de normalisation : À mesure que les modèles mûrissent, attendez-vous à une standardisation des interfaces et de l’orchestration des agents.

Sources et références

Vérifiez les revendications du cadre et explorez davantage :

FAQ

Questions courantes

Quelle est la différence entre LangGraph et CrewAI ?

LangGraph utilise une architecture basée sur des graphiques avec une gestion explicite de l'état, idéale pour les flux de travail complexes nécessitant un contrôle précis. CrewAI utilise un modèle d'agent basé sur les rôles dans lequel les agents se voient attribuer des rôles spécifiques et collaborent en équipe, ce qui rend le démarrage plus simple mais moins flexible pour les flux de travail non conventionnels.

AutoGen est-il toujours maintenu en 2026 ?

AutoGen est entré en mode maintenance en 2026. Microsoft recommande désormais Microsoft Agent Framework (MAF) pour les nouveaux projets, qui ont fusionné AutoGen v0.4 avec Semantic Kernel. Les utilisateurs AutoGen existants doivent planifier la migration vers MAF.

Quel framework convient le mieux aux agents d’IA de production ?

LangGraph et CrewAI sont les frameworks code-first les plus prêts pour la production en 2026. LangGraph excelle dans les flux de travail avec état complexes (utilisés par Uber, LinkedIn, Klarna). CrewAI est meilleur pour le prototypage rapide et lorsque les équipes d'agents basées sur les rôles correspondent à votre cas d'utilisation. Les équipes d'entreprise doivent également évaluer Microsoft Agent Framework et Google Agent Builder pour les plates-formes gérées.

Dois-je utiliser une plateforme d’agents IA avec code d’abord ou sans code ?

Les frameworks axés sur le code (LangGraph, CrewAI) offrent un contrôle maximal et sont essentiels lorsque vous avez besoin d'une logique personnalisée, d'intégrations uniques ou d'une observabilité approfondie. Les plates-formes sans code (YourGPT, Voiceflow) sont plus rapides à déployer pour des cas d'utilisation standard comme le support client, mais troquent la flexibilité contre la vitesse. De nombreuses équipes commencent sans code et migrent vers le code d'abord lorsque la complexité augmente.

Quelle est la courbe d’apprentissage des frameworks d’agents IA ?

CrewAI a la courbe d'apprentissage la plus courte : les développeurs peuvent créer des systèmes multi-agents fonctionnels en quelques heures. LangGraph nécessite une compréhension des machines à états basées sur des graphiques, mais est récompensé par un contrôle de niveau production. Microsoft Agent Framework a une complexité modérée avec une excellente documentation. Prévoyez 2 à 4 semaines pour la maîtrise de LangGraph, 1 à 2 semaines pour CrewAI.

Outils d'achat

Comparez les frameworks en fonction de votre flux de travail.

Utilisez la méthodologie pour évaluer les capacités de l'équipe, la complexité des cas d'utilisation, les exigences d'intégration et l'état de préparation à la production avant de vous engager dans un cadre.