Introducción: Por qué son importantes los marcos en 2026

En 2023, crear un agente de IA significó envolver GPT-4 en un bucle while con llamadas a herramientas. Para 2026, ese enfoque colapsará en la producción. Los agentes reales necesitan gestión del estado, recuperación de errores, flujos de trabajo con presencia humana, coordinación entre múltiples agentes, observabilidad e infraestructura de implementación. Los marcos ahora manejan la complejidad que acabó con la mayoría de los experimentos con agentes de 2023-2024.

La conversación ha pasado de "¿deberíamos utilizar agentes de IA?" a "¿qué marco sobrevive a la carga de producción?" Esta guía cubre los marcos que lograron atravesar el valle de la muerte: aquellos con comunidades activas, despliegues de producción y limitaciones honestas.

Para quién es esta guía:

- Desarrolladores evaluar con qué marco de código primero comprometerse para un proyecto de 6 a 12 meses

- CTO y líderes de ingeniería tomar decisiones estratégicas sobre la plataforma para sus equipos

- Equipos de plataforma decidir entre marcos autohospedados y soluciones empresariales administradas

- cualquiera que vio una demostración funcionar perfectamente y luego falló silenciosamente en producción

Categorías marco: comprensión del paisaje

Las herramientas de agentes de IA se dividen en cuatro categorías distintas. Elegir la categoría incorrecta genera más dolor que elegir la herramienta incorrecta dentro de una categoría.

Constructores sin código/con código bajo

Plataformas como YourGPT, Flujo de voz, y Botpress Ofrece interfaces visuales para diseñar flujos de trabajo de agentes. Usted define rutas de conversación, conecta fuentes de conocimiento e implementa sin escribir código.

Cuando usar: Casos de uso estándar (atención al cliente, calificación de clientes potenciales, automatización de preguntas frecuentes), equipos sin ingenieros de IA dedicados, creación rápida de prototipos antes de comprometerse con el desarrollo personalizado.

Limitaciones: La lógica personalizada requiere soluciones alternativas o extensiones de API. La depuración es más difícil cuando no puedes inspeccionar el código. La dependencia de un proveedor es real: migrar requiere reconstrucción.

Marcos de código primero

LangGraph, TripulaciónAI, Marco del agente de Microsoft, y SDK de agentes OpenAI darle control a nivel de código. Usted define agentes, herramientas, máquinas de estado y orquestación en Python o TypeScript.

Cuando usar: Flujos de trabajo complejos que requieren lógica personalizada, integraciones únicas que no están cubiertas por plataformas sin código, aplicaciones donde la observabilidad y la depuración son críticas, equipos con una sólida capacidad de ingeniería.

Ventajas: Control total, control de versiones, capacidad de prueba, portabilidad entre proveedores de la nube, capacidad para depurar problemas de producción.

Plataformas empresariales

Estudio Microsoft Copiloto y Generador de agentes de IA de Google Vertex Ofrecer infraestructura administrada con cumplimiento empresarial, controles de seguridad e integración con sistemas empresariales existentes.

Cuando usar: Organizaciones con compromisos de Microsoft 365 o Google Cloud, industrias reguladas que requieren certificaciones de cumplimiento, implementaciones a gran escala donde la infraestructura administrada reduce la carga operativa.

Agentes Especializados

Agentes de codificación (GitHub Copilot, Cursor), agentes de voz (plataformas de voz dedicadas) y agentes de dominio específico optimizados para casos de uso particulares.

Cuando usar: Cuando su caso de uso coincide exactamente con la especialización. Los marcos genéricos añaden complejidad para estos casos de uso limitados.

Análisis profundo: marcos que priorizan el código

Esta sección cubre los marcos que los desarrolladores evalúan para los sistemas de agentes de producción. Cada evaluación incluye arquitectura, fortalezas, consideraciones de producción, datos de GitHub, casos de uso reales, precios, tamaño de la comunidad y limitaciones conocidas.

LangGraph: agentes con estado de grado de producción

Arquitectura: LangGraph modela agentes como máquinas de estado construidas sobre gráficos dirigidos. Cada nodo representa un paso de cálculo; Los bordes definen transiciones según las condiciones. El estado se define explícitamente y se pasa entre nodos, lo que hace que el comportamiento del agente sea determinista y depurable.

El marco surgió de LangChain en 2024 cuando el equipo reconoció que las cadenas (composiciones lineales) no podían manejar la complejidad de los agentes de producción. LangGraph 2.0, lanzado en febrero de 2026, codifica tres años de patrones de producción en un marco maduro.

Conceptos clave:

- Gráfico de estado: La abstracción central. Defina el esquema de estado, agregue nodos (funciones), agregue bordes (transiciones), compílelo en un ejecutable.

- Puntos de control: Persistir estado en cualquier punto. Reanude la ejecución desde cualquier punto de control, algo fundamental para los agentes con una ejecución prolongada.

- Memoria: Soporte integrado para memoria de conversación, persistencia a nivel de subproceso y estado entre sesiones.

- Humano en el circuito: Pausar la ejecución para revisión humana, inyectar comentarios y continuar desde la interrupción.

Fortalezas de producción:

- Observabilidad: Cada transición de estado es rastreable. La integración de LangSmith proporciona monitoreo, depuración y evaluación de la producción.

- Comprobabilidad: Los gráficos se pueden probar unitariamente nodo por nodo. El estado es explícito, lo que hace que las afirmaciones sean sencillas.

- Recuperación de errores: Los puntos de control significan que nunca perderás trabajo. Reanudar desde el último estado exitoso después de los fracasos.

- Escala: Utilizado por Uber, LinkedIn y Klarna para cargas de trabajo de producción. 34,5 millones de descargas mensuales sugieren una adopción de producción real.

Datos de GitHub (mayo de 2026):

- Estrellas: ~24,800

- Descargas mensuales: 34,5 millones

- Números abiertos: 264

- Números cerrados: 1.015

- Solicitudes de extracción: 246 abiertas, 3619 fusionadas

- Versiones: 504 (última: langgraph-cli==0.4.24)

- Colaboradores: 200+

Casos de uso reales:

- Uber: Automatización de asistencia al usuario en varios pasos con transferencia a agentes humanos

- LinkedIn: Flujos de trabajo de moderación de contenido que requieren una gestión de estado compleja

- Klarna: Chatbot de servicios financieros con puntos de control de cumplimiento

Precios: Código abierto (licencia MIT). LangSmith (plataforma de observabilidad) tiene niveles gratuitos para desarrollo y niveles pagos para producción.

Limitaciones conocidas:

- Curva de aprendizaje: Requiere comprender las máquinas de estados basadas en gráficos. Los desarrolladores acostumbrados al pensamiento lineal necesitan entre 2 y 4 semanas para volverse productivos.

- Verbosidad: Los agentes simples requieren más texto estándar que CrewAI. La compensación es el control explícito.

- Dependencia de LangChain: Si bien LangGraph puede funcionar de forma independiente, la mayor parte de la documentación asume el ecosistema LangChain. Pure LangGraph requiere más configuración.

Mejor ajuste: Flujos de trabajo complejos de varios pasos, aplicaciones que requieren intervención humana, equipos que priorizan la observabilidad de la producción, proyectos donde el comportamiento de los agentes debe ser auditable.

# LangGraph minimal example - stateful agent

from langgraph.graph import StateGraph, END

from typing import TypedDict

class AgentState(TypedDict):

messages: list

context: dict

next_action: str

def process_query(state: AgentState) -> AgentState:

# Your processing logic

return {"next_action": "respond"}

def respond(state: AgentState) -> AgentState:

# Generate response

return {"next_action": END}

workflow = StateGraph(AgentState)

workflow.add_node("process", process_query)

workflow.add_node("respond", respond)

workflow.add_edge("process", "respond")

workflow.set_entry_point("process")

app = workflow.compile()

AutoGen y Microsoft Agent Framework

Importante: AutoGen entró en modo de mantenimiento en 2026. Microsoft recomienda Marco de agentes de Microsoft (MAF) para nuevos proyectos. Esta sección cubre ambos porque aún existen implementaciones de AutoGen.

AutoGen (heredado)

Arquitectura: Patrón de conversación multiagente. Los agentes se definen con roles (AssistantAgent, UserProxyAgent, etc.) y se comunican a través de un administrador de conversaciones. El marco fue pionero en la orquestación de múltiples agentes donde los agentes colaboran para resolver tareas.

Fortalezas heredadas:

- La colaboración entre múltiples agentes es de primera clase

- Patrones de conversación enriquecidos (secuencial, chat grupal, jerárquico)

- Ejecución de código en entornos sandbox

Limitaciones:

- Gestión estatal menos explícita que LangGraph

- Menos estudios de casos de producción

- Ahora en modo de mantenimiento: no hay funciones nuevas

Marco de agentes de Microsoft (MAF)

Arquitectura: Marco unificado que fusiona AutoGen v0.4 y Semantic Kernel, lanzado como GA en abril de 2026. Diseñado para implementaciones de producción empresarial con integración de Azure.

Características clave:

- Orquestación de agentes: Definir agentes, habilidades y flujos de trabajo.

- Integración de Azure: Servicios nativos de Azure AI, funciones de Azure, almacenamiento de Azure

- Cumplimiento empresarial: Soporte integrado para requisitos de seguridad empresarial

- Integración del kernel semántico: Aproveche las habilidades y complementos de SK existentes

Mejor ajuste: Organizaciones con compromisos de Microsoft 365/Azure, implementaciones empresariales que requieren certificaciones de cumplimiento, equipos que ya utilizan Semantic Kernel.

Nota de migración: Los usuarios de AutoGen deben planificar la migración a MAF utilizando la guía de migración de Microsoft. Los marcos comparten conceptos pero tienen API diferentes.

CrewAI: equipos multiagente basados en roles

Arquitectura: CrewAI modela a los agentes como miembros de un equipo con roles específicos (investigador, Writer, analista). Los agentes están organizados en "equipos" que colaboran en tareas. El marco enfatiza las abstracciones intuitivas humanas sobre la manipulación de gráficos de bajo nivel.

Creado completamente desde cero (sin dependencia de LangChain), CrewAI ofrece simplicidad para principiantes y profundidad para usuarios avanzados a través de los paradigmas "Crews" y "Flows".

Conceptos clave:

- Agentes: Definir rol, objetivo, historia de fondo y herramientas. Cada agente opera de forma autónoma dentro de su ámbito definido.

- Tareas: Objetivos específicos asignados a los agentes con resultados esperados.

- Tripulaciones: Grupos de agentes trabajando juntos. Definir proceso (secuencial, jerárquico) para la distribución de tareas.

- Flujos: Orquestación basada en eventos para un control granular en implementaciones empresariales.

Fortalezas de producción:

- Desarrollo rápido: Sistemas multiagente funcionando en horas, no en semanas

- Modelo intuitivo: El diseño basado en roles coincide con la forma en que los equipos piensan sobre el trabajo

- Empresa CrewAI (AMP): Activadores para Gmail, Slack, Salesforce; gestión de implementación; RBAC

- Del prototipo a la producción en una semana: Cronograma realista para equipos experimentados

Datos de GitHub:

- Más de 100.000 desarrolladores certificados a través de learn.crewai.com

- Comunidad activa Discord y documentación.

- Los clientes empresariales incluyen empresas Fortune 500

Consideraciones de producción:

- Simplicidad versus control: Es más fácil de iniciar que LangGraph, pero las máquinas de estados complejas requieren soluciones alternativas.

- Menos herramientas de observabilidad: Menos opciones de monitoreo de producción en comparación con el ecosistema LangChain.

- En rápida evolución: Las nuevas funciones que se agregan con frecuencia pueden ser inestables para la fijación de producción.

Limitaciones conocidas:

- Estado menos explícito: La gestión estatal es más implícita que LangGraph. Es más difícil depurar transiciones específicas.

- Menos casos extremos documentados: La comunidad es más pequeña que LangChain, por lo que los problemas oscuros tienen menos respuestas de Stack Overflow.

Mejor ajuste: Equipos que desean creación rápida de prototipos, casos de uso en los que los equipos de agentes basados en roles se adaptan al problema, proyectos que priorizan la experiencia del desarrollador sobre el control máximo, organizaciones que necesitan resultados rápidos antes de comprometerse con una inversión en el marco.

# CrewAI minimal example - role-based team

from crewai import Agent, Task, Crew

researcher = Agent(

role="Research Analyst",

goal="Find accurate information",

backstory="Expert at finding and verifying facts",

tools=[search_tool]

)

writer = Agent(

role="Content Writer",

goal="Create engaging content",

backstory="Skilled at translating complex topics",

tools=[write_tool]

)

research_task = Task(

description="Research the topic",

agent=researcher

)

write_task = Task(

description="Write an article",

agent=writer

)

crew = Crew(

agents=[researcher, writer],

tasks=[research_task, write_task],

process="sequential"

)

result = crew.kickoff()

SDK de agentes OpenAI (anteriormente Swarm)

Arquitectura: OpenAI Swarm comenzó como una implementación de referencia educativa liviana para transferencias de múltiples agentes en 2024. En 2025, evolucionó hasta convertirse en el SDK de agentes OpenAI—Un marco de producción para crear agentes en la plataforma OpenAI.

Características clave:

- Simplicidad: Abstracciones mínimas, código fácil de entender.

- Integración nativa de OpenAI: Optimizado para modelos GPT

- Traspasos de agentes: Patrones limpios para transferencia entre agentes especializados.

Consideraciones de producción:

- Ligero por diseño: Intencionalmente mínimo: se incluyen menos baterías que LangGraph o CrewAI

- Centrado en OpenAI: Diseñado en torno a modelos OpenAI. El uso de otros proveedores requiere adaptación.

- Evolucionando rápidamente: La transición de Swarm a Agents SDK significa que la documentación y los patrones aún se están estabilizando.

Mejor ajuste: Equipos comprometidos con el ecosistema de OpenAI, patrones simples de múltiples agentes que requieren una implementación rápida, propósitos educativos y creación de prototipos, proyectos donde el código mínimo es una característica.

LlamaIndex y Haystack

Aunque principalmente son marcos RAG (Recuperación-Generación Aumentada), ambos han desarrollado capacidades de agente:

Agentes LlamaIndex

Fuerza: La mejor ingesta y recuperación de datos de su clase. Si sus agentes necesitan un procesamiento de documentos sofisticado, construcción de gráficos de conocimiento o manejo de datos multimodal, LlamaIndex proporciona la base.

Características del agente: Los tipos de agentes incluyen agentes ReAct, estructurados y conversacionales. LlamaIndex se integra con LangChain y puede usar LangGraph para la orquestación.

Mejor ajuste: Aplicaciones donde RAG es central, equipos que ya utilizan LlamaIndex para el procesamiento de documentos, proyectos que necesitan conectores de datos sofisticados.

pajar

Arquitectura: Marco basado en canalizaciones para crear aplicaciones de IA. Arquitectura modular con componentes para recuperación, generación y orquestación de agentes.

Fuerza: Composición flexible de tuberías. Licencia Apache 2.0. Fuerte en búsqueda de producción y aplicaciones RAG.

Mejor ajuste: Equipos que desean flexibilidad en la canalización, aplicaciones con muchas búsquedas, equipos que priorizan Python y no están comprometidos con el ecosistema LangChain.

Matriz de comparación: marcos de código primero

| Marco | Mejor para | Curva de aprendizaje | Listo para producción | Comunidad | Precios |

|---|---|---|---|---|---|

| LangGraph | Flujos de trabajo complejos con estado, humanos en el circuito | 2-4 semanas | Excelente (Uber, LinkedIn, Klarna) | Grande (34,5 millones de descargas/mes) | MIT (gratis) |

| TripulaciónAI | Creación rápida de prototipos y equipos basados en roles | 1-2 semanas | Bueno (AMP empresarial disponible) | En crecimiento (certificado 100K+) | MIT (pago empresarial) |

| Marco del agente de Microsoft | Ecosistema Microsoft/Azure | 2-3 semanas | Excelente (Empresa GA) | Grande (respaldo de Microsoft) | Gratis (se aplican costos de Azure) |

| SDK de agentes OpenAI | Patrones simples centrados en OpenAI | 1 semana | Evolucionando | Medio | Gratis (costos de la API OpenAI) |

| Agentes LlamaIndex | Aplicaciones con mucho RAG | 2-3 semanas | bueno | Grande | MIT (gratis) |

| pajar | Búsqueda basada en canalización/RAG | 2 semanas | bueno | Medio | Apache 2.0 (gratis) |

Nota: Las estimaciones de la "curva de aprendizaje" suponen familiaridad con los conceptos de Python y LLM. El tiempo real de su equipo variará según la experiencia.

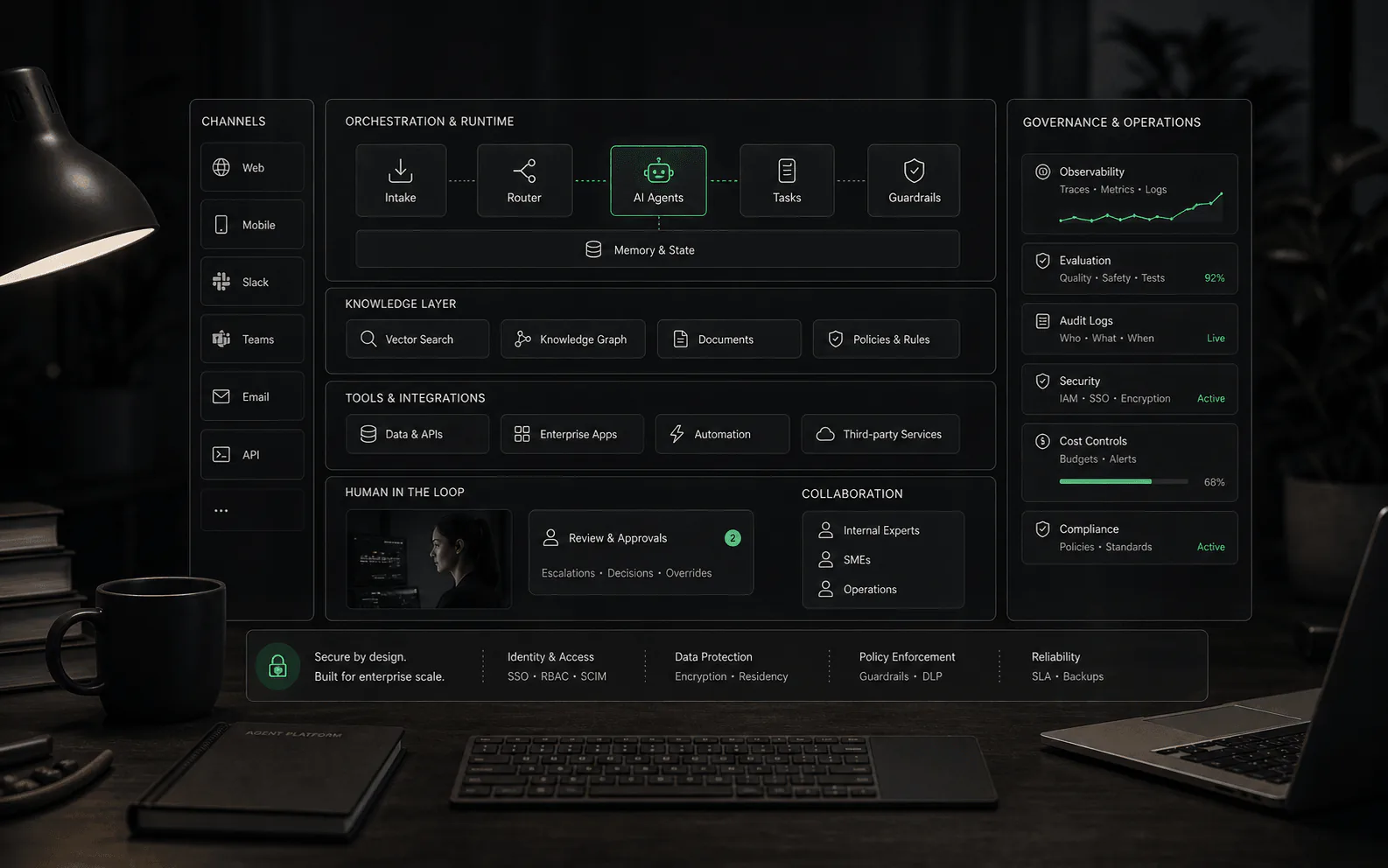

Plataformas empresariales: Microsoft y Google

Para las organizaciones que priorizan la infraestructura administrada sobre el control a nivel de código, las plataformas empresariales ofrecen soluciones llave en mano con cumplimiento y seguridad integrados.

Estudio Microsoft Copiloto

Descripción general: Plataforma de código bajo/sin código para crear agentes integrados con el ecosistema de Microsoft 365. Parte de Microsoft Power Platform.

Características clave:

- Diseñador de agentes visuales con flujos de trabajo de arrastrar y soltar

- Integración nativa con Microsoft 365, Dynamics 365, Azure

- Cumplimiento empresarial (SOC, GDPR, HIPAA)

- Extensibilidad de Copilot: mejore Microsoft 365 Copilot con capacidades personalizadas

- Integración de Power Automate para la automatización del flujo de trabajo

Precios: Basado en el consumo con suscripciones a Microsoft 365. Paquetes de capacidad adicional disponibles.

Mejor ajuste: Organizaciones que ya utilizan Microsoft 365, equipos sin ingenieros de IA dedicados, industrias reguladas que requieren certificaciones de cumplimiento, aplicaciones empresariales internas.

Generador de agentes de IA de Google Vertex

Descripción general: Plataforma administrada para crear agentes conversacionales en Google Cloud, anteriormente Dialogflow CX, con capacidades mejoradas de IA.

Características clave:

- Diseñador de flujo visual para rutas de conversación.

- Integración con los servicios de Google Cloud (BigQuery, Cloud Storage)

- Integración de búsqueda empresarial para la recuperación de conocimientos

- Canales de voz y texto.

- Los modelos Gemini de Google disponibles

Precios: Pago por solicitud con Google Cloud. Niveles de precios de Dialogflow CX disponibles.

Mejor ajuste: Organizaciones con inversiones en Google Cloud, aplicaciones de centros de contacto, casos de uso de voz primero y equipos que aprovechan BigQuery para obtener conocimiento.

Comparación de plataformas empresariales

| Plataforma | Ecosistema | Fuerza | Cumplimiento | Mejor para |

|---|---|---|---|---|

| Estudio Microsoft Copiloto | Microsoft 365, Azure | Integración de Office, automatización del flujo de trabajo. | SOC, RGPD, HIPAA | Aplicaciones internas, tiendas M365 |

| Generador de agentes de IA de Google Vertex | Nube de Google | Centro de contacto, voz, búsqueda empresarial | SOC, RGPD, HIPAA | Atención al cliente, primero la voz |

Factor de decisión: Elija según su compromiso actual con la nube. La migración entre plataformas empresariales es costosa. Ninguno de los dos es ideal si necesita control a nivel de código.

Matriz de decisiones: elección de un marco

La selección del marco depende de cinco factores principales: habilidades del equipo, complejidad del caso de uso, requisitos de escala, necesidades de integración y cronograma presupuestario.

Por capacidad del equipo

| Perfil del equipo | Recomendado | evitar |

|---|---|---|

| Fuertes ingenieros de Python, experiencia en ML | LangGraph | Plataformas sin código |

| Equipo pequeño, necesita victorias rápidas | TripulaciónAI | LangGraph (exagerado para necesidades simples) |

| Organización centrada en Microsoft | Marco de agentes de Microsoft/Copilot Studio | Herramientas del ecosistema de Google |

| Sin equipo de IA dedicado | YourGPT, Voiceflow, Copilot Studio | Marcos de código primero |

| Investigación intensa, experimentación. | LangGraph + LlamaIndex | Plataformas bloqueadas por proveedores |

Por caso de uso

| Caso de uso | Recomendación principal | Alternativa |

|---|---|---|

| Automatización de atención al cliente | YourGPT / Botpress (sin código) | CrewAI para lógica personalizada |

| Flujos de trabajo complejos de varios pasos | LangGraph | Marco del agente de Microsoft |

| Investigación y generación de contenidos. | TripulaciónAI | LangGraph |

| Herramientas internas de la empresa | Estudio copiloto | LangGraph + alojamiento interno |

| Aplicaciones con mucho RAG | LlamaIndex + LangGraph | pajar |

| Agentes de voz/centros de contacto | Generador de agentes de IA de Google Vertex | Tu voz GPT |

| Cumplimiento de servicios financieros | LangGraph (auditabilidad) | Plataforma empresarial |

Por escala y presupuesto

| Escala | Prioridad presupuestaria | Recomendación |

|---|---|---|

| Inicio / MVP | Minimizar el tiempo de ingeniería | CrewAI o sin código (YourGPT) |

| Etapa de crecimiento | Control de equilibrio y velocidad. | LangGraph o CrewAI |

| Empresa | Cumplimiento y confiabilidad | LangGraph con observabilidad O plataforma empresarial |

| Producción de alto volumen | Rendimiento y confiabilidad | LangGraph con puntos de control y monitoreo |

Banderas rojas: cuándo reconsiderar

No todos los proyectos necesitan un marco de agente. Considere alternativas si:

- Chatbot de preguntas frecuentes simples: Utilice una plataforma de chatbot básica. Los marcos añaden una complejidad que no utilizarás.

- Tareas de un solo paso: Una llamada de función simple con manejo de errores es más rápida y confiable.

- No se necesita gestión estatal: Los agentes apátridas pueden utilizar herramientas más ligeras.

- El equipo carece de experiencia en ingeniería de IA: Comience sin código y migre primero al código cuando la complejidad lo exija.

- El cumplimiento requiere pista de auditoría: Asegúrese de que su marco admita el registro y la persistencia del estado. LangGraph sobresale aquí.

Patrones de implementación

Los agentes de producción requieren patrones que van más allá de los conceptos básicos del marco. Estos patrones se aplican en todos los marcos.

Manejo de errores y alternativas

Cada llamada de agente puede fallar. Los sistemas de producción manejan las fallas con gracia:

- Reintentar con retroceso exponencial: Límite de tasa de API de LLM. La lógica de reintento evita errores en cascada.

- Modelos alternativos: Si GPT-4 no está disponible, recurra a GPT-3.5 o Claude. Definir cadenas de respaldo.

- Degradación elegante: Si las herramientas fallan, el agente debe informar al usuario en lugar de colgarlo.

- Manejo del tiempo de espera: Cada llamada externa necesita un tiempo de espera. Los sistemas de producción no esperan indefinidamente.

# LangGraph error handling pattern

from langgraph.graph import StateGraph

from langgraph.checkpoint.memory import MemorySaver

# Define retry logic

def safe_llm_call(prompt, max_retries=3, fallback_model=None):

for attempt in range(max_retries):

try:

return llm.invoke(prompt)

except RateLimitError:

time.sleep(2 ** attempt)

except Exception as e:

if attempt == max_retries - 1:

if fallback_model:

return fallback_model.invoke(prompt)

raise

return None

# Use checkpoints for state persistence

checkpointer = MemorySaver()

app = workflow.compile(checkpointer=checkpointer)

Integración humana en el circuito

Los agentes que toman acciones (envían correos electrónicos, modifican registros, toman decisiones) necesitan aprobación humana:

- Punto de control antes de la acción: Persistir en el estado, notificar al ser humano, esperar la aprobación.

- Interfaz de revisión: Cree o utilice una interfaz de usuario de revisión. LangGraph Studio proporciona esto.

- Tiempo de espera al aprobar: Si el humano no responde, defina el comportamiento predeterminado.

- Registro de auditoría: Cada aprobación/rechazo debe registrarse con contexto.

Monitoreo y observabilidad

Los agentes de producción son sistemas distribuidos. La observabilidad no es opcional:

- Sigue cada paso: Sepa qué nodo produjo qué resultado. LangSmith, LangFuse o registro personalizado.

- Seguimiento del uso del token: Los costos de LLM aumentan con el uso. Supervise los costos por agente y por conversación.

- Medir latencia: Cada nodo agrega latencia. Realice un seguimiento de los tiempos de respuesta de p50, p95, p99.

- Alerta sobre anomalías: Los aumentos repentinos de costos, los aumentos de latencia o las tasas de error requieren investigación.

- Evaluación en producción: Muestreo periódico de los resultados de los agentes para la evaluación de la calidad.

Pruebas y evaluación

El comportamiento de los agentes es probabilístico. Las pruebas requieren diferentes enfoques:

- Nodos de prueba unitaria: Pruebe funciones individuales con entradas conocidas y salidas esperadas.

- Flujos de prueba de integración: Ejecute escenarios de un extremo a otro con los resultados esperados.

- Conjuntos de datos de evaluación: Crear insumos representativos con los resultados esperados. Medir la precisión.

- Pruebas A/B: Implemente nuevas versiones de agentes en subconjuntos de tráfico. Compara los resultados.

- Pruebas de regresión: Al modificar las indicaciones, ejecute el conjunto de evaluación para detectar regresiones de calidad.

Tendencias para 2026

El panorama del marco de agentes está convergiendo. Comprender las tendencias ayuda con las decisiones estratégicas:

Los sistemas multiagente se convierten en estándar

Las arquitecturas de agente único manejan una complejidad limitada. La coordinación de múltiples agentes (patrón de supervisor, de igual a igual, jerárquica) ahora es estándar para las cargas de trabajo de producción. Tanto LangGraph como CrewAI brindan soporte multiagente de primera clase. Espere que los marcos converjan en patrones comunes.

Plataformas de orquestación de agentes

A medida que los agentes proliferan, las organizaciones necesitan capas de orquestación que gestionen los ciclos de vida, el enrutamiento y el monitoreo de los agentes. Espere un crecimiento en las ofertas de "plataformas de agentes" que se ubican por encima de los marcos individuales. Microsoft Agent Framework y las plataformas empresariales apuntan hacia este futuro.

Convergencia marco

LangGraph, CrewAI y otros marcos están implementando patrones similares (puntos de control, memoria, humanos en el circuito). Las capacidades básicas se están convirtiendo en algo en juego. La diferenciación cambia hacia la experiencia del desarrollador, el ecosistema y las herramientas de producción.

El modelo independiente se vuelve predeterminado

Los marcos que se limitan a proveedores de modelos únicos pierden. LangGraph funciona con cualquier LLM. CrewAI admite múltiples proveedores. Espere que esta flexibilidad siga siendo esencial a medida que los modelos evolucionan rápidamente.

Qué mirar

- Ecosistema LangGraph 2.0: LangChain está invirtiendo mucho. Espere innovación continua.

- Adopción de CrewAI Enterprise: Si AMP empresarial gana terreno, CrewAI se vuelve viable para implementaciones a gran escala.

- Proveedores de modelos que crean marcos: SDK de agentes de OpenAI, esfuerzos de marco de Anthropic. Los marcos de los proveedores pueden encerrarlo.

- Esfuerzos de estandarización: A medida que los patrones maduren, se espera la estandarización de las interfaces y la orquestación de los agentes.

Fuentes y referencias

Verifique las afirmaciones del marco y explore más a fondo:

Preguntas frecuentes

Preguntas comunes

¿Cuál es la diferencia entre LangGraph y CrewAI?

LangGraph utiliza una arquitectura basada en gráficos con gestión de estado explícita, ideal para flujos de trabajo complejos que requieren un control detallado. CrewAI utiliza un modelo de agentes basado en roles en el que a los agentes se les asignan roles específicos y colaboran como un equipo, lo que hace que sea más sencillo al principio pero menos flexible para flujos de trabajo no convencionales.

¿Se seguirá manteniendo AutoGen en 2026?

AutoGen entró en modo de mantenimiento en 2026. Microsoft ahora recomienda Microsoft Agent Framework (MAF) para nuevos proyectos, que fusionó AutoGen v0.4 con Semantic Kernel. Los usuarios existentes de AutoGen deben planificar la migración a MAF.

¿Qué marco es mejor para los agentes de IA de producción?

LangGraph y CrewAI son los marcos de código primero más listos para producción en 2026. LangGraph se destaca por flujos de trabajo complejos con estado (utilizados por Uber, LinkedIn, Klarna). CrewAI es mejor para la creación rápida de prototipos y cuando los equipos de agentes basados en roles coinciden con su caso de uso. Los equipos empresariales también deberían evaluar Microsoft Agent Framework y Google Agent Builder para plataformas administradas.

¿Debo utilizar una plataforma de agente de IA con código primero o sin código?

Los marcos de código primero (LangGraph, CrewAI) ofrecen el máximo control y son esenciales cuando necesita lógica personalizada, integraciones únicas u observabilidad profunda. Las plataformas sin código (YourGPT, Voiceflow) son más rápidas de implementar para casos de uso estándar como atención al cliente, pero intercambian flexibilidad por velocidad. Muchos equipos comienzan sin código y migran al código primero cuando crece la complejidad.

¿Cuál es la curva de aprendizaje de los marcos de agentes de IA?

CrewAI tiene la curva de aprendizaje más superficial: los desarrolladores pueden crear sistemas multiagente que funcionen en horas. LangGraph requiere comprender las máquinas de estado basadas en gráficos, pero recompensa con un control de nivel de producción. Microsoft Agent Framework tiene una complejidad moderada con una documentación excelente. Planifique de 2 a 4 semanas para dominar LangGraph, de 1 a 2 semanas para CrewAI.

Herramientas del comprador

Compare los marcos teniendo en cuenta su flujo de trabajo.

Utilice la metodología para evaluar la capacidad del equipo, la complejidad de los casos de uso, los requisitos de integración y la preparación para la producción antes de comprometerse con un marco.